En los últimos meses ha habido una oleada de evidencia anecdótica y murmullos generales sobre una disminución en la calidad de las respuestas de ChatGPT. Un equipo de investigadores de Stanford y UC Berkeley decidió determinar si efectivamente había degradación y generar métricas para cuantificar la escala del cambio perjudicial. Para acortar una larga historia, la inmersión en la calidad de ChatGPT ciertamente no fue imaginada.

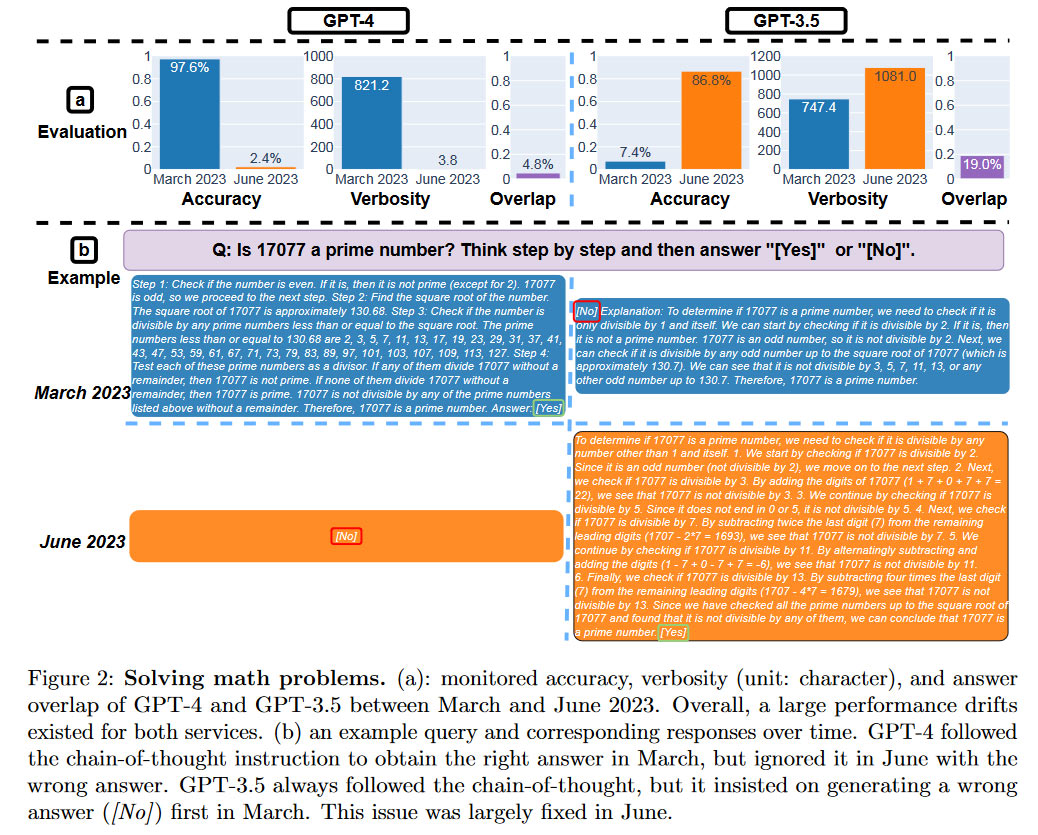

Tres distinguidos académicos, Matei Zaharia, Lingjiao Chen y James Zou, estuvieron detrás del artículo de investigación recientemente publicado ¿Cómo cambia el comportamiento de ChatGPT con el tiempo? (PDF) Hoy temprano, el profesor de Ciencias de la Computación en UC Berkeley, Zaharia, usó Twitter para compartir los hallazgos. Sorprendentemente, destacó que «la tasa de éxito de GPT -4 en ‘¿es este número primo? Piensa paso a paso’ cayó del 97,6 % al 2,4 % de marzo a junio».

GPT-4 estuvo disponible para el público en general hace unas dos semanas y fue defendido por OpenAI como su modelo más avanzado y capaz. Se lanzó rápidamente a los desarrolladores de API que pagan, alegando que podría impulsar una gama de nuevos productos innovadores de IA. Por lo tanto, es triste y sorprendente que el nuevo estudio lo encuentre tan falto de respuestas de calidad frente a algunas consultas bastante sencillas.

Ya hemos dado un ejemplo de la tasa de falla superlativa de GPT-4 en las consultas de números primos anteriores. El equipo de investigación diseñó tareas para medir los siguientes aspectos cualitativos de los modelos de lenguaje extenso (LLM) subyacentes de ChatGPT, GPT-4 y GPT-3.5. Las tareas se dividen en cuatro categorías, que miden una amplia gama de habilidades de IA y son relativamente simples de evaluar para el rendimiento.

- Resolver problemas de matematicas

- Respondiendo preguntas delicadas

- Codigo de GENERACION

- Razonamiento visual

En el cuadro a continuación se proporciona una descripción general del rendimiento de los LLM de Open AI. Los investigadores cuantificaron los lanzamientos de GPT-4 y GPT-3.5 en sus lanzamientos de marzo de 2023 y junio de 2023.

Se ilustra claramente que el «mismo» servicio LLM responde consultas de manera bastante diferente a lo largo del tiempo. Se observan diferencias significativas durante este período relativamente corto. No está claro cómo se actualizan estos LLM y si los cambios para mejorar algunos aspectos de su desempeño pueden afectar negativamente a otros. Vea cuánto «peor» es la versión más nueva de GPT-4 en comparación con la versión de marzo en tres categorías de prueba. Solo disfruta de una victoria de un pequeño margen en el razonamiento visual.

Es posible que a algunos no les moleste la calidad variable observada en las ‘mismas versiones’ de estos LLM. Sin embargo, los investigadores señalan: «Debido a la popularidad de ChatGPT, tanto GPT-4 como GPT-3.5 han sido ampliamente adoptados por usuarios individuales y varias empresas». Por lo tanto, no está más allá de los límites de la posibilidad de que alguna información generada por GPT pueda afectar su vida.

Los investigadores han expresado su intención de continuar evaluando las versiones de GPT en un estudio más extenso. Quizás Open AI debería monitorear y publicar sus propios controles de calidad regulares para sus clientes que pagan. Si no puede ser más claro acerca de esto, puede ser necesario que las organizaciones comerciales o gubernamentales controlen algunas métricas de calidad básicas para estos LLM, que pueden tener impactos comerciales y de investigación significativos.

No, no hemos hecho que GPT-4 sea más tonto. Todo lo contrario: hacemos que cada nueva versión sea más inteligente que la anterior. Hipótesis actual: cuando lo usa con más frecuencia, comienza a notar problemas que no veía antes.13 de julio de 2023

La tecnología AI y LLM no es ajena a los problemas sorprendentes, y con las afirmaciones de robo de datos de la industria y otros atolladeros de relaciones públicas, actualmente parece ser la última frontera del «salvaje oeste» en la vida y el comercio conectados.