Ampliando su ecosistema de IA, NVIDIA ha presentado «Chat with RTX», un chatbot para PC con Windows impulsado por TensorRT-LLM y disponible de forma gratuita en las últimas GPU RTX.

NVIDIA quiere reemplazar ChatGPT con su propio chatbot de IA «Chat With RTX» disponible localmente y de forma gratuita en las GPU RTX 30 y 40

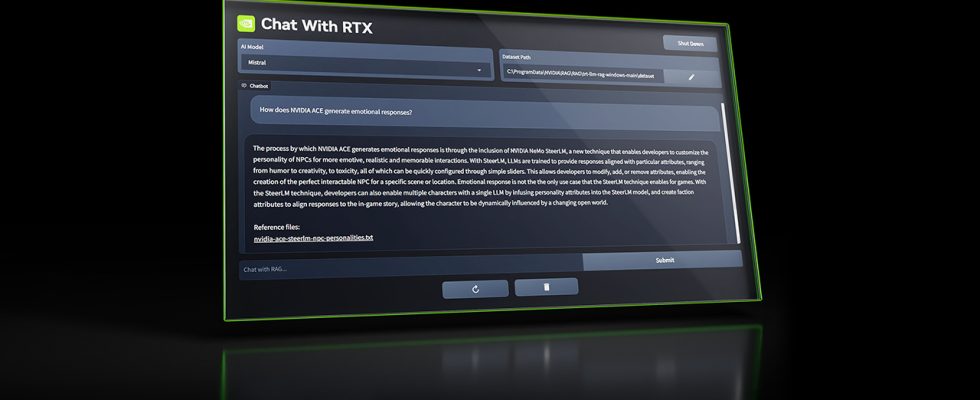

La utilidad del chatbot «Chat with RTX» es muy simple, está diseñado como un sistema localizado lo que significa que tendrás un chatbot GPT personalizado disponible todo el tiempo en tu PC sin necesidad de conectarte. El chat con RTX se puede personalizar completamente utilizando un conjunto de datos que está disponible localmente en su PC y la mejor parte es que se ejecuta en casi todas las GPU RTX 40 y RTX 30.

Comenzando con los detalles, Chat with RTX aprovecha el software TensorRT-LLM y Retrieval Augmented Generated (RAG) de NVIDIA que se anunció para PC con Windows el año pasado y aprovecha al máximo la aceleración RTX disponible en el hardware RTX para brindar la mejor experiencia posible a los usuarios. Una vez más, la aplicación es compatible con todas las GPU GeForce RTX 30 y 40 con al menos 8 GB de memoria de video.

Después de descargar «Chat with RTX» de forma gratuita, los usuarios pueden conectarlo a un conjunto de datos local disponible en la PC (.txt, .pdf, .doc, .docx, .xml) y conectarlo a un modelo de lenguaje grande como Mistral y Llama 2. También puedes agregar URL específicas, por ejemplo, para videos de YouTube o listas de reproducción completas para mejorar aún más los resultados de búsqueda del conjunto de datos. Después de conectarse, los usuarios pueden usar Chat With RTX de la misma manera que usarían ChatGPT ejecutando diferentes consultas, pero los resultados generados se basarán completamente en el conjunto de datos específico, lo que le brindará mejores respuestas en comparación con los métodos en línea.

Tener una GPU NVIDIA RTX compatible con TensorRT-LLM significa que tendrá todos sus datos y proyectos disponibles localmente en lugar de guardarlos en la nube. Esto ahorraría tiempo y ofrecería resultados más precisos. RAG o Retrieval Augamanted Generation es una de las técnicas utilizadas para acelerar los resultados de la IA mediante el uso de una biblioteca localizada que se puede completar con el conjunto de datos que desea que revise el LLM y luego aprovechar las capacidades de comprensión del lenguaje de ese LLM para brindarle información precisa. resultados.

NVIDIA afirma un aumento de rendimiento 5 veces mayor con TensorRT-LLM v0.6.0, que estará disponible a finales de este mes. Además, también permitirá la compatibilidad con LLM adicionales como Mistral 7B y Nemotron 3 8B.

Puedes descargar la aplicación «Chat with RTX» de NVIDIA aquí. Es compatible con PC con Windows 11 y Windows 10 y requiere los controladores de GPU NVIDIA más recientes para un rendimiento óptimo.