El texto a video es la próxima gran novedad en IA. Vimos hace un par de semanas lo increíble (y un poco espeluznante) que era el comercial Pepperoni Hugspot generado por IA. Pizza Later, la persona que desarrolló ese video, nos dijo que usaron una herramienta llamada Runway Gen-2 (se abre en una pestaña nueva) para hacer las imágenes en movimiento en ese proyecto. Con su motor de texto a video, pudieron dar indicaciones simples como «un hombre, una mujer o una familia felices comiendo una porción de pizza en un restaurante, un comercial de televisión» y obtener contenido fotorrealista.

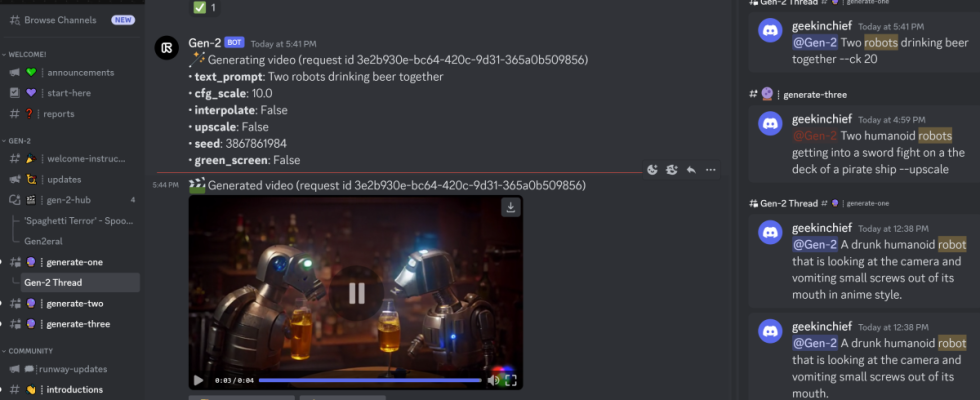

Acabo de obtener acceso a la versión beta pública de Runway Gen-2 y estoy realmente impresionado por la naturaleza realista de su resultado. Si bien los videos son cortos de solo cuatro segundos cada uno, la calidad de las imágenes es impresionante y todo funciona mediante el envío de solicitudes breves a un bot en el servidor Discord de Runway ML.

Al enviar unas pocas palabras de texto al bot @Gen-2, pude obtener clips cortos y fotorrealistas (o de estilo de dibujos animados) de todo, desde una familia disfrutando de una cena de sushi hasta un robot con un grave problema con la bebida. El resultado con frecuencia no era exactamente lo que pedí, pero siempre fue interesante y fue superior al NeuralInternet Text-to-Video Playground sobre el que escribí la semana pasada.

Si bien cualquiera puede unirse al servidor, solo verá la lista de salas de chat Gen-2 una vez que obtenga acceso al programa beta (para el cual muchos están en la lista de espera). Hay algunas salas donde puede chatear y compartir proyectos con otros usuarios y luego hay tres salas llamadas Generar uno, Generar dos y Generar tres donde puede ir para enviar mensajes directamente al bot @Gen-2. Los moderadores lo alientan a seguir emitiendo indicaciones en el mismo hilo para no desordenar cada sala de chat.

Impulsando la pista Gen-2

Un aviso de Runway Gen-2 podría ser algo así como «@Gen-2 Un robot humanoide borracho que está mirando a la cámara y vomitando pequeños tornillos de su boca». El bot responderá de inmediato con su mensaje y algunos parámetros que está usando (por ejemplo, «ampliación») que puede cambiar emitiendo un nuevo mensaje (más sobre eso más adelante). Luego, un par de minutos más tarde, obtendrá un video de 4 segundos basado en su indicación.

Así es como se veía mi robot borracho. Todos los videos se pueden reproducir desde Discord y puede descargarlos como archivos MP4. He convertido por separado todas las muestras de video que se muestran en este artículo en GIF animados para que podamos verlos más fácilmente (y sin anuncios pre-roll).

Notarás que el clip anterior no era exactamente lo que pedí. El robot no está vomitando tornillos como pretendía. En cambio, solo está mirando amenazadoramente una taza de cerveza. Mis otros intentos en este mensaje tampoco fueron exactamente lo que quería. Cuando dejé la palabra «borracho», obtuve un robot que abría la boca pero no escupía nada.

Uso de imágenes con indicaciones de Runway Gen-2

También puede enviar imágenes al bot copiándolas y pegándolas en Discord junto con el mensaje de texto o colocando la URL de la imagen en el mensaje. Sin embargo, Runway Gen-2 en realidad no usará la imagen que cargó. Solo se inspirará en la imagen para crear su propio video. Subí imágenes mías muchas veces y me dieron videos de personas que se parecían un poco a mí, pero definitivamente no eran yo.

Por ejemplo, cuando subí una foto mía y no le di más información, mostraba a un hombre calvo de mediana edad con gafas de sol que no era yo, de pie junto a un río y algunos edificios. Su boca se movió y el agua se movió.

El bot Runway Gen-2 es mejor para copiar la emoción o el tema de una imagen que proporcionas. Le mostré una imagen de mí mismo con una mirada de disgusto en mi rostro y pregunté por «este tipo mirando a la cámara y diciendo ‘oh hombre'».

Muchos de los usuarios en el servidor Discord dicen que lograron excelentes resultados al generar una imagen fija con otra herramienta de inteligencia artificial como Midjourney o Stable Diffusion, y luego enviar esa imagen a CLIP Interrogator 2.1 en Hugging Face, una herramienta que mira una imagen. y luego le da indicaciones que cree que se refieren a esa imagen.

Probé ese proceso y le pedí a Stable Diffusion que me hiciera una imagen de un niño en una acera jugando con robots de juguete en la década de 1980. Luego tomé la imagen en CLIP Interrogator y obtuve algunos mensajes de muestra que eran bastante obvios, como «niño parado al lado del robot». Aún así, introducir la misma imagen en el aviso no me dio lo que quería. Tengo a un niño con dos robots parados frente a una calle, pero no era la misma calle ni el mismo niño.

Moverse o No Moverse

La limitación de tiempo en sí misma generalmente significa que no hay mucho tiempo para el movimiento en cada clip. Pero, además de eso, descubrí que muchos clips tenían muy poco movimiento. A menudo, era solo la cabeza de alguien que se movía o un líquido que fluía o el humo que salía de un fuego.

Una buena manera de conseguir más movimiento es poner un aviso en el que se solicite un lapso de tiempo o un paneo de algún tipo. Cuando pedí un lapso de tiempo de un volcán islandés o una toma panorámica de un metro de Nueva York, obtuve algunos resultados bastante buenos. Cuando solicité una vista panorámica del horizonte de Taipei, vi nubes moviéndose pero sin panorámica, y la ciudad definitivamente no era Taipei.

Pedir que corran, persigan o monten puede o no hacer el trabajo. Cuando solicité una «tortuga andando en monopatín», obtuve una especie de animal parecido a una tortuga que rodaba por la calle a gran velocidad. Pero cuando pregunté por los boxeadores de Intel y AMD peleando entre sí, obtuve una imagen de dos boxeadores que no se movían en absoluto (y ninguno tenía los logotipos de Intel o AMD).

En qué es bueno y malo Runway Gen-2

Al igual que otros generadores de imágenes de IA, Runway Gen-2 no hace un gran trabajo al reproducir personajes, productos o lugares de marca muy específicos. Cuando lo pedí por el boxeo de Mario y Luigi, obtuve dos personajes que parecen imitaciones de los personajes de Nintendo. Pedí muchas veces videos de Godzilla y obtuve unos lagartos gigantes que ni el fanático más casual confundiría con el Rey de los Monstruos.

Fue un poco mejor con las referencias de Minecraft. Cuando pregunté por un enredadera y un enderman comiendo pizza y nuevamente por un enredadera comiendo en McDonald’s, obtuve enredaderas de aspecto decente pero un enderman inexacto. Preguntar por una familia de enredaderas comiendo pizza me dio una familia de humanoides que parecen salidos de Minecraft. Cualquiera que haya jugado Minecraft sabe que las enredaderas son monstruos verdes con manchas negras.

La herramienta es terrible con los logotipos. Le di el logo de Tom’s Hardware y le pedí que usara el logo en un comercial y me devolvió esta cosa extraña.

Cuando le pedí una CPU AMD Ryzen en llamas, obtuve algo que se parecía vagamente a una PCU con un logotipo que solo tienes que ver por ti mismo (abajo).

Lo que Runway Gen-2 hace muy bien es darte imágenes genéricas de personas y familias haciendo cosas como comer. Puede o no hacer que coman exactamente lo que quiere. Cuando pregunté por una familia que comía gusanos vivos, obtuve una familia que parecía más como si estuviera comiendo ensalada. Una familia comiendo sushi en una pizzería de la década de 1970 parecía particularmente realista.

Me siento obligado a señalar que casi siempre obtuve personas blancas cuando pregunté por una persona sin especificar su origen étnico. La única vez que obtuve una familia (o persona) que no era blanca sin preguntar específicamente por una fue cuando pregunté por la familia comiendo sushi. Este es un problema bien conocido con los datos de entrenamiento en muchos modelos generativos de IA.

Parámetros especiales

Hay un puñado de parámetros que puede agregar al final de su solicitud en Runway Gen-2 para cambiar un poco la salida. No me entretuve mucho con esto.

- –exclusivo ofrece una resolución más alta

- –interpolar hace que el video sea más fluido

- –cfg [number] controla cuán creativa se vuelve la IA. Los valores más altos están más cerca de lo que pediste.

- –pantalla verde emite este video con un área de pantalla verde que puedes usar en la edición

- –semilla es un número que ayuda a determinar el resultado. De forma predeterminada, es un número aleatorio cada vez, pero si usa el mismo número nuevamente, debería obtener un resultado similar.

Cosiéndolo todo junto

Si busca en Internet ejemplos de videos de Runway Gen-2, puede notar muchos videos que duran más de 4 segundos y tienen sonido. La gente hace estos videos uniendo muchos clips diferentes de 4 segundos en un editor de video y agregando sonido y música que han obtenido en otros lugares.

Uno de los videos más famosos de Runway Gen-2 es el comercial de pizza Pepperoni Hugspot que mencioné anteriormente. Pero, en Runway ML Discord, veo a muchas personas publicando enlaces de YouTube a sus creaciones. Uno de mis favoritos es «Terror de espagueti» que fue publicado en Twitter por Andy McNamara. Y el nuevo comercial de abogados de Pizza Later es un puntazo.

Línea de fondo

Runway Gen-2 está en versión beta privada mientras escribo esto, pero la compañía ha dicho que tiene la intención de ponerlo a disposición de todos pronto, como ya lo ha hecho con su producto Gen-1. Como demostración de tecnología, es realmente impresionante y puedo ver a alguien usando sus clips cortos en lugar de videos de archivo o GIF animados de archivo.

Incluso si el tiempo se extendiera a 60 segundos, parece poco probable que esta herramienta pueda reemplazar el video filmado de manera profesional (o incluso amateur) en el corto plazo. Su incapacidad para reproducir con precisión lugares y personas muy específicos es una gran decepción, pero también es una limitación que he visto en todas las IA generadoras de imágenes hasta el momento. Sin embargo, la tecnología está ahí y, a medida que aumentan los datos de entrenamiento, esto podría ser aún más impresionante.