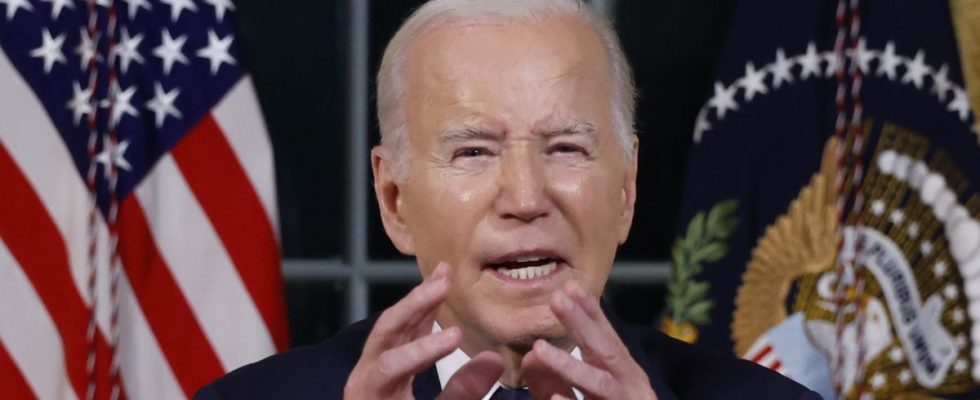

El presidente de los Estados Unidos, Joe Biden, ha emitido una orden ejecutiva (EO) que busca establecer “nuevos estándares” para la seguridad de la IA, incluidos requisitos para que las empresas que desarrollan modelos básicos de IA notifiquen al gobierno federal y compartan los resultados de todas las pruebas de seguridad antes de su implementación. para el publico.

El veloz movimiento de IA generativa, impulsado por empresas como ChatGPT y modelos básicos de IA desarrollados por OpenAI, ha provocado un debate global sobre la necesidad de contar con barreras de seguridad para contrarrestar los posibles peligros de ceder demasiado control a los algoritmos. En mayo, los líderes del G7 identificaron temas clave que deben abordarse como parte del llamado Proceso de IA de Hiroshima, y los siete países constituyentes llegaron hoy a un acuerdo sobre principios rectores y un código de conducta “voluntario” que deben seguir los desarrolladores de IA. .

La semana pasada, las Naciones Unidas (ONU) anunciaron una nueva junta para explorar la gobernanza de la IA, mientras que el Reino Unido organiza esta semana su cumbre mundial sobre la gobernanza de la IA en Bletchley Park, y la vicepresidenta de los Estados Unidos, Kamala Harris, hablará en el evento.

La Administración Biden-Harris, por su parte, también se ha centrado en la seguridad de la IA en lugar de cualquier cosa legalmente vinculante, asegurando “compromisos voluntarios” de los principales desarrolladores de IA, incluidos OpenAI, Google, Microsoft, Meta y Amazon; esto siempre fue así. Sin embargo, pretende ser un preludio a una orden ejecutiva, que es lo que se anuncia hoy.

“IA segura, protegida y confiable”

Específicamente, la orden establece que los desarrolladores de los “sistemas de inteligencia artificial más poderosos” deben compartir los resultados de sus pruebas de seguridad y los datos relacionados con el gobierno de EE. UU.

«A medida que crecen las capacidades de la IA, también aumentan sus implicaciones para la seguridad de los estadounidenses», señala la orden, y agrega que su objetivo es «proteger a los estadounidenses de los riesgos potenciales de los sistemas de IA».

Al alinear los nuevos estándares de seguridad de la IA con la Ley de Producción de Defensa (1950), la orden se dirige específicamente a cualquier modelo de base que pueda representar un riesgo para la seguridad nacional, la seguridad económica o la salud pública, que, si bien está algo abierta a interpretación, debería cubrir casi cualquier modelo de base que llegue a buen término.

«Estas medidas garantizarán que los sistemas de inteligencia artificial sean seguros y confiables antes de que las empresas los hagan públicos», agrega la orden.

En otros lugares, la orden también describe planes para desarrollar varias herramientas y sistemas nuevos para garantizar que la IA sea segura y confiable, y el Instituto Nacional de Estándares y Tecnología (NIST) tiene la tarea de desarrollar nuevos estándares «para pruebas exhaustivas del equipo rojo» antes de su lanzamiento. . Estas pruebas se aplicarán en todos los ámbitos, y los Departamentos de Energía y Seguridad Nacional abordarán los riesgos relacionados con la IA y la infraestructura crítica, por ejemplo.

La orden también sirve para respaldar una serie de nuevas directivas y estándares, que incluyen, entre otros, la protección contra los riesgos del uso de IA para diseñar materiales biológicos peligrosos; proteger contra el fraude y el engaño impulsados por la IA; y establecer un programa de ciberseguridad para crear herramientas de inteligencia artificial para abordar vulnerabilidades en software crítico.

Dientes

Vale la pena señalar que la orden aborda áreas como la equidad y los derechos civiles, señalando cómo la IA puede exacerbar la discriminación y el sesgo en la atención médica, la justicia y la vivienda, así como los peligros que plantea la IA en relación con cosas como la vigilancia en el lugar de trabajo y el trabajo. desplazamiento. Pero algunos podrían interpretar que la orden carece de fuerza real, ya que gran parte de ella parece centrarse en recomendaciones y directrices; por ejemplo, dice que quiere garantizar la equidad en el sistema de justicia penal “desarrollando mejores prácticas sobre el uso de IA en sentencias, libertad condicional y libertad condicional, libertad condicional y detención, evaluaciones de riesgos, vigilancia, previsión de delitos y vigilancia policial predictiva, y análisis forense”.

Y si bien la orden ejecutiva avanza en cierta medida hacia la codificación cómo Los desarrolladores de IA deberían dedicarse a crear seguridad en sus sistemas; no está claro hasta qué punto se puede hacer cumplir sin más cambios legislativos. Por ejemplo, la orden analiza las preocupaciones en torno a la privacidad de los datos; después de todo, la IA hace que sea infinitamente más fácil extraer y explotar los datos privados de las personas a escala, algo que los desarrolladores podrían verse incentivados a hacer como parte de sus procesos de capacitación de modelos. Sin embargo, la orden ejecutiva simplemente pide al Congreso que apruebe una “legislación bipartidista de privacidad de datos” para proteger los datos de los estadounidenses, incluida la solicitud de más apoyo federal para desarrollar técnicas de desarrollo de IA que preserven la privacidad.

Con Europa a punto de aprobar las primeras regulaciones extensas sobre IA, está claro que el resto del mundo también está lidiando con formas de contener lo que creará una de las mayores perturbaciones sociales desde la revolución industrial. Queda por ver qué impacto tendrá la orden ejecutiva del presidente Biden al tambalearse en empresas como OpenAI, Google, Microsoft y Meta.