Actualizar

Rivera agradeció a la audiencia por unirse al seminario web y también compartió un resumen de los principales anuncios.

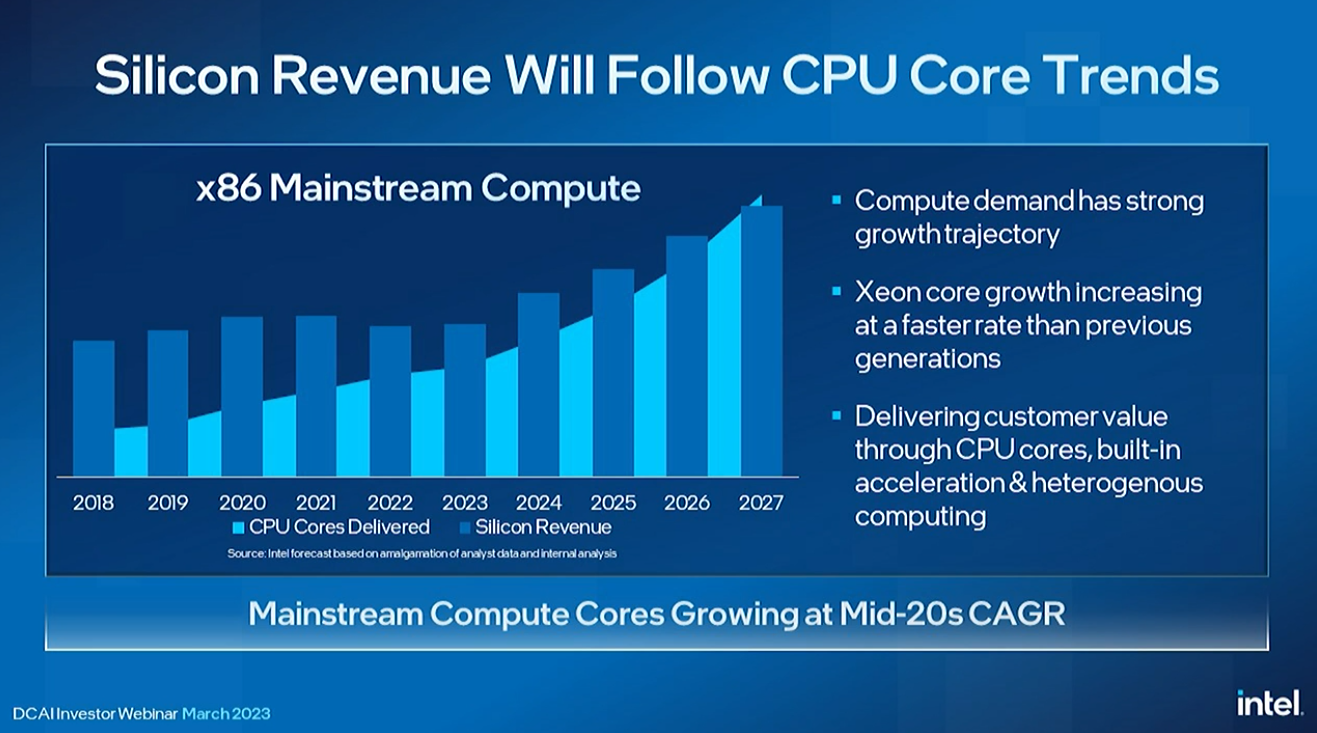

En resumen, Intel anunció que Sierra Forest, su Xeon eficiente de primera generación, vendrá con 144 núcleos increíbles, ofreciendo así una mejor densidad de núcleo que los chips EPYC Bergamo de 128 núcleos de la competencia de AMD. La compañía también se burló del chip en una demostración. Intel también reveló los primeros detalles de Clearwater Forest, su Xeon de eficiencia de segunda generación que debutará en 2025. Intel omitió su nodo de proceso 20A por el 18A de mayor rendimiento para este nuevo chip, lo que dice mucho sobre su fe en la salud de su nodo futuro.

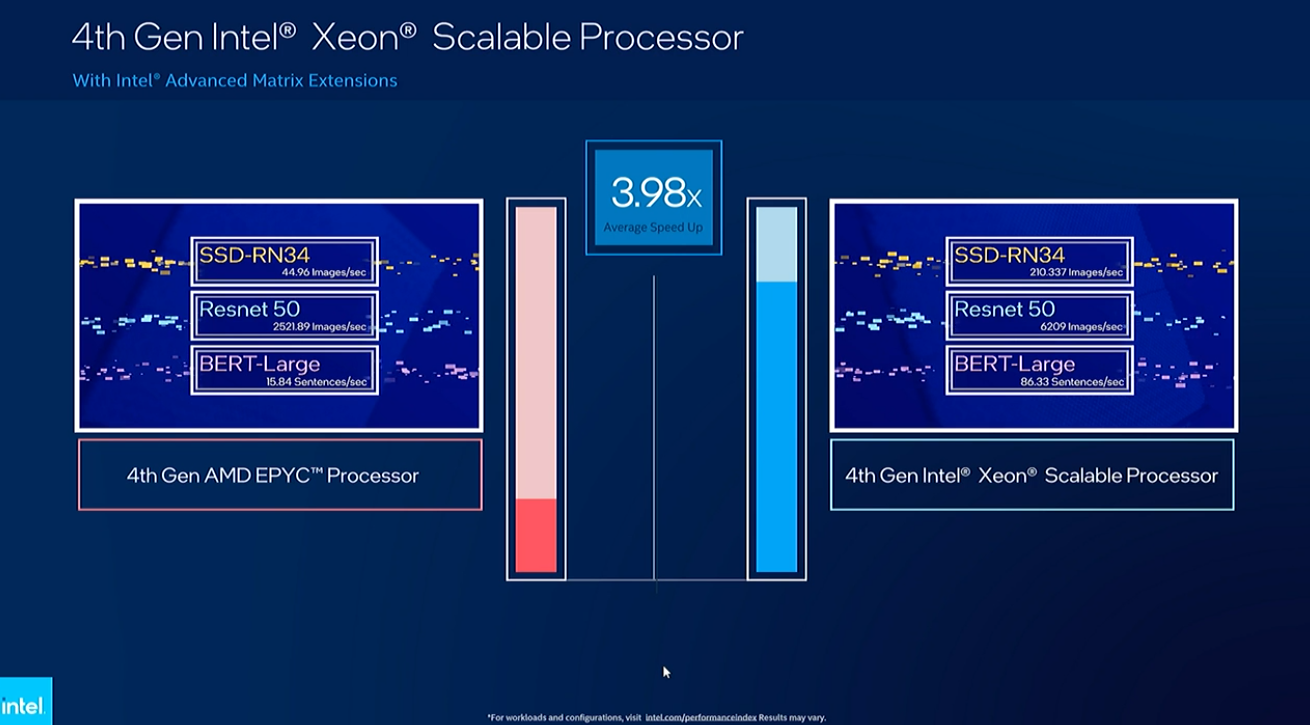

Intel también presentó varias demostraciones, incluidos puntos de referencia de IA frente a EPYC Genoa de AMD que muestran una ventaja de rendimiento 4X para Xeon en un frente a frente de dos chips de 48 núcleos, y un punto de referencia de rendimiento de memoria que mostró lo siguiente: gen Granite Rapids Xeon que ofrece un increíble ancho de banda de 1,5 TB/s en un servidor de dos sockets.

Este es un evento para inversionistas, por lo que ahora la compañía realizará una sesión de preguntas y respuestas que se enfoca en el aspecto financiero de la presentación. No nos centraremos en la sección de preguntas y respuestas aquí a menos que las respuestas sean especialmente pertinentes para el hardware que es nuestro fuerte. Si está más interesado en el aspecto financiero de la conversación, puede ver el seminario web aquí.

Lavender también describió los esfuerzos de la compañía para proporcionar escala y acelerar el desarrollo a través de Intel Developer Cloud. Intel tiene 4 veces más usuarios desde que anunció el programa en 2021. Y con eso, le devolvió el testigo a Sandra.

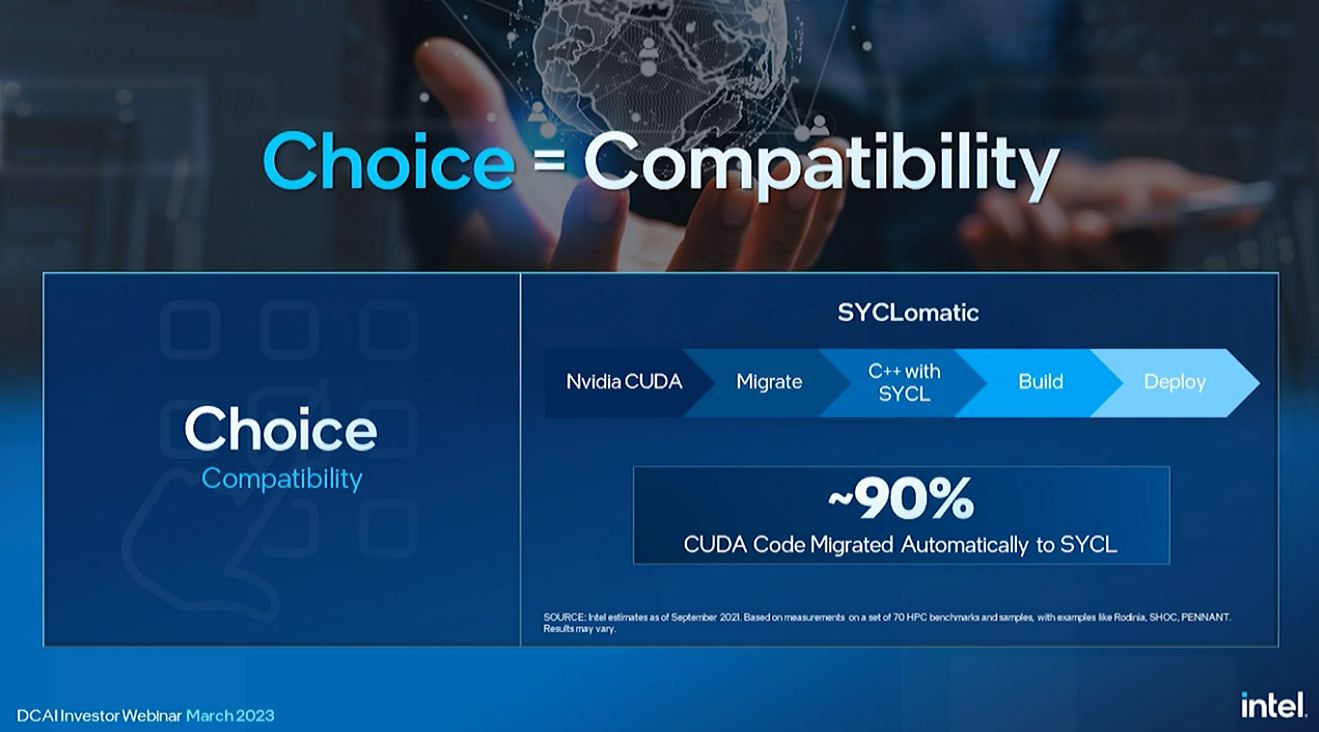

Intel lanzó SYCLomatic para migrar automáticamente el código CUDA a SYCL.

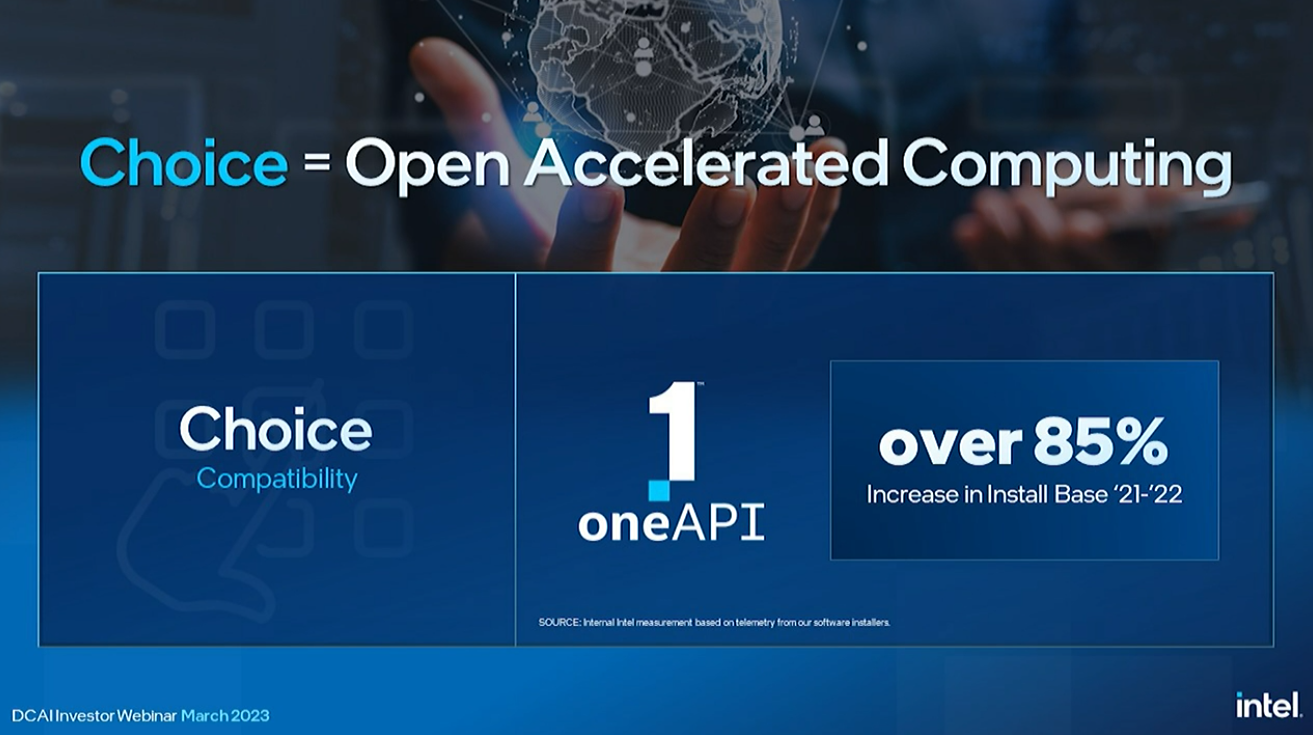

Los esfuerzos de Intel con OneAPI continúan, con 6,2 millones de desarrolladores activos que utilizan las herramientas de Intel.

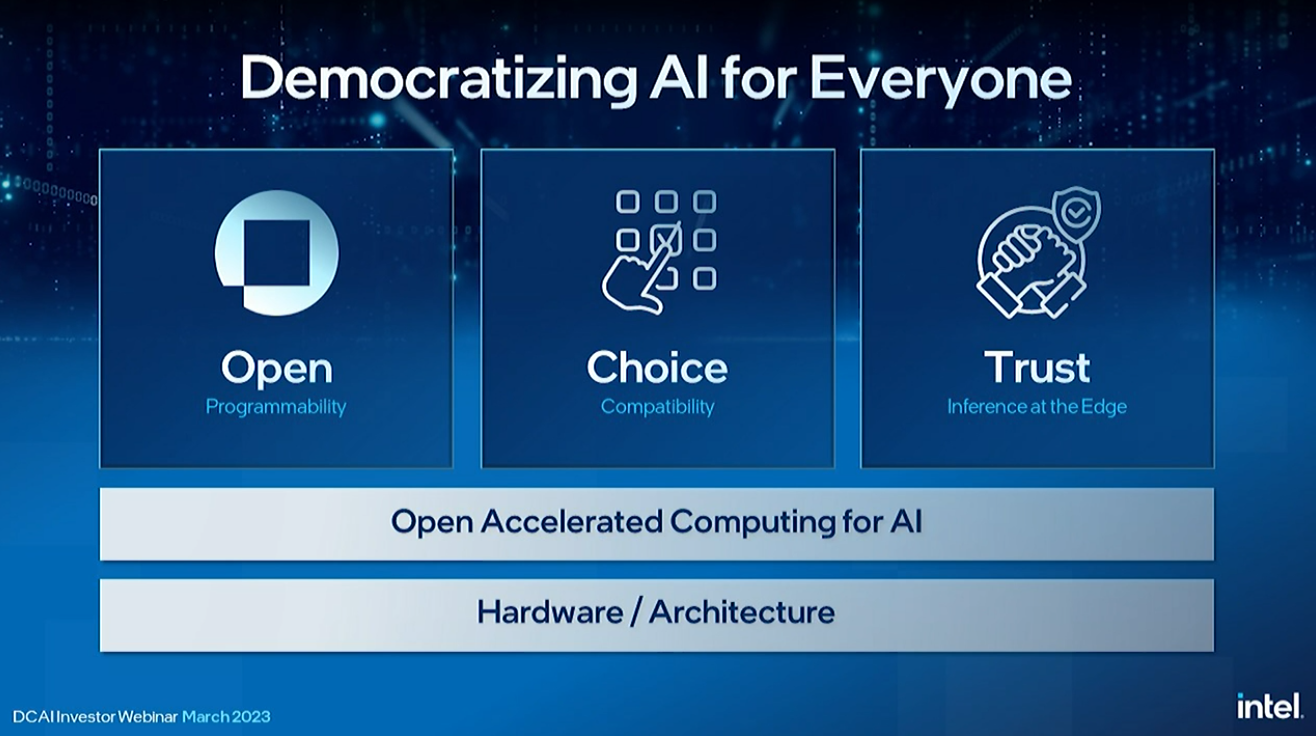

Intel apunta a un enfoque abierto de múltiples proveedores para proporcionar una alternativa a CUDA de Nvidia.

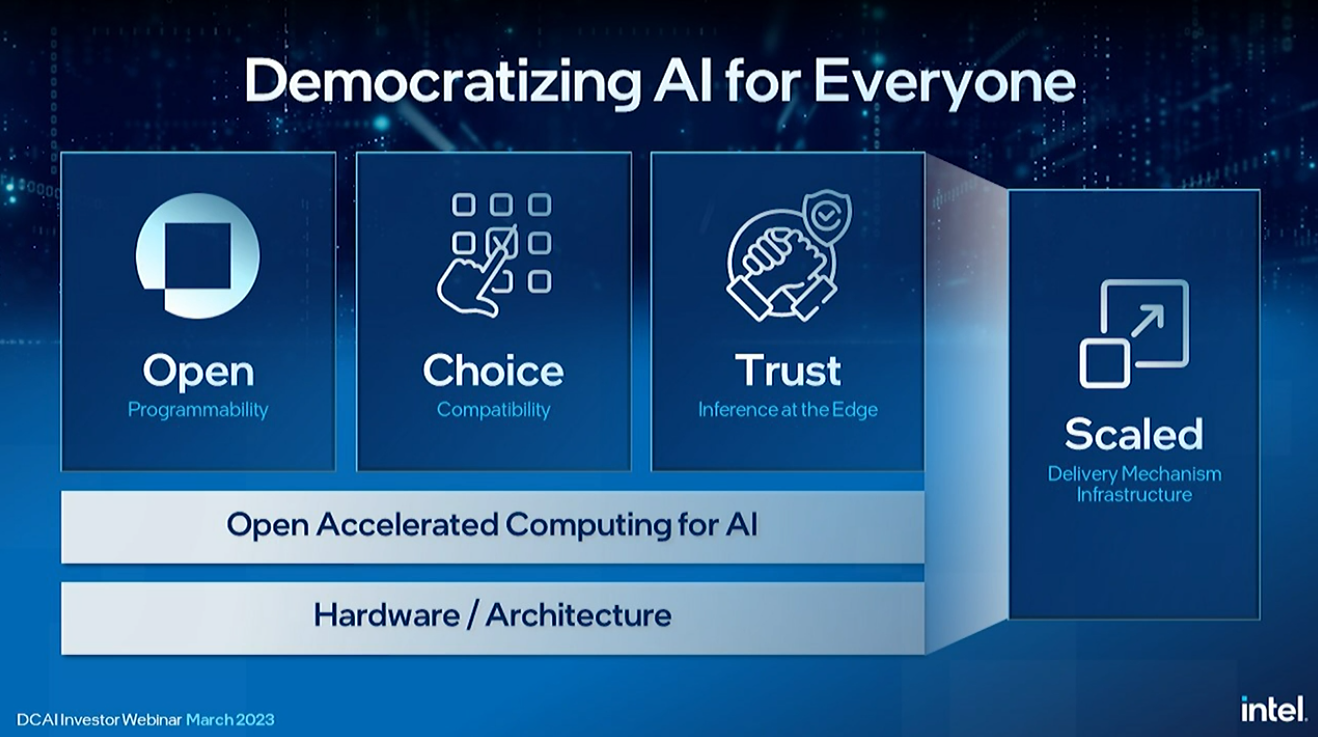

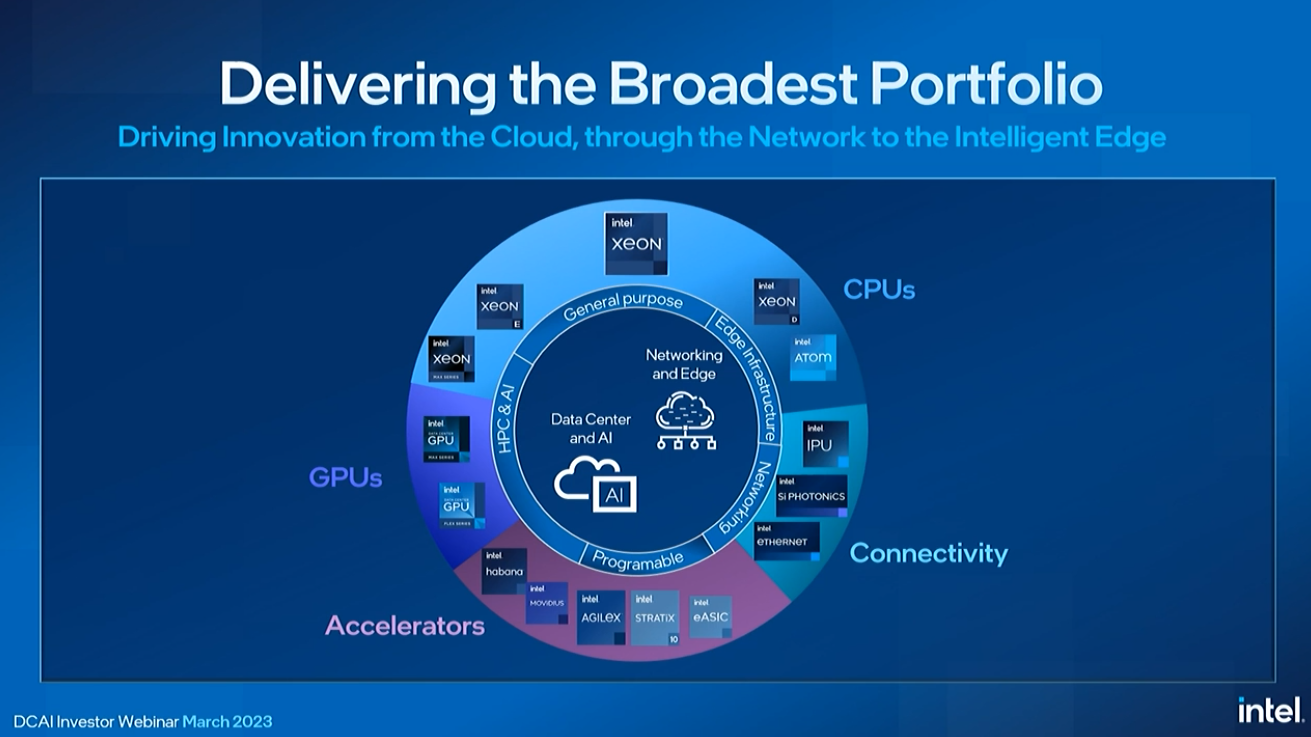

Intel también está trabajando para construir un ecosistema de software para IA que compita con CUDA de Nvidia. Esto también incluye adoptar un enfoque de extremo a extremo que incluya silicio, software, seguridad, confidencialidad y mecanismos de confianza en cada punto de la pila.

Greg Lavendar de Intel, vicepresidente sénior y director de tecnología de Intel, se unió al webcast para hablar sobre la democratización de la IA.

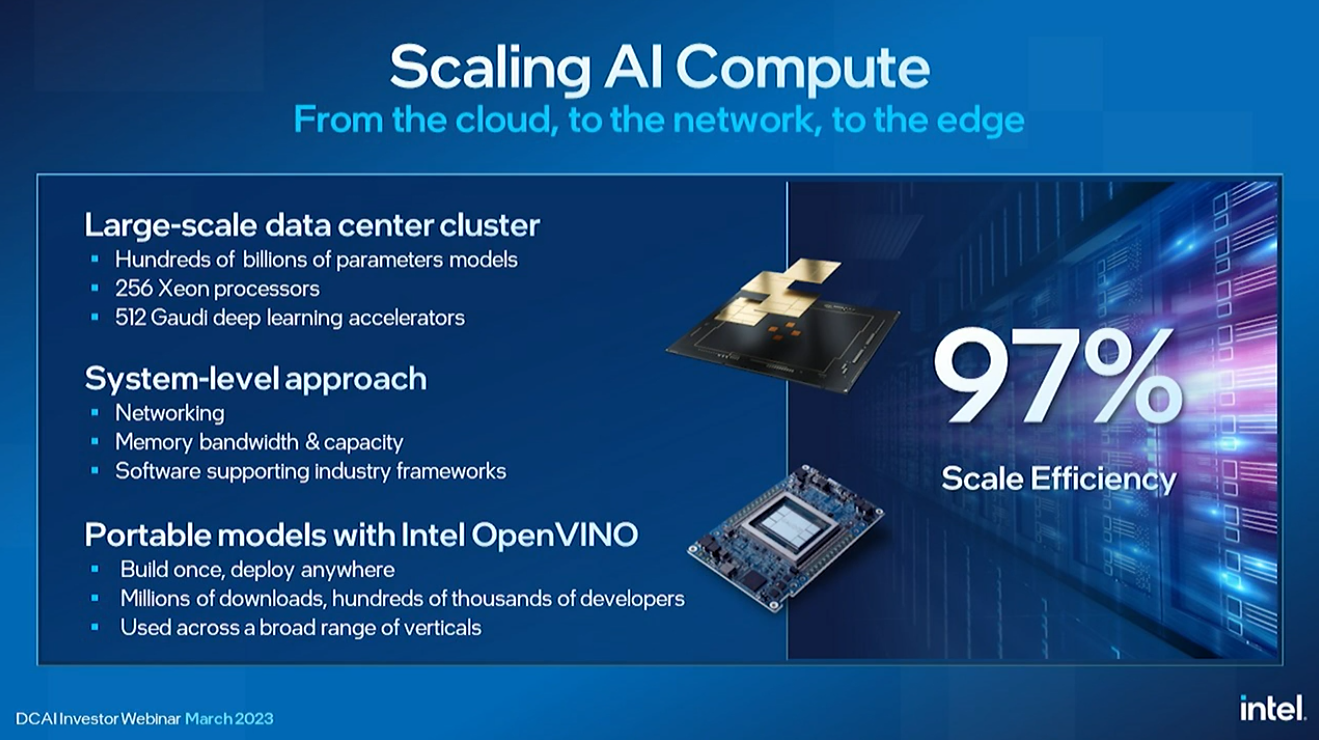

Rivera promocionó la eficiencia de escala del 97 % de Intel en un punto de referencia de clúster.

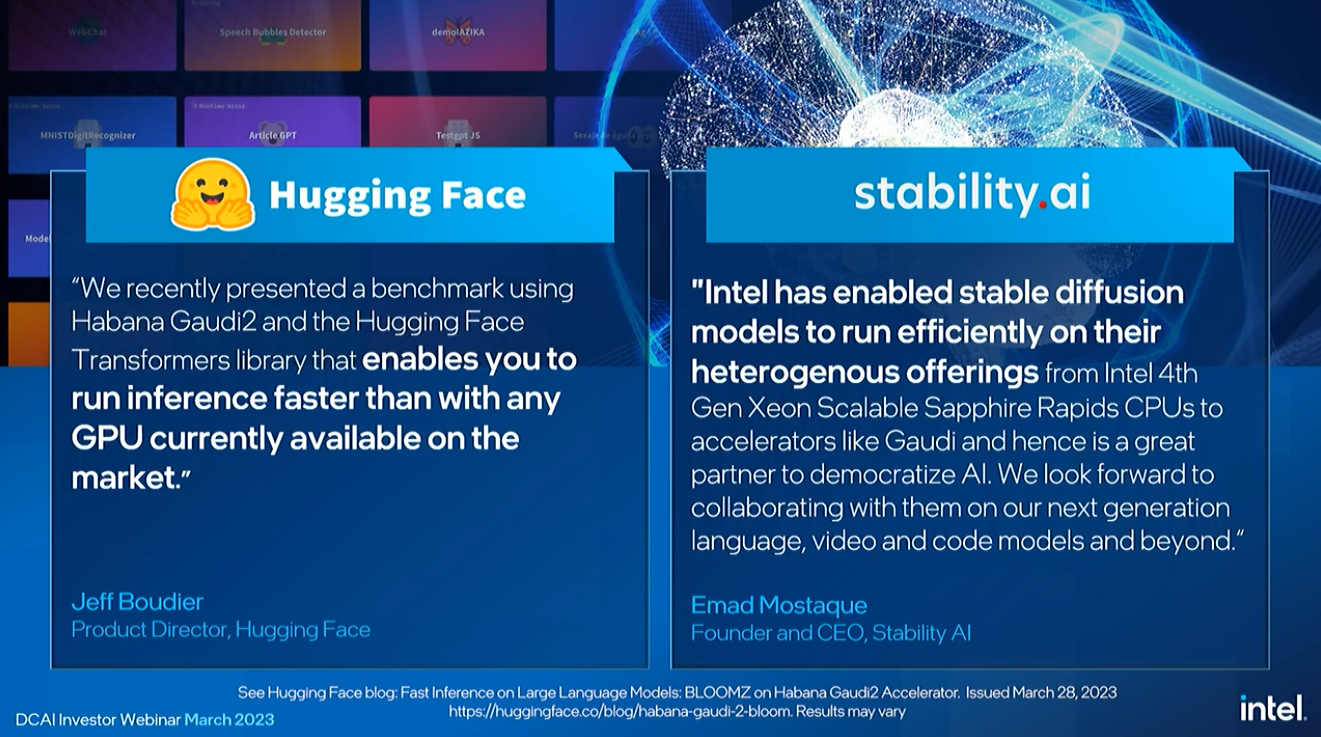

Las CPU también son buenas para modelos de inferencia más pequeños, pero los aceleradores discretos son importantes para modelos más grandes. Intel utiliza sus GPU Gaudi y Ponte Vecchio para abordar este mercado. Hugging Face dijo recientemente que Gaudí le dio el triple de rendimiento en la biblioteca de Hugging Face Transformers.

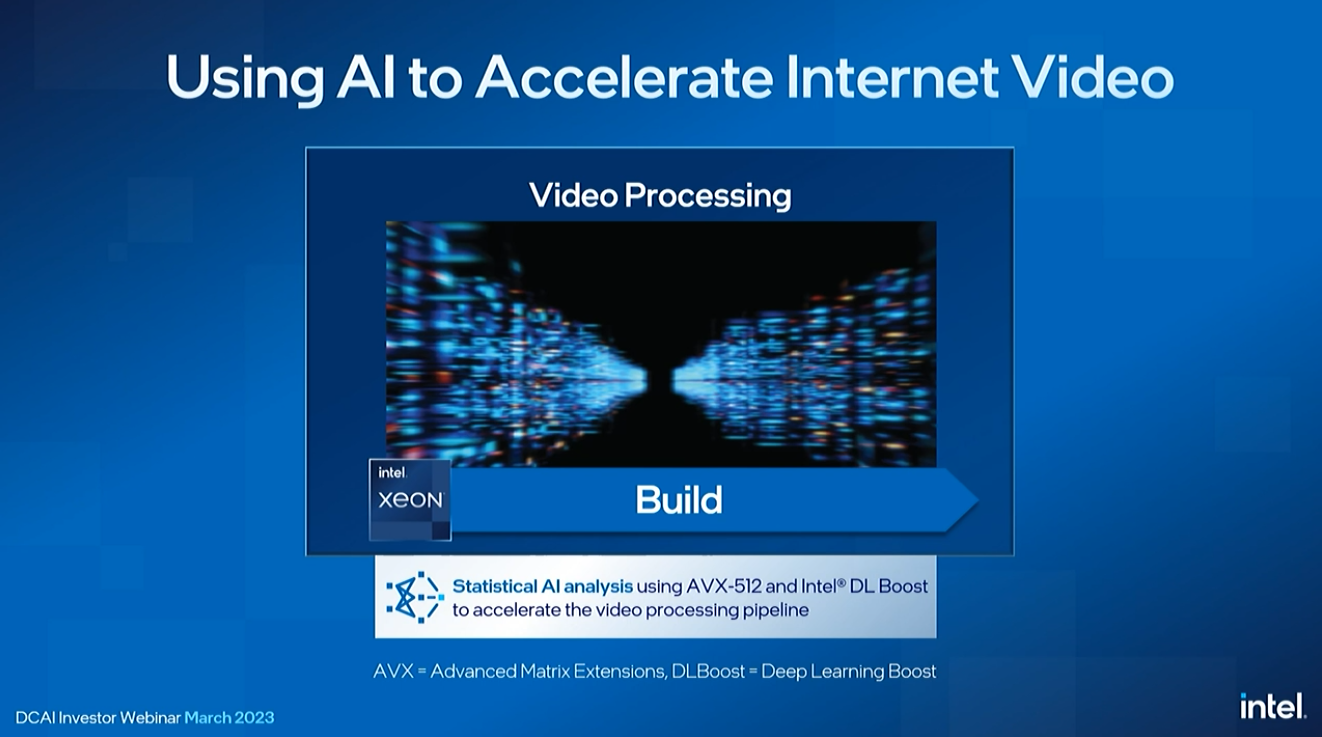

Intel está trabajando con proveedores de contenido para realizar cargas de trabajo de IA en transmisiones de video, y la computación basada en IA puede acelerar, comprimir y cifrar datos que se mueven a través de la red, todo lo cual ocurre en una sola CPU Sapphire Rapids.

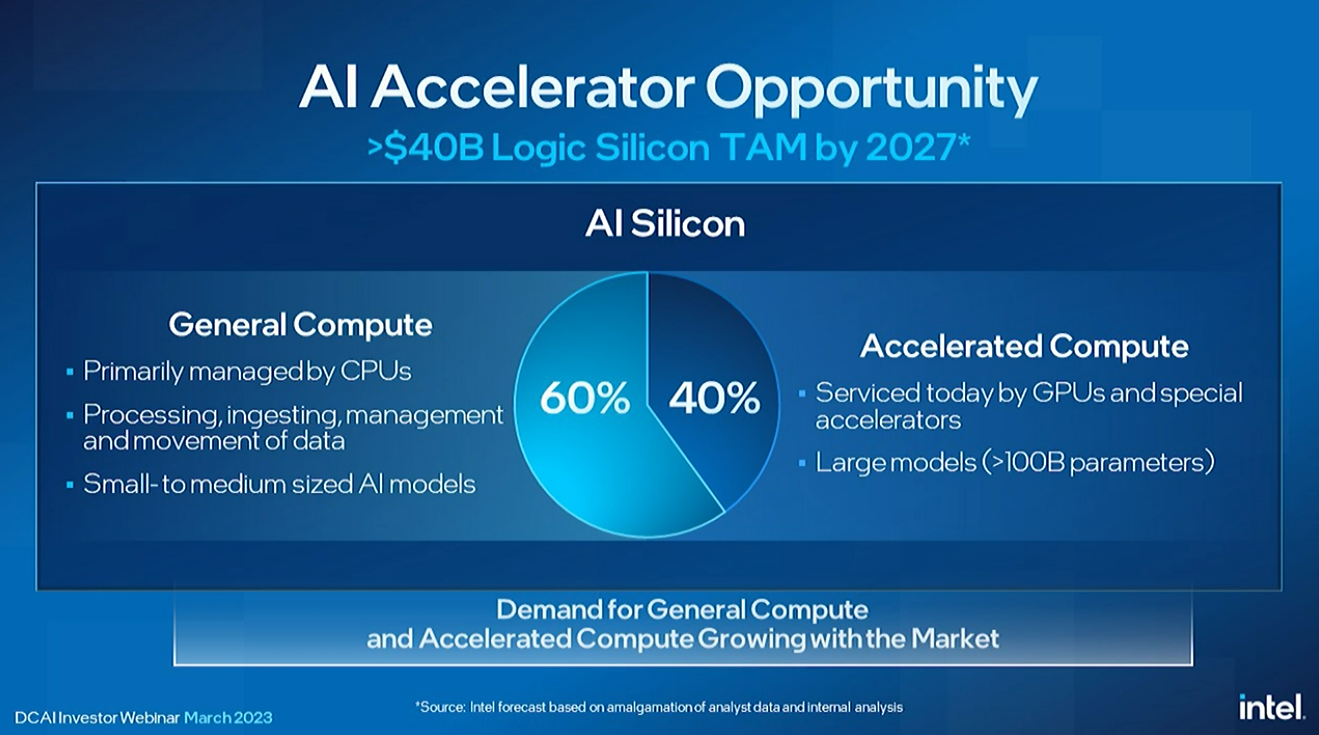

Rivera describió los amplios esfuerzos de Intel en el espacio de la IA. Intel predice que las cargas de trabajo de IA seguirán ejecutándose predominantemente en CPU, con el 60 % de todos los modelos, principalmente los modelos de tamaño pequeño a mediano, ejecutándose en CPU. Mientras tanto, los modelos grandes comprenderán aproximadamente el 40 % de las cargas de trabajo y se ejecutarán en GPU y otros aceleradores personalizados.

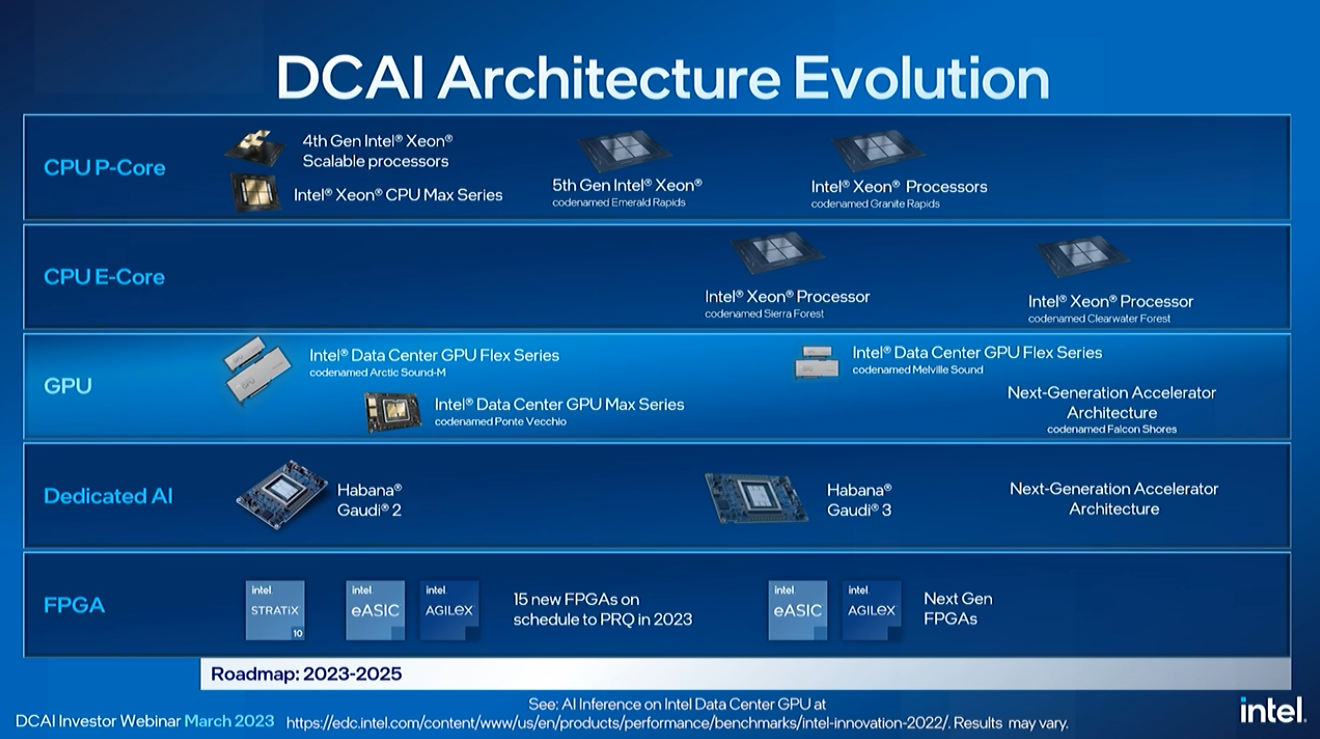

Intel también tiene una lista completa de otros chips para cargas de trabajo de IA. Intel señaló que lanzará 15 nuevos FPGA este año, un récord para su grupo FPGA. Todavía no hemos oído hablar de ninguna victoria importante con los chips Gaudi, pero Intel continúa desarrollando su línea y tiene un acelerador de próxima generación en la hoja de ruta. El acelerador de IA Gaudi 2 está a la venta, y Gaudi 3 ha sido grabado.

Rivera ahora ha anunciado la continuación de Sierra Forest, Clearwater Forest. Intel no compartió muchos detalles más allá del lanzamiento en el plazo de 2025, pero dijo que usará el proceso 18A para el chip, no el nodo de proceso 20A que llega medio año antes. Este será el primer chip Xeon con el proceso 18A.

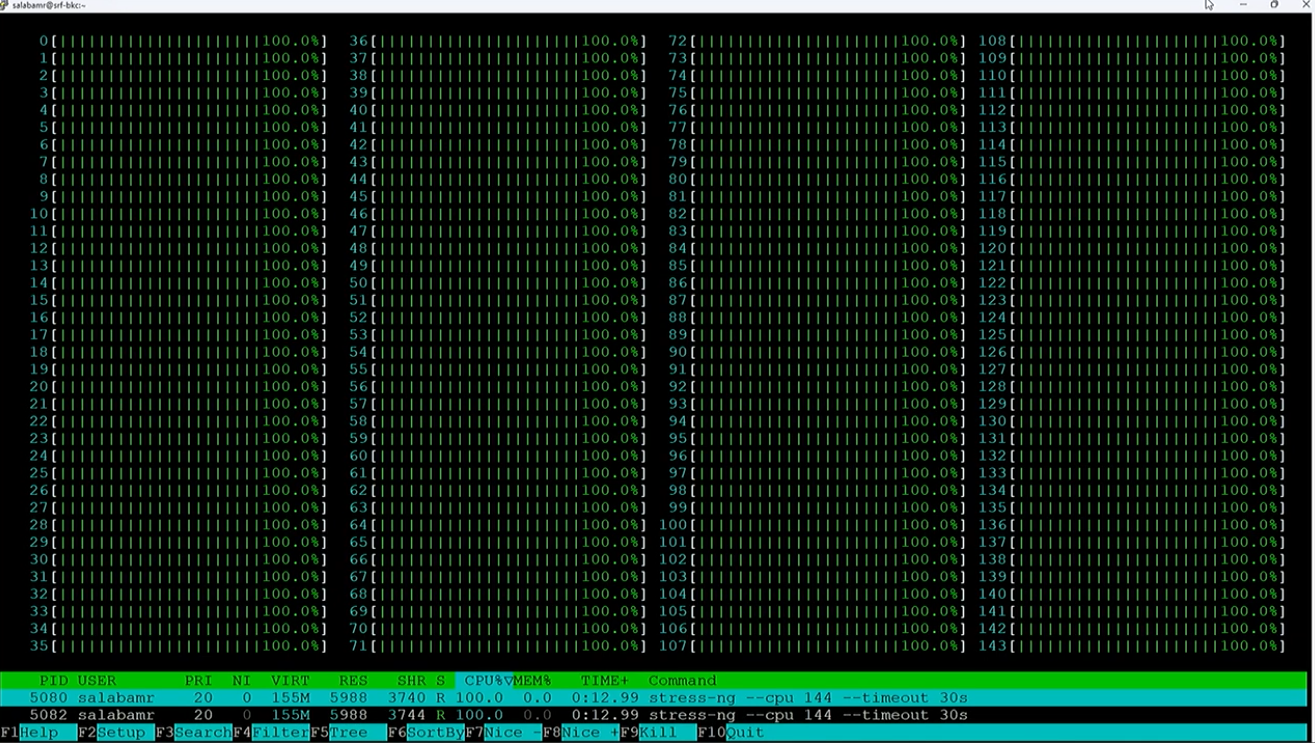

Spelman volvió a mostrarnos los 144 núcleos del chip Sierra Forest funcionando en una demostración.

La hoja de ruta de e-core de Intel comienza con Sierra Forest de 144 núcleos, que proporcionará 256 núcleos en un único servidor de doble zócalo. Los 144 núcleos del Xeon Sierra Forest de quinta generación también superan al EPYC Bergamo de 128 núcleos de AMD en términos de número de núcleos, pero es probable que no tome la delantera en el número de subprocesos: los núcleos electrónicos de Intel para el mercado de consumo son de un solo subproceso, pero el la compañía no ha divulgado si los núcleos electrónicos para el centro de datos admitirán hyperthreading. AMD ha compartido que el Bergamo de 128 núcleos está hiperproceso, lo que proporciona un total de 256 subprocesos por socket.

Rivera dice que Intel encendió el silicio y tuvo un sistema operativo que se inició en menos de 18 horas (un récord de la compañía). Este chip es el vehículo principal para el nodo de proceso ‘Intel 3’, por lo que el éxito es primordial. Intel confía lo suficiente en que ya ha probado los chips para sus clientes y ha demostrado los 144 núcleos en acción en el evento. Intel apunta los modelos e-core Xeon a tipos específicos de cargas de trabajo optimizadas para la nube al principio, pero espera que se adopten para una gama mucho más amplia de casos de uso una vez que estén en el mercado.

Aquí podemos ver la demostración.

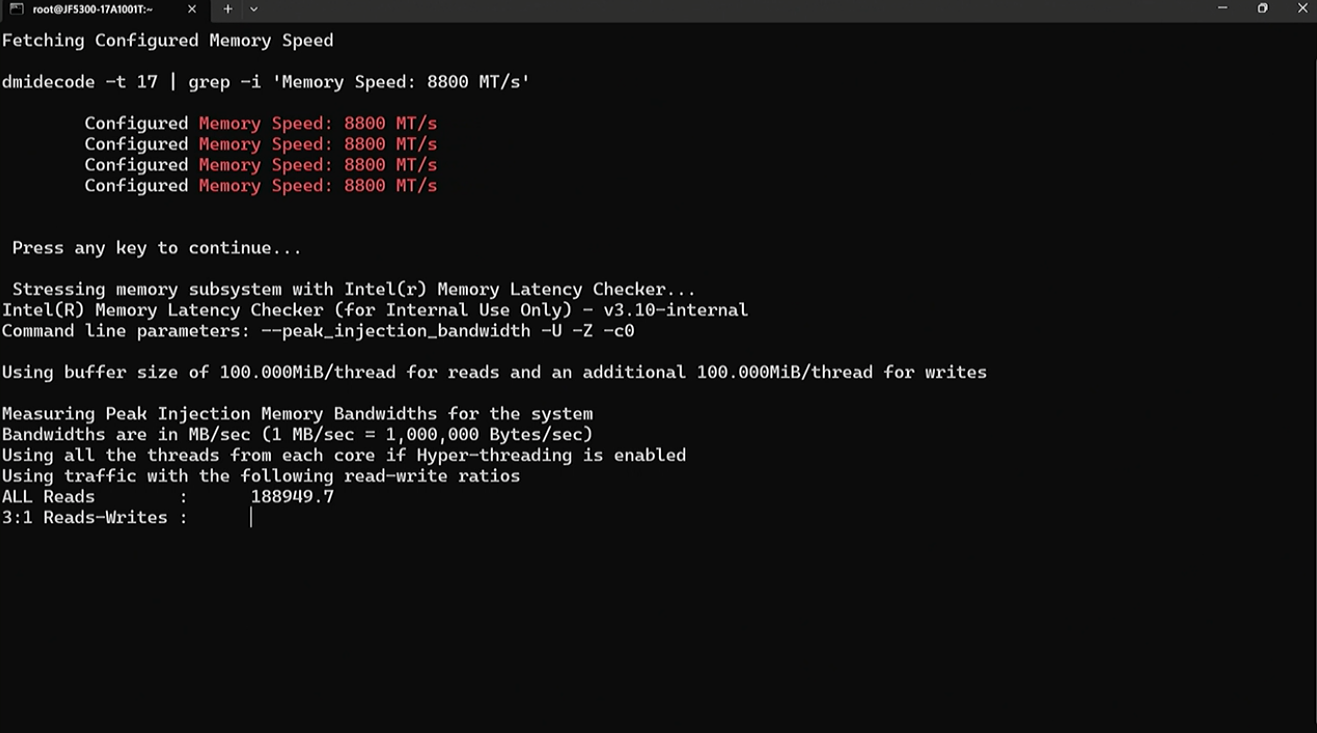

Intel hizo una demostración de un Granite Rapids de doble zócalo que proporciona un increíble ancho de banda de memoria DDR5 de 1,5 TB/s durante su seminario web, una mejora del ancho de banda máximo del 80 % con respecto a la memoria del servidor existente. En perspectiva, Granite Rapids proporciona más rendimiento que el superchip de CPU Grace de 960 GB/s de Nvidia, que está diseñado específicamente para el ancho de banda de la memoria, y más que el Genoa de doble socket de AMD, que tiene un pico teórico de 920 GB/s.

Intel logró esta hazaña utilizando DDR5-8800 Multiplexer Combined Rank (MCR) DRAM, un nuevo tipo de memoria optimizada para ancho de banda que inventó. Intel ya ha presentado esta memoria con SK hynix.

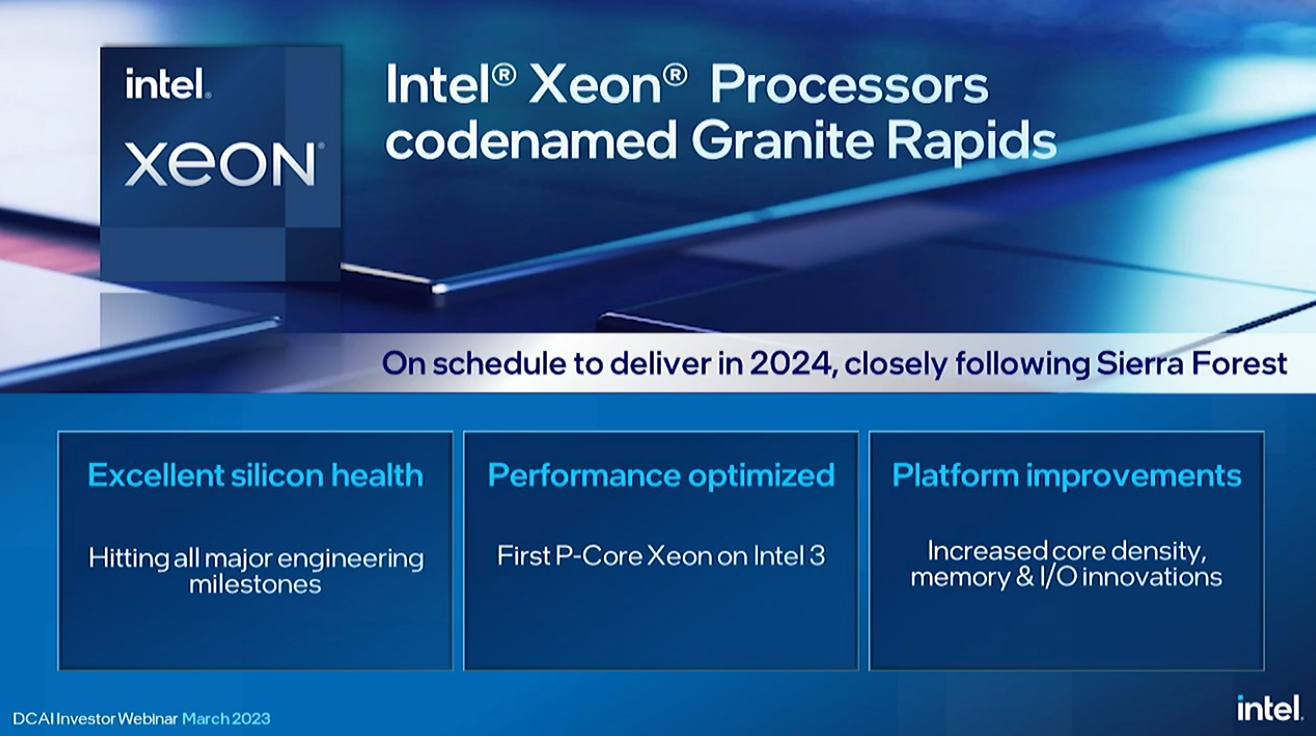

Granite Rapids llegará en 2024, siguiendo de cerca a Sierra Forest. Intel fabricará este chip en el proceso ‘Intel 3’, que es una versión muy mejorada del proceso ‘Intel 4’ que carecía de las bibliotecas de alta densidad necesarias para Xeon. Este es el primer p-core Xeon en ‘Intel 3’ y contará con más núcleos que Emerald Rapids, mayor ancho de banda de memoria de la memoria DDR5-8800 y otras innovaciones de E/S no especificadas. Este chip está muestreando a los clientes ahora.

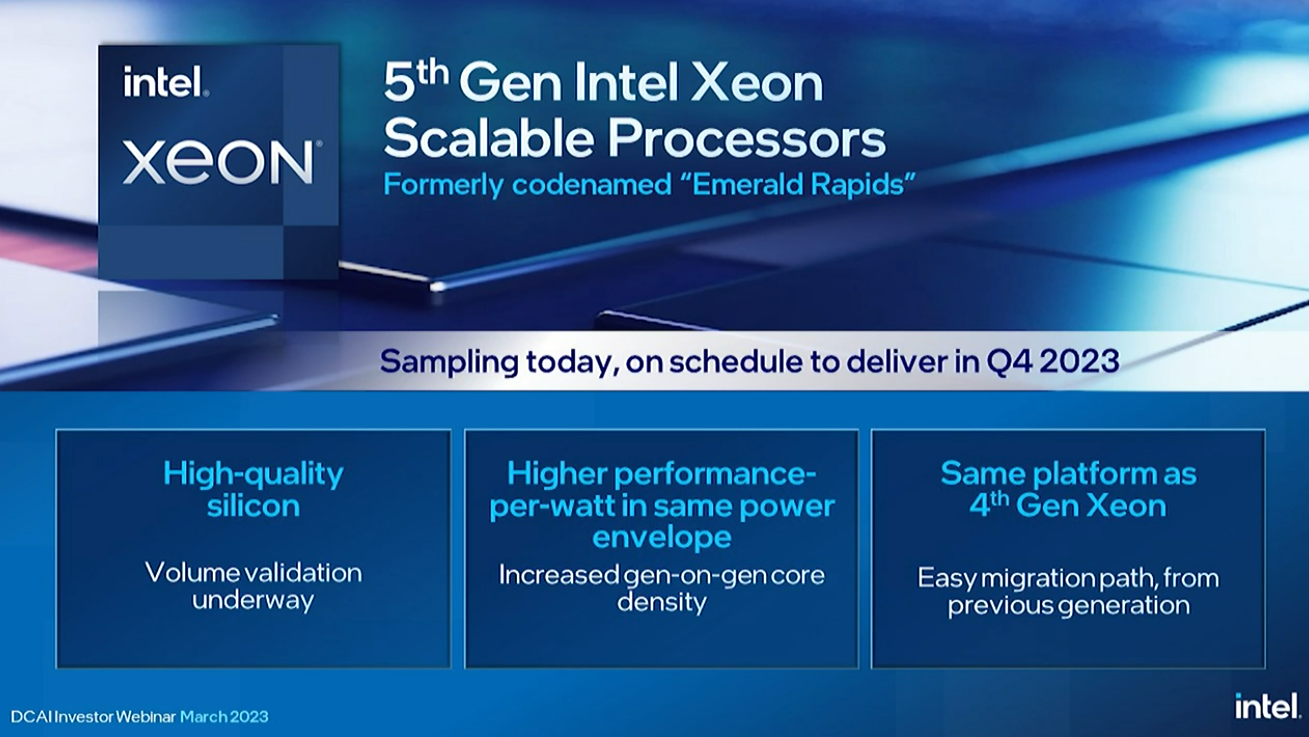

Rivera nos mostró el próximo chip Emerald Rapids de la compañía. El lanzamiento de Emerald Rapids de próxima generación de Intel está programado para el cuarto trimestre de este año, que es un período de tiempo comprimido dado que Sapphire Rapids se lanzó hace unos meses.

Intel dice que proporcionará un rendimiento más rápido, una mejor eficiencia energética y, lo que es más importante, más núcleos que su predecesor. Intel dice que tiene el silicio Emerald Rapids internamente y que la validación está progresando como se esperaba, con el silicio cumpliendo o superando sus objetivos de rendimiento y potencia.

Sapphire Rapids de Intel es compatible con su tecnología AMX que potencia la IA, que utiliza diferentes tipos de datos y procesamiento de vectores para aumentar el rendimiento. Lisa Spelman realizó una demostración que mostró que un Sapphire Rapids de 48 núcleos supera a un EPYC Genoa de 48 núcleos por 3,9 veces en una amplia gama de cargas de trabajo de IA.

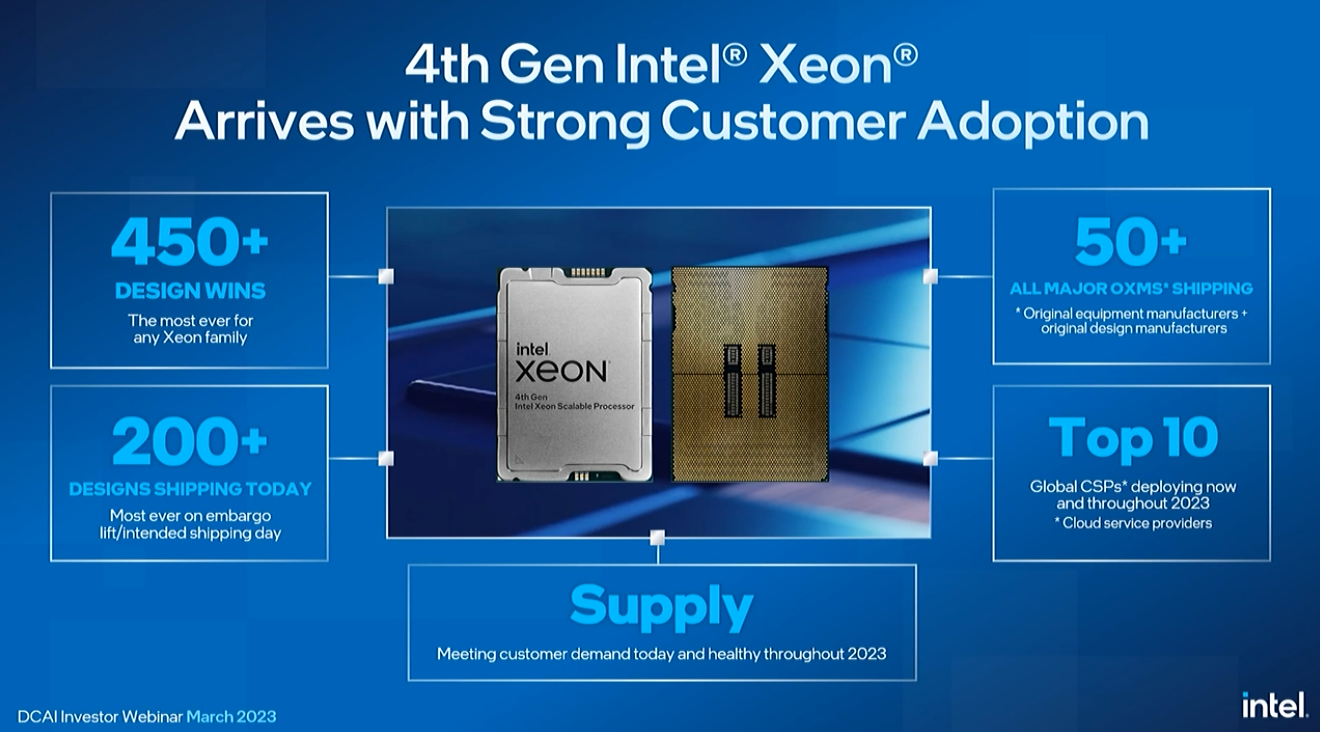

Intel ha lanzado su Sapphire Rapids, con más de 450 diseños ganadores y más de 200 diseños enviados por los principales OEM. Intel afirma una mejora de eficiencia de 2.9X generación tras generación.

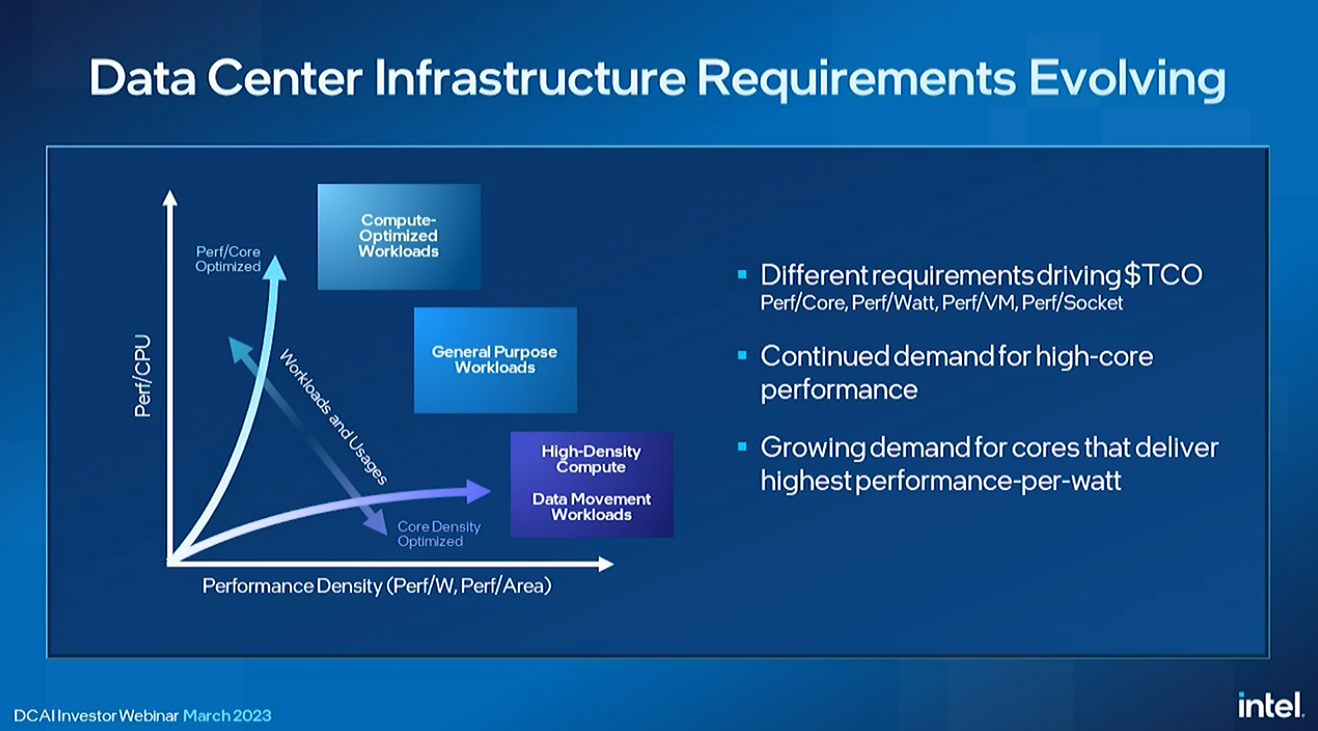

Intel ha dividido su hoja de ruta Xeon en dos líneas, una con núcleos P y otra con núcleos electrónicos, cada una con sus propias ventajas. Los modelos P-Core (Performance Core) son el procesador de centro de datos Xeon tradicional con solo núcleos que brindan el rendimiento total de las arquitecturas más rápidas de Intel. Estos chips están diseñados para un rendimiento superior por núcleo y de carga de trabajo de IA. También vienen emparejados con aceleradores, como vemos con Sapphire Rapids.

La línea E-Core (Efficiency Core) consta de chips con núcleos de eficiencia más pequeños, muy parecidos a los que vemos presentes en los chips de consumo de Intel, que evitan algunas funciones, como AMX y AVX-512, para ofrecer una mayor densidad. Estos chips están diseñados para una alta eficiencia energética, densidad de núcleo y rendimiento total que es atractivo para los hiperescaladores. Los procesadores Xeon de Intel no tendrán ningún modelo con núcleos P y núcleos E en el mismo silicio, por lo que se trata de familias distintas con casos de uso distintos.

Los E-cores están diseñados para combatir a los competidores de Arm.

Intel está trabajando para desarrollar una amplia cartera de soluciones de software para complementar su cartera de chips.

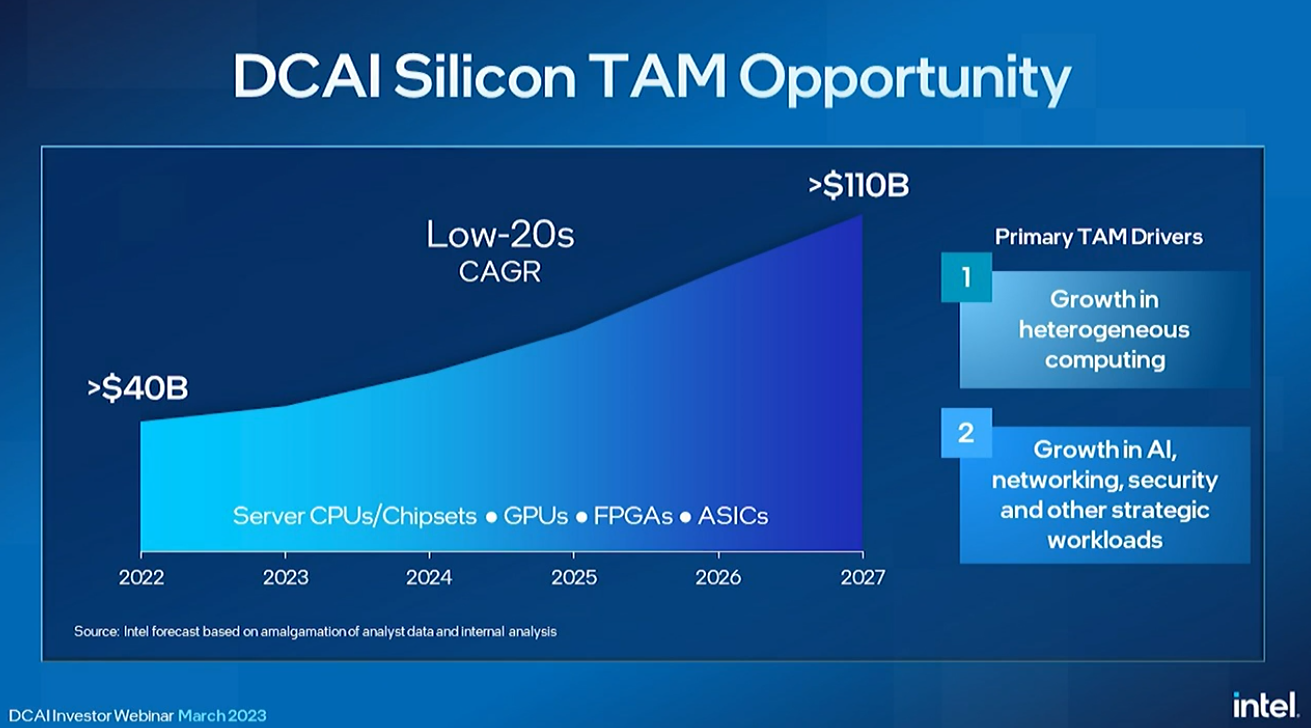

Rivera explicó que Intel a menudo mira a través de la lente de las CPU para medir los ingresos totales de su centro de datos, pero ahora está ampliando su alcance para incluir diferentes tipos de cómputo, como GPU y aceleradores personalizados.

Sandra Rivera ha subido al escenario para señalar que cubrirá la hoja de ruta del nuevo centro de datos, el mercado total direccionable (TAM) para el negocio de centros de datos de Intel, que valora en 110.000 millones de dólares, y los esfuerzos de Intel en el ámbito de la IA.