Investigadores de la Universidad de California e Intel han desarrollado un algoritmo complejo que aprovecha la IA y algunas rutinas inteligentes para extrapolar nuevos cuadros, con afirmaciones de menor latencia de entrada que los métodos actuales de generación de cuadros, todo ello manteniendo una buena calidad de imagen. No hay indicios de que Intel esté planeando implementar el sistema para sus GPU Arc por el momento, pero si el trabajo continúa, probablemente tendremos alguna generación de cuadros con tecnología Intel en un futuro cercano.

Anunciado en el evento Siggraph Asia de este año en Australia (a través de Wccftech), un grupo de investigadores de la Universidad de California recibió el patrocinio y el apoyo de Intel para desarrollar un sistema que crea marcos artificialmente para aumentar el rendimiento de los juegos y otras aplicaciones que realizan renderizado.

Más comúnmente conocido como generación de cuadros, todos estamos familiarizados con esto desde que Nvidia lo incluyó con su paquete DLSS 3 en 2022. Ese sistema utiliza una red neuronal de aprendizaje profundo, junto con un sofisticado análisis de flujo óptico, para examinar dos cuadros renderizados y producir uno completamente nuevo, que se inserta entre ellos. Técnicamente, esto es interpolación de cuadros y se ha utilizado en el mundo de los televisores durante años.

A principios de este año, AMD nos ofreció su versión de generación de fotogramas en FSR 3, pero en lugar de depender de la IA para hacer todo el trabajo pesado, los ingenieros desarrollaron el mecanismo para que funcione completamente a través de sombreadores.

Sin embargo, tanto AMD como Nvidia tienen un pequeño problema con sus tecnologías de generación de cuadros, y es un aumento en la latencia entre las entradas de un reproductor y luego verlas en acción en la pantalla. Esto sucede porque se deben renderizar dos fotogramas completos. primero antes de que se pueda generar el interpolado y luego insertarlo en la cadena de fotogramas.

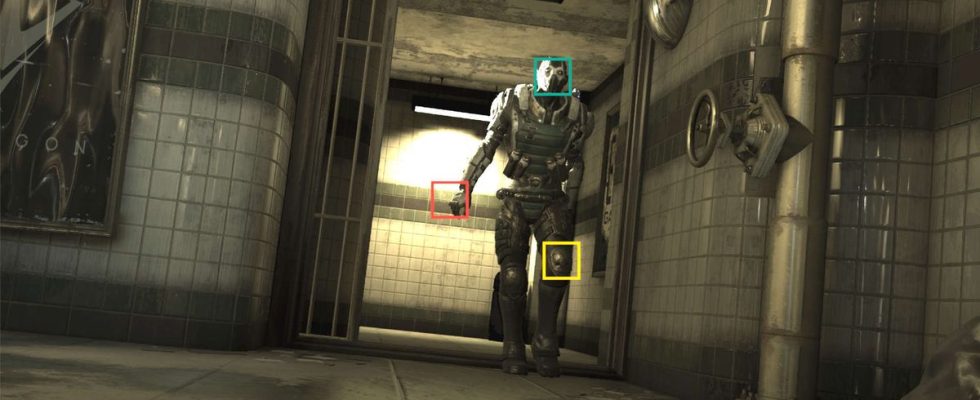

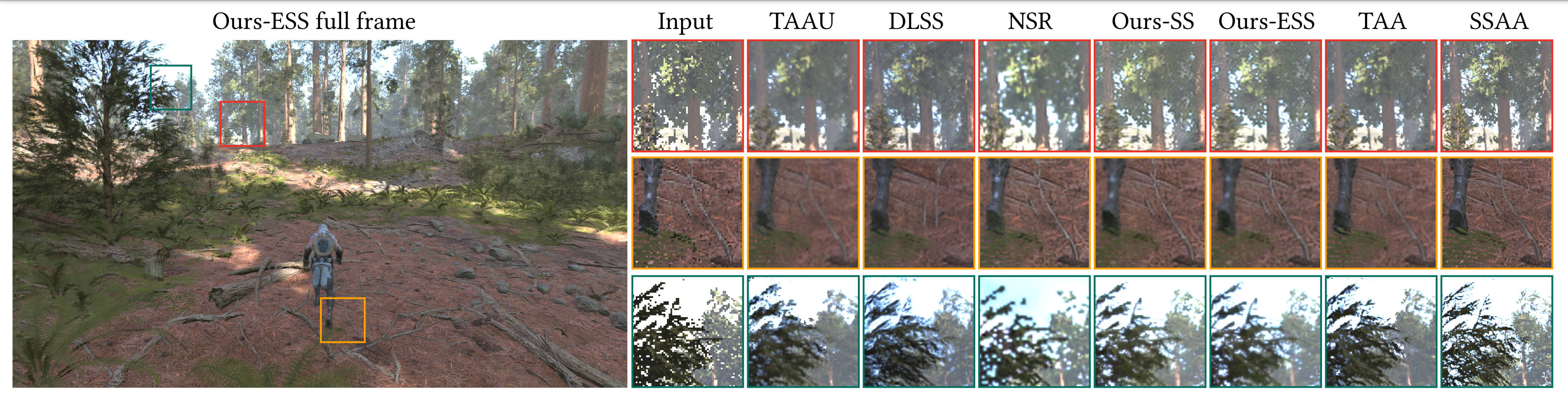

El nuevo método propuesto por Intel y la UoC es bastante diferente. En primer lugar, es tres métodos, todos reunidos en un largo algoritmo. La etapa inicial evita el uso de vectores de movimiento o análisis de flujo óptico y, en cambio, se basa en algunas matemáticas inteligentes para examinar los buffers geométricos creados durante la renderización de fotogramas anteriores.

Esa etapa genera un nuevo marco parcialmente completo que luego se introduce en la siguiente etapa de todo el proceso, junto con otros datos. Aquí, se utiliza una pequeña red neuronal para rematar las partes que faltan. Las salidas de las etapas uno y dos luego pasan por el paso final, que involucra otra red neuronal.

Es demasiado complejo para entrar en detalles aquí, pero el resultado es lo único que importa: un fotograma generado que es extrapolado de fotogramas anteriores e insertados después a ellos. Aún obtendrás un poco de latencia de entrada pero, en teoría, debería ser menor que la que obtienes con los métodos de AMD y Nvidia, pero los fotogramas reales se presentan inmediatamente después del renderizado.

Si esto suena demasiado bueno para ser verdad, hay una advertencia notable sobre todo esto y su rendimiento. Los investigadores probaron cuánto tiempo tardaría en ejecutarse el algoritmo, utilizando una GeForce RTX 3090 y TensorRT para manejar las redes neuronales.

A partir de 540p y el fotograma final generado a 1080p, el proceso tardó 4,1 milisegundos en completarse. Eso es muy rápido, aunque el artículo de investigación también señala que a partir de 1080p, el algoritmo tardó 13,7 ms y eso equivale a un rendimiento de 72 fps.

Claramente se trabajará más en todo el asunto y cualquier implementación del mismo necesitaría un sistema adicional para gestionar el ritmo de los fotogramas reales y falsos; de lo contrario, los fps aumentarían por todas partes.

Y si Intel lo lanza al mercado, el hecho de que ejecute dos redes neuronales significa que cualquier GPU con hardware de matriz dedicado sería una clara ventaja (es decir, Intel y Nvidia).

Sin embargo, una cosa es segura: la mejora y la generación de fotogramas llegaron para quedarse y serán cada vez más importantes en la forma en que las tarjetas gráficas y los juegos funcionarán juntos en el futuro.

Puede que no seas fanático de ellos en este momento, pero eventualmente llegará un momento en el que no podrás notarlos en acción. Simplemente disfrutarás del juego, ya sea con mega niveles de gráficos o velocidades de fotogramas súper altas.