Un estudio publicado el lunes en la revista Psychologic Science, revisada por pares, encontró que los rostros generados por IA con tecnología de hace tres años, particularmente aquellos que representan a individuos blancos, se percibían como más reales que fotografías de rostros reales, informa The Guardian. El hallazgo no se extendió a imágenes de personas de color, probablemente debido a que los modelos de IA se entrenan predominantemente en imágenes de personas blancas, un sesgo común que es bien conocido en la investigación del aprendizaje automático.

En el artículo titulado «Hiperrealismo de la IA: por qué las caras de la IA se perciben como más reales que las humanas», investigadores de la Universidad Nacional de Australia, la Universidad de Toronto, la Universidad de Aberdeen y el University College de Londres acuñaron el término en el título del artículo, hiperrealismo. que definen como un fenómeno en el que la gente piensa que los rostros generados por IA son más reales que los rostros humanos reales.

En sus experimentos, los investigadores presentaron a adultos blancos una mezcla de 100 rostros blancos generados por IA y 100 rostros blancos reales, pidiéndoles que identificaran cuáles eran reales y su confianza en su decisión. De 124 participantes, el 66 por ciento de las imágenes de IA fueron identificadas como humanas, en comparación con el 51 por ciento de las imágenes reales. Esta tendencia, sin embargo, no se observó en imágenes de personas de color, donde tanto la IA como los rostros reales fueron juzgados como humanos alrededor del 51 por ciento de las veces, independientemente de la raza del participante.

Los investigadores utilizaron imágenes reales y sintéticas procedentes de un estudio anterior, y las sintéticas generadas por el generador de imágenes StyleGAN2 de Nvidia, que puede crear rostros realistas mediante la síntesis de imágenes. Vale la pena señalar que StyleGAN2 se lanzó en 2020 y la síntesis de imágenes de IA ha progresado rápidamente desde entonces, pero los modelos de IA más nuevos no participaron en el estudio.

La investigación también mostró que los participantes que con frecuencia identificaban erróneamente rostros mostraban una mayor confianza en sus juicios, lo que, según los investigadores, es una manifestación del efecto Dunning-Kruger. En otras palabras, las personas que tenían más confianza se equivocaban con mayor frecuencia.

Molinero y cols.

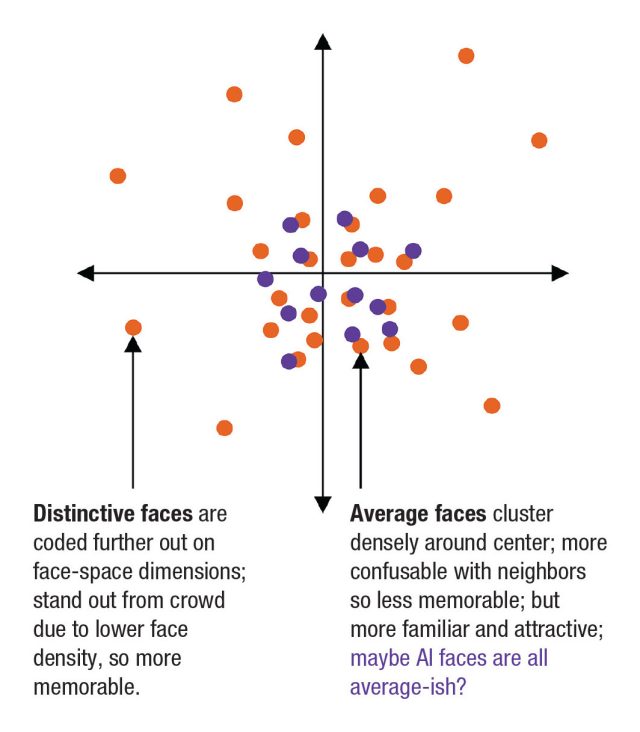

En un segundo experimento, con 610 adultos, los participantes calificaron la IA y los rostros humanos según varios atributos sin saber que algunos eran generados por la IA, y los investigadores utilizaron la teoría del «espacio facial» para identificar atributos faciales específicos. El análisis de las respuestas de los participantes sugirió que factores como una mayor proporcionalidad, familiaridad y menos memorabilidad llevaron a la creencia errónea de que los rostros de la IA eran humanos. Básicamente, los investigadores sugieren que el atractivo y el «promedio» de los rostros generados por IA los hacían parecer más reales para los participantes del estudio, mientras que la gran variedad de proporciones en los rostros reales parecía irreal.

Curiosamente, mientras los humanos luchaban por diferenciar entre caras reales y generadas por IA, los investigadores desarrollaron un sistema de aprendizaje automático capaz de detectar la respuesta correcta el 94 por ciento de las veces.

Los hallazgos del estudio plantean preocupaciones sobre la perpetuación de los prejuicios sociales y la combinación de raza con percepciones de ser «humano», lo que podría tener implicaciones en áreas como la localización de niños desaparecidos, donde a veces se utilizan rostros generados por IA. Y la incapacidad de las personas para detectar rostros sintéticos, en general, puede dar lugar a fraude o robo de identidad.

El Dr. Zak Witkower, coautor de la Universidad de Amsterdam, dijo a The Guardian que el fenómeno podría tener consecuencias de gran alcance en diversos campos, desde la terapia en línea hasta la robótica. «Va a producir situaciones más realistas para los rostros blancos que para otros rostros raciales», dijo.

La Dra. Clare Sutherland, otra coautora de la Universidad de Aberdeen, enfatizó a The Guardian la importancia de abordar los sesgos en la IA. «A medida que el mundo cambia extremadamente rápido con la introducción de la IA», dijo, «es fundamental que nos aseguremos de que nadie quede atrás o en desventaja en ninguna situación, ya sea por origen étnico, género, edad o cualquier otra característica protegida». «.

Clave de respuestas para la imagen de arriba. ¿Cuáles son reales? De izquierda a derecha fila superior: 1. Falso, 2. Falso, 3. Real, 4. Falso. De izquierda a derecha, fila inferior: 1. Real, 2. Falso, 3. Real, 4. Real.