Nvidia, que acaba de ganar más de 10.000 millones de dólares en un trimestre con sus GPU informáticas orientadas a centros de datos, planea al menos triplicar la producción de dichos productos en 2024, según el Tiempos financieros, que cita fuentes con conocimiento del asunto. La medida es muy ambiciosa y si Nvidia logra lograrlo y la demanda de sus CPU A100, H100 y otras CPU para aplicaciones de inteligencia artificial (IA) y computación de alto rendimiento (HPC) sigue siendo fuerte, esto podría significar ingresos increíbles para la empresa. .

La demanda de la GPU de cómputo insignia H100 de Nvidia es tan alta que se agotaron hasta bien entrado 2024, informa el FT. La compañía tiene la intención de aumentar la producción de sus procesadores GH100 al menos tres veces, afirma el sitio empresarial, citando a tres personas familiarizadas con los planes de Nvidia. Los envíos proyectados del H100 para 2024 oscilan entre 1,5 millones y 2 millones, lo que marca un aumento significativo con respecto a las 500.000 unidades previstas para este año.

Debido a que el marco CUDA de Nvidia está diseñado para cargas de trabajo de IA y HPC, existen cientos de aplicaciones que solo funcionan en las GPU informáticas de Nvidia. Si bien tanto Amazon Web Services como Google tienen sus propios procesadores de IA personalizados para cargas de trabajo de inferencia y entrenamiento de IA, también tienen que comprar grandes cantidades de GPU de computación Nvidia ya que sus clientes quieren ejecutar sus aplicaciones en ellas.

Pero aumentar el suministro de GPU de cómputo Nvidia H100, la plataforma de supercomputación GH200 Grace Hopper y los productos basados en su base no será fácil. El GH100 de Nvidia es un procesador complejo y bastante difícil de fabricar. Para triplicar su producción, tiene que deshacerse de varios obstáculos.

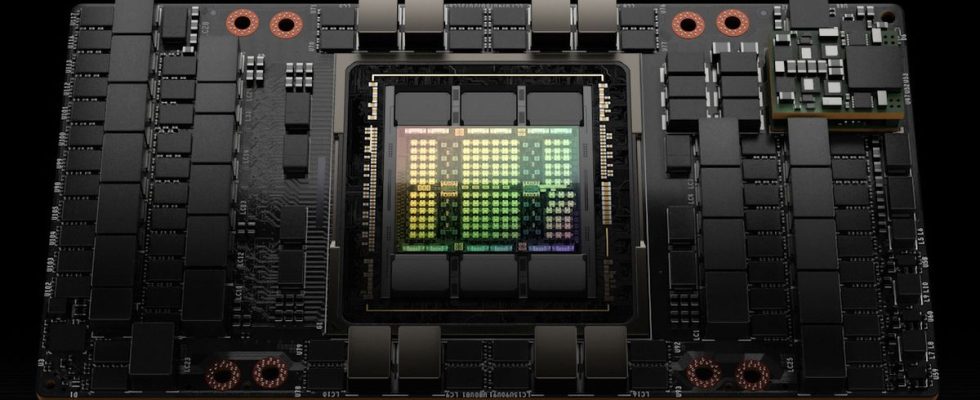

En primer lugar, la GPU de cómputo GH100 es una enorme pieza de silicio con un tamaño de 814 mm^2, por lo que es bastante difícil fabricarla en grandes volúmenes. Aunque es probable que los rendimientos del producto sean razonablemente altos a estas alturas, Nvidia todavía necesita asegurar una gran cantidad de suministro de obleas 4N de TSMC para triplicar la producción de sus productos basados en GH100. Una estimación aproximada sugiere que TSMC y Nvidia pueden obtener como máximo 65 chips por oblea de 300 mm.

Por lo tanto, fabricar 2 millones de estos chips requeriría casi 31.000 obleas; ciertamente es posible, pero es una fracción considerable de la producción total de obleas de clase 5 nm de TSMC, que es alrededor de 150.000 por mes. Y esa capacidad se comparte actualmente entre CPU/GPU AMD, Apple, Nvidia y otras empresas.

En segundo lugar, el GH100 depende de la memoria HBM2E o HBM3 y utiliza el paquete CoWoS de TSMC, por lo que Nvidia también necesita asegurar el suministro en este frente. En este momento, TSMC está luchando por satisfacer la demanda de envases CoWoS.

En tercer lugar, debido a que los dispositivos basados en H100 usan memoria HBM2E, HBM3 o HBM3E, Nvidia tendrá que obtener suficientes paquetes de memoria HBM de compañías como Micron, Samsung y SK Hynix.

Finalmente, las tarjetas de cómputo H100 de Nvidia o los módulos SXM deben instalarse en algún lugar, por lo que Nvidia deberá asegurarse de que sus socios también al menos tripliquen la producción de sus servidores de IA, lo cual es otra preocupación.

Pero si Nvidia puede suministrar todas las GPU H100 necesarias, ciertamente obtendrá enormes ganancias con el esfuerzo el próximo año.