Si bien Habana Gaudi de Intel ofrece un rendimiento algo competitivo y viene con el paquete de software Habana SynapseAI, aún se queda corto en comparación con las GPU de cómputo habilitadas para CUDA de Nvidia. Esto, junto con la disponibilidad limitada, es la razón por la que Gaudi no ha sido tan popular para los modelos de lenguaje extenso (LLM) como ChatGPT.

Ahora que la fiebre de la IA está en marcha, Habana de Intel está experimentando implementaciones más amplias. Amazon Web Services decidió probar la primera generación de Gaudí de Intel con PyTorch y DeepSpeed para capacitar a los LLM, y los resultados fueron lo suficientemente prometedores como para ofrecer instancias DL1 EC2 comercialmente.

Entrenar modelos de lenguaje grande (LLM) con miles de millones de parámetros presenta desafíos. Necesitan técnicas de formación especializadas, teniendo en cuenta las limitaciones de memoria de un único acelerador y la escalabilidad de múltiples aceleradores trabajando en conjunto. Los investigadores de AWS utilizaron DeepSpeed, una biblioteca de optimización de aprendizaje profundo de código abierto para PyTorch diseñada para mitigar algunos de los desafíos de capacitación de LLM y acelerar el desarrollo y la capacitación de modelos, e instancias Amazon EC2 DL1 basadas en Intel Habana Gaudi para su trabajo. Los resultados que lograron parecen muy prometedores.

Los investigadores crearon un clúster informático administrado con AWS Batch, que consta de 16 instancias dl1.24xlarge, cada una con ocho aceleradores Habana Gaudi y 32 GB de memoria y una red RoCE de malla completa entre tarjetas con un ancho de banda de interconexión bidireccional total de 700 Gbps cada una. Además, el clúster estaba equipado con cuatro adaptadores AWS Elastic Fabric con un total de 400 Gbps de interconexión entre nodos.

Por el lado del software, los investigadores utilizaron optimizaciones de DeepSpeed ZeRO1 para entrenar previamente el modelo BERT 1.5B con varios parámetros. El objetivo era optimizar el rendimiento del entrenamiento y la rentabilidad. Para garantizar la convergencia del modelo, se ajustaron los hiperparámetros y el tamaño de lote efectivo por acelerador se fijó en 384, con microlotes de 16 por paso y 24 pasos de acumulación de gradiente.

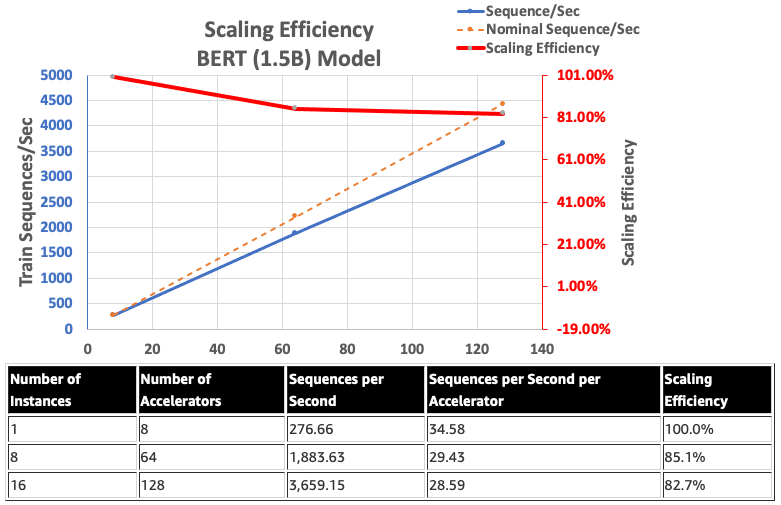

La eficiencia de escalado de Intel HabanaGaudi tiende a ser relativamente alta y nunca cae por debajo del 90 %, con ocho instancias y 64 aceleradores que ejecutan un modelo BERT de 340 millones.

Mientras tanto, mediante el uso de la compatibilidad nativa con BF16 de Gaudí, los investigadores de AWS redujeron los requisitos de tamaño de memoria y aumentaron el rendimiento del entrenamiento en comparación con el FP32 para permitir 1500 millones de modelos BERT. Lograron una eficiencia de escalado del 82,7 % en 128 aceleradores utilizando optimizaciones de etapa 1 de DeepSpeed ZeRO para un modelo BERT con 340 millones a 1500 millones de parámetros.

En general, los investigadores de AWS descubrieron que, al usar el software Habana SynapseAI v1.5/v1.6 adecuado con DeepSpeed y múltiples aceleradores Habana Gaudi, un modelo BERT con 1500 millones de parámetros podría entrenarse previamente en 16 horas, alcanzando la convergencia en una red de 128 Aceleradores Gaudí, consiguiendo una eficiencia de escalado del 85%. La arquitectura se puede evaluar en el Workshop de AWS.