Por un par de miles de dólares al mes, ahora puede reservar la capacidad de una sola GPU Nvidia HGX H100 a través de una empresa llamada CoreWeave. El H100 es el sucesor del A100, la GPU que fue fundamental en el entrenamiento de ChatGPT en LLM (modelos de lenguaje grande). Los precios comienzan en $2.33 por hora, eso es $56 por día o alrededor de $20,000 por año; en comparación, un solo HGX H100 cuesta alrededor de $ 28,000 en el mercado abierto (NVH100TCGPU-KIT) y menos al por mayor.

Pagará más por los precios al contado ($ 4,76 por hora) y aunque hay un SKU más económico disponible (HGX H100 PCIe, a diferencia del modelo NVLINK), aún no se puede pedir. Una configuración de instancia de GPU válida debe incluir al menos una GPU, al menos una vCPU y al menos 2 GB de RAM. Al implementar un servidor privado virtual (VPS), la configuración de la instancia de GPU también debe incluir al menos 40 GB de almacenamiento de nivel NVMe en el disco raíz.

La noticia llega después de una serie de anuncios en el GTC 2023 de Nvidia, donde la IA generativa estaba a la izquierda, a la derecha y al centro. La tecnología emplea capacitación LLM que permite el trabajo creativo, incluida la redacción de artículos académicos, una rutina de comedia stand-up o un soneto; el diseño de obras de arte a partir de un bloque de texto; y en el caso de NovelAI, uno de los primeros clientes de CoreWeave, componiendo literatura.

Por supuesto, puede comprobar lo que han hecho nuestros compañeros en Tomshardware y ejecutar una alternativa de ChatGPT en su PC local.

Monopolio de Nvidia

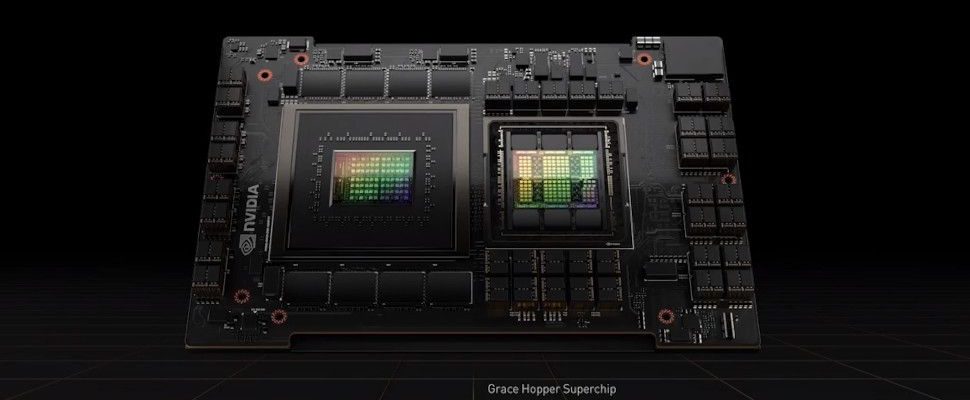

Jensen Huang, fundador y director ejecutivo de NVIDIA, supervisó el lanzamiento de una serie de GPU dirigidas a segmentos específicos del mercado de contenido de IA en rápida expansión: L4 para video de IA, L40 para generación de imágenes y H100 NVL (básicamente dos H100 en un configuración tipo SLI). Nvidia, que cumplirá 30 años en abril de 2023, quiere capturar la mayor parte del mercado posible ofreciendo hardware y software con miras a implementar su propio hardware como servicio.

ha desvelado un versión en la nube de su DGX H100 servidor, uno que incluye ocho tarjetas H100 y se puede alquilar por poco menos de $ 37,000 de Oracle con Microsoft y Google próximamente. Aunque suene caro, tenga en cuenta que la DGX H100 cuesta más que $500,000 del proveedor empresarial Insighty eso excluye el costo de ejecutar realmente el dispositivo (mantenimiento, colocación, servicios públicos, etc.).

Es probable que el repentino interés de Nvidia en convertirse en un proveedor de servicios propio haga que sus socios se sientan un poco incómodos. El presidente de la TIEA (Taiwan Internet and E-Commerce Association), que agrupa a algunos de los nombres más importantes en la industria del hardware tecnológico, fue lo suficientemente lúcido como para declarar ayer que la empresa «incurrirá en una competencia conjunta» con los principales proveedores de servicios en la nube (CSP), y probablemente acelerará la búsqueda de una alternativa a Nvidia, para establecer un equilibrio.

Todos los ojos están puestos en AMD (con su GPU Instinct MI300) e Intel, pero al acecho en las sombras hay una lista de retadores (Graphcore, Cerebras, Kneron, IBM y otros) que querrán una parte de un pastel en crecimiento.