Actualizar

Jensen comienza con una discusión sobre las crecientes demandas del mundo digital moderno, con un crecimiento que a veces supera la tasa de la Ley de Moore. Escucharemos a varios líderes en la industria de IA, robótica, vehículos autónomos, fabricación, ciencia y más.

«El propósito de GTC es inspirar al mundo en el arte de lo posible de la computación acelerada y celebrar los logros de los científicos que la utilizan».

Y ahora tenemos el último video introductorio de «I Am AI», un elemento básico del GTC durante los últimos años. Se actualiza cada vez con nuevos segmentos, aunque la composición musical subyacente no parece haber cambiado en absoluto. ChatGPT apareció, «ayudando a escribir este guión».

No es de extrañar, Jensen está comenzando la cobertura detallada con ChatGPT y OpenAI. Una de las revoluciones de aprendizaje profundo más famosas fue con AlexNet en 2012, un algoritmo de reconocimiento de imágenes que necesita 262 petaflops de cómputo. Ahora, uno de esos investigadores está en OpenAI, y GPT-3 requirió 323 zettaflops de cálculos para el entrenamiento. Eso es más de un millón de veces la cantidad de cálculos numéricos solo una década después. Eso es lo que se requería como base de ChatGPT.

Junto con los cálculos necesarios para los modelos de entrenamiento utilizados en el aprendizaje profundo, Nvidia tiene cientos de bibliotecas para ayudar a diversas industrias y modelos. Jensen está revisando un montón de las bibliotecas y compañías más grandes que las usan.

La plataforma cuántica de Nvidia, incluido cuQuantum, por ejemplo, se utiliza para ayudar a los investigadores en el campo de la computación cuántica. La gente está prediciendo que en algún momento de la próxima década o dos (¿o tres?), veremos que la computación cuántica pasa de ser teórica a ser práctica.

Jensen ahora está hablando sobre el problema del vendedor ambulante y el algoritmo NP-Hard donde no hay una solución eficiente. Es algo con lo que tienen que lidiar muchas empresas del mundo real, el problema de la recogida y la entrega. El hardware y las bibliotecas de Nvidia han ayudado a establecer un nuevo récord en el cálculo de rutas óptimas para la tarea, y AT&T está utilizando la tecnología en su empresa.

Mucha más discusión sobre otras bibliotecas, incluidas cuOpt, Triton, CV-CUDA (para visión por computadora), VPF (codificación y decodificación de video Python), campos médicos y más. El costo de la secuenciación del genoma ahora se ha reducido a $ 100, aparentemente, gracias a la tecnología de Nvidia. (No se preocupe, es probable que alguien aún le cobre muchas veces más si necesita secuenciar su ADN).

Este es grande, cuLitho, una nueva herramienta para ayudar a optimizar uno de los pasos más importantes en el diseño de los procesadores modernos. Tenemos una inmersión más profunda por separado en la litografía computacional de Nvidia, pero básicamente la creación de los patrones y las máscaras utilizadas para los últimos procesos de litografía son extremadamente complejos y Nvidia dice que los cálculos detrás de una sola máscara pueden llevar semanas. cuLitho, una biblioteca para litografía computacional, proporciona hasta 40 veces el rendimiento de las herramientas utilizadas actualmente.

Con cuLitho, una sola retícula que antes tomaba dos semanas ahora se puede procesar en ocho horas. También se ejecuta en 500 sistemas DGX en comparación con 40 000 servidores de CPU, lo que reduce los costos de energía en 9X.

Nvidia ha estado hablando sobre su Hopper H100 durante más de un año, pero ahora finalmente está en plena producción y se está implementando en muchos centros de datos, incluidos los de Microsoft Azure, Google, Oracle y más. El corazón de las últimas supercomputadoras DGX, que se muestra arriba, consta de ocho GPU H100 con disipadores de calor masivos empaquetados en un solo sistema.

Naturalmente, obtener su propia configuración de DGX H100 sería muy costoso, y las soluciones DGX Cloud las ofrecerán como servicios bajo demanda. Servicios como ChatGPT, Stable Diffusion, Dall-E y otros han aprovechado las soluciones en la nube para parte de su capacitación, y DGX Cloud tiene como objetivo abrir eso a más personas.

Jensen ahora está hablando de cómo la industria GPT (Transformador preentrenado generativo) necesita un equivalente de «base» para estos modelos: un software y aprendizaje profundo que tomen lo que TSMC hace para la industria de fabricación de chips. Con ese fin, está anunciando Nvidia AI Foundations.

Los clientes pueden trabajar con los expertos de Nvidia para entrenar y crear modelos, que pueden continuar actualizándose en función de las interacciones de los usuarios. Estos pueden ser modelos totalmente personalizados, incluidas cosas como la generación de imágenes basadas en bibliotecas de imágenes que ya se poseen. Piense en ello como Difusión estable, pero creado específicamente para una empresa como Adobe, Getty Images o Shutterstock.

Y no solo dejamos caer algunos nombres allí. Nvidia anunció que las tres compañías están trabajando con la herramienta Picasso de Nvidia, utilizando «imágenes profesionales con licencia responsable».

Nvidia AI Foundations también tiene BioNemo, una herramienta para ayudar con la investigación de medicamentos y la industria de recetas.

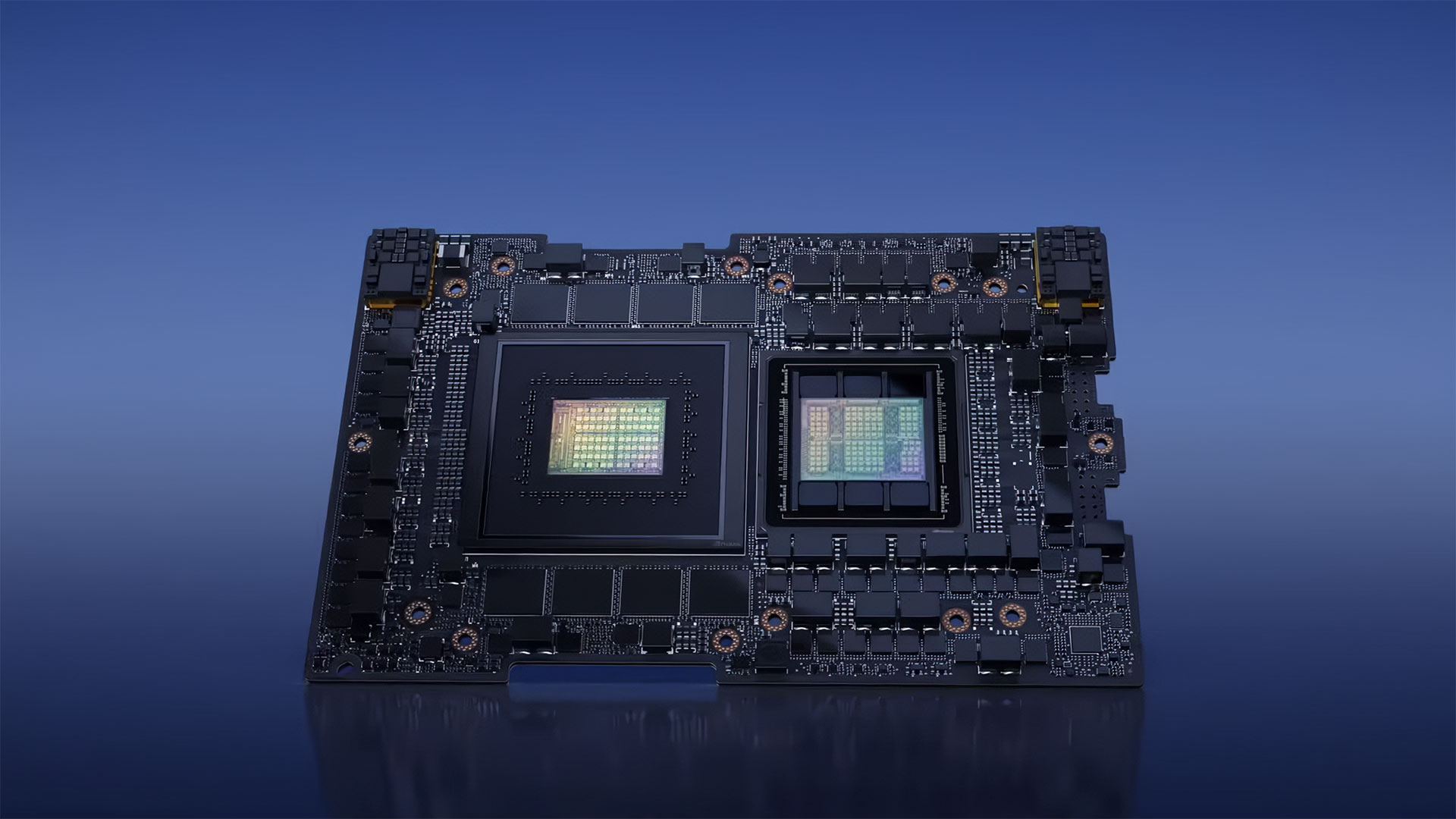

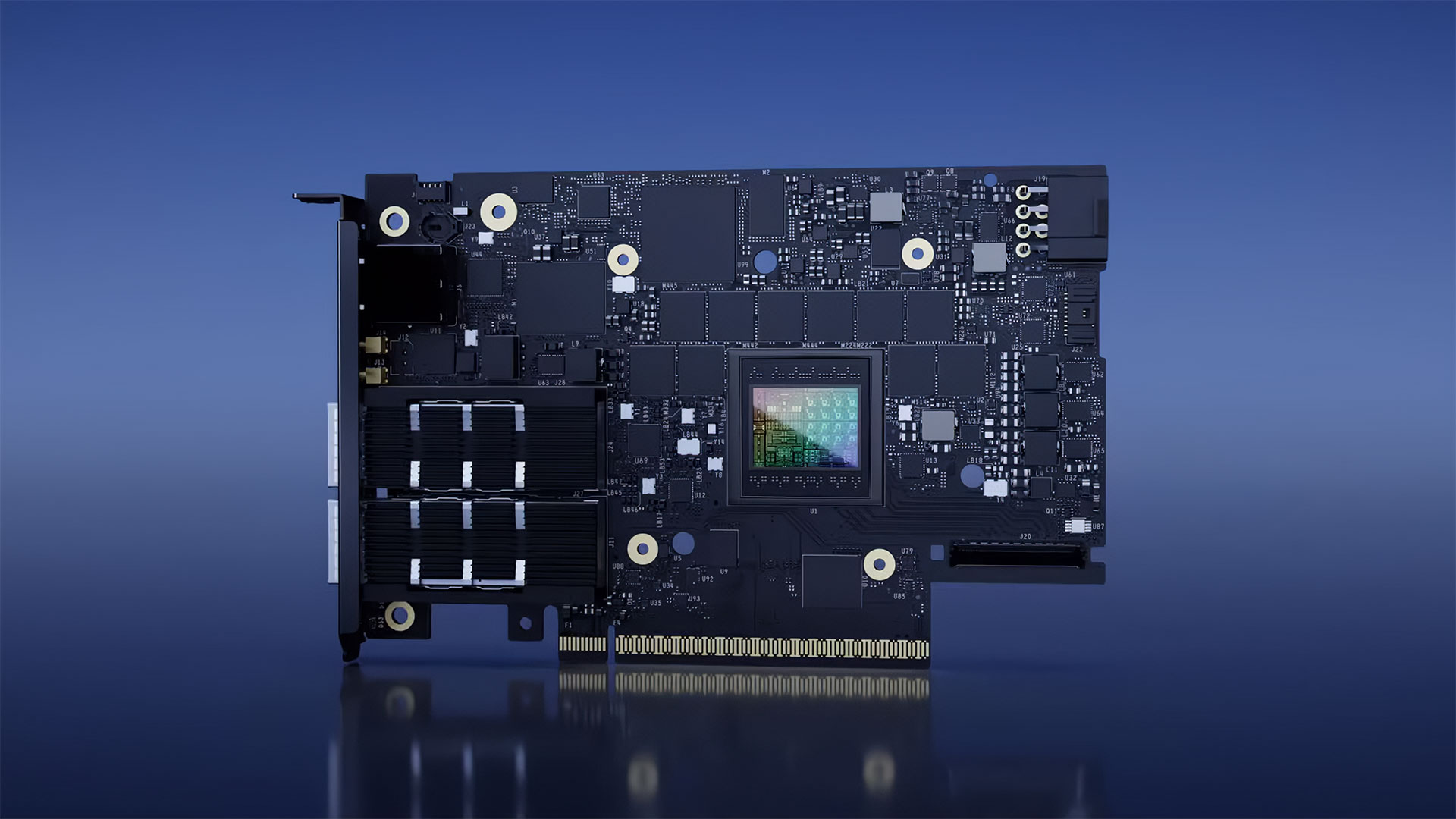

Una de las ventajas que ofrece Nvidia a las empresas es la idea de tener una única plataforma que pueda escalar hasta las instalaciones más grandes. Esta es la primera vez que escuchamos durante esta presentación en la que Nvidia menciona específicamente su solución Grace-Hopper, de la que hemos oído hablar en el pasado. Nvidia también anunció sus nuevos L4, L40 y H100 NVL.

Esto último es genial, ya que es una solución PCI Express que utiliza dos GPU Hopper H100 unidas por NVLink. Por sí solo, gracias a los 188 GB de memoria HBM3 total, puede manejar el modelo GPT-3 de 165 000 millones de parámetros. (En nuestra prueba de una alternativa de ChatGPT de ejecución local publicada a principios de esta semana, como ejemplo, incluso un RTX 4090 de 24 GB solo podía manejar hasta el modelo de 30 mil millones de parámetros).

Ahora pasamos a la robótica, con Amazon hablando de sus robots Proteus que fueron entrenados en Nvidia Isaac Sim y ahora se están implementando en los almacenes. Todo esto es gracias a Nvidia Omniverse y sus tecnologías relacionadas como Replicator, Digital Twins y más. Se están produciendo muchas otras caídas de nombres, para aquellos a los que les gusta hacer un seguimiento de esas cosas. En serio, la cantidad de nombres diferentes que Nvidia tiene para varias herramientas, bibliotecas, etc. es alucinante. Isaac Gym también es una cosa ahora, ¡alguien merece crédito por eso!

De todos modos, Omniverse cubre un enorme abanico de posibilidades. Cubre diseño e ingeniería, modelos de sensores, fabricantes de sistemas, creación y representación de contenido, robótica, datos sintéticos y activos 3D, integradores de sistemas, proveedores de servicios y gemelos digitales. (Sí, acabo de copiar todo eso de una diapositiva). Es grande y está haciendo muchas cosas útiles.

¡Oye, mira, hay Racer RTX otra vez! Supongo que se perdió la fecha de lanzamiento que se suponía que sería en noviembre pasado o algo así. Por otra parte, obtuvimos el increíblemente exigente Portal RTX en su lugar, por lo que tal vez sea mejor si Racer RTX obtiene un poco más de tiempo para las optimizaciones y cualquier otra cosa antes de que pueda convertirse en un juego / demostración / lo que sea completamente jugable.

Más Omniverse (¡tome otra oportunidad!), esta vez con los servidores OVX que vendrán de una variedad de proveedores. Estos incluyen GPU Nvidia L40 Ada RTX, además de los procesadores BlueField-3 de Nvidia para conectividad.

También habrá nuevas estaciones de trabajo, impulsadas por GPU Ada RTX, en configuraciones de escritorio y portátiles, «a partir de marzo». Lo que significa ahora, aparentemente. Fotos gratuitas de Grace, Grace-Hopper y BlueField-3 con doble CPU.

Y eso es un final para este discurso de apertura del GTC 2023. Jensen está repasando los diversos anuncios, pero sin duda habrá más que decir en los próximos días a medida que se revelen las presentaciones y más detalles. Gracias por unirte a nosotros.