Nvidia ha ofrecido nueva información sobre su próximo Grace CPU Superchip, un monstruo de 144 núcleos servidor Procesador diseñado para acelerar las cargas de trabajo de IA y HPC.

Antes de su presentación en Hot Chips 34, la compañía reveló el procesador se fabrica en una versión especializada del nodo de proceso de 4nm de TSMC que se ajusta a las características específicas de sus productos.

Team Green también publicó cifras de eficiencia energética para su interconexión NVLink-C2C (el «puente» que hace posible el superchip de doble CPU), que se dice que consume 5 veces menos energía que la interfaz PCIe 5.0 y ofrece hasta 900 GB/s de rendimiento, entre otros datos de referencia.

Superchip de CPU Grace

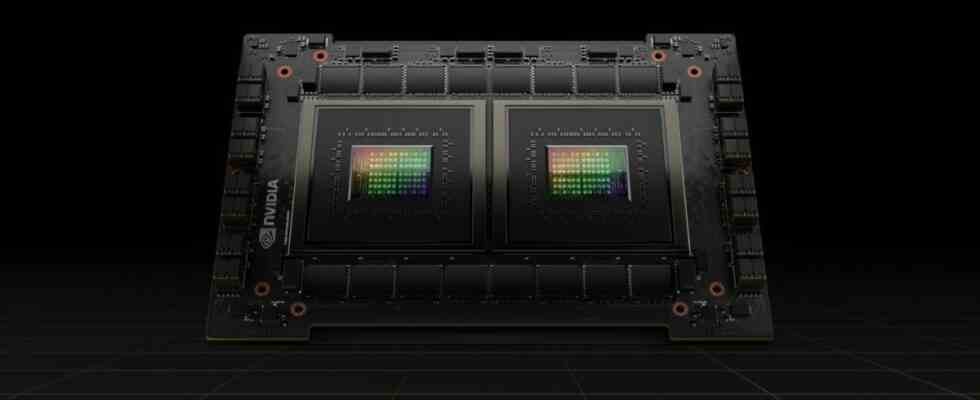

Presentado en GTC 2022 a principios de este año, el Superchip de CPU Grace se compone de dos CPU Grace conectadas a través de una interconexión NVLink de alta velocidad, de manera similar al M1 Ultra de Apple.

El resultado es un monstruo de 144 núcleos con 1 TB/s de ancho de banda de memoria y 396 MB de caché en el chip que, según Nvidia, será el procesador más rápido del mercado para cargas de trabajo que van desde IA hasta HPC y más.

“Ha surgido un nuevo tipo de centro de datos: fábricas de IA que procesan y refinan montañas de datos para producir inteligencia”, dijo el CEO de Nvidia, Jensen Huang, cuando se anunció por primera vez el nuevo chip.

“El Grace CPU Superchip ofrece el más alto rendimiento, ancho de banda de memoria y plataformas de software Nvidia en un solo chip y brillará como la CPU de la infraestructura de IA del mundo”.

Aunque no está claro cuándo estará ampliamente disponible el nuevo superchip, Nvidia reveló recientemente que se incluirá en una gama de nuevos servidores prediseñados que se lanzarán en la primera mitad de 2023. Los nuevos sistemas, de la talla de Asus, Gigabyte, Supermicro y otros, se basará en cuatro nuevos diseños de referencia 2U presentados por Nvidia en Computex 2022.

Cada uno de los cuatro diseños está diseñado para atender casos de uso específicos, desde juegos en la nube hasta gemelos digitales, HPC e IA. Nvidia dice que los socios pueden modificar fácilmente los diseños para «hacer girar rápidamente las placas base aprovechando las arquitecturas de sus sistemas existentes».

La entrada de Nvidia en el mercado de servidores acelerará aún más el avance de los chips basados en Arm, que se espera que consuman la parte de x86, la arquitectura en la que se basan los chips Intel Xeon y AMD EPYC.

La adopción de chips basados en Arm en el centro de datos también ha sido impulsada por el desarrollo de silicio personalizado basado en Arm entre nube proveedores y otros gigantes web. los serie de gravitones desarrollado por AWS ha demostrado ser un gran éxito, la firma china AliBaba está trabajando en un nueva CPU de 128 núcleosy tanto Microsoft como Meta son rumoreado desarrollar chips internos también.

“Muchas nuevas empresas han intentado hacer Arm en el centro de datos a lo largo de los años. Al principio, la propuesta de valor se basaba en la baja potencia, pero los operadores de centros de datos realmente se preocupan por el rendimiento. Se trata de empaquetar la mayor cantidad de computación posible en un rack”, Chris Bergey, vicepresidente sénior de infraestructura en Arm, le dijo a TechRadar Pro a principios de este año.

“Con Arm, los proveedores de la nube están descubriendo que pueden obtener más cómputo, porque pueden poner más núcleos en un paquete de energía. Y estamos solo en la punta del iceberg”.

A través de Hardware de Tom (se abre en una pestaña nueva)