Nvidia lanzó el martes una versión renovada de su plataforma Grace Hopper Superchip de próxima generación con memoria HBM3e para inteligencia artificial y computación de alto rendimiento. La nueva versión del GH200 Grace Hopper cuenta con la misma CPU Grace y GPU de cómputo GH100 Hopper, pero viene con memoria HBM3e con mayor capacidad y ancho de banda.

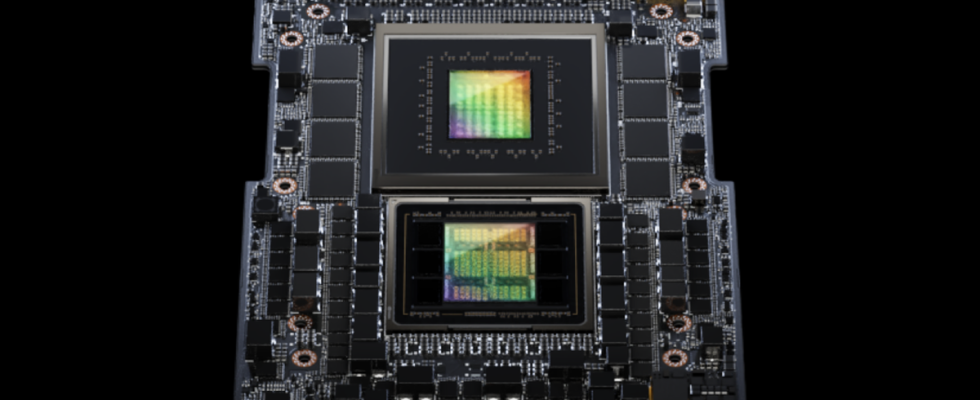

El nuevo GH200 Grace Hopper Superchip se basa en la CPU Grace de 72 núcleos equipada con 480 GB de memoria ECC LPDDR5X, así como en la GPU de cómputo GH100 que se combina con 141 GB de memoria HBM3E que viene en seis pilas de 24 GB y usa 6144 interfaz de memoria de bits. Si bien Nvidia instala físicamente 144 GB de memoria, solo se puede acceder a 141 GB para obtener mejores rendimientos.

El Superchip Grace Hopper GH200 actual de Nvidia viene con 96 GB de memoria HBM3, lo que proporciona un ancho de banda de menos de 4 TB/s. Por el contrario, el nuevo modelo aumenta la capacidad de memoria en alrededor de un 50 % y aumenta el ancho de banda en más de un 25 %. Tales mejoras masivas permiten que la nueva plataforma ejecute modelos de IA más grandes que la versión original y proporcione mejoras de rendimiento tangibles (que serán particularmente importantes para el entrenamiento).

Según Nvidia, la plataforma GH200 Grace Hopper de Nvidia con HBM3 está actualmente en producción y estará disponible comercialmente a partir del próximo mes. Por el contrario, la plataforma GH200 Grace Hopper con HBM3e ahora está probando y se espera que esté disponible en el segundo trimestre de 2024. Nvidia enfatizó que el nuevo GH200 Grace Hopper usa la misma CPU Grace y el mismo silicio GPU GH100 que la versión original, por lo que el la empresa no necesitará aumentar ninguna revisión o avance.

Nvidia dice que el GH200 original con HBM3 y el GH200 mejorado con HBM3E coexistirán en el mercado, lo que significa que este último se venderá a un precio superior dado su mayor rendimiento habilitado por la memoria más avanzada.

«Para satisfacer la creciente demanda de IA generativa, los centros de datos requieren plataformas informáticas aceleradas con necesidades especializadas», dijo Jensen Huang, director ejecutivo de Nvidia. «La nueva plataforma GH200 Grace Hopper Superchip ofrece esto con tecnología de memoria y ancho de banda excepcionales para mejorar el rendimiento, la capacidad de conectar GPU para agregar rendimiento sin compromiso y un diseño de servidor que se puede implementar fácilmente en todo el centro de datos».

La plataforma Grace Hopper Superchip de próxima generación de Nvidia con HBM3e es totalmente compatible con la especificación del servidor MGX de Nvidia y, por lo tanto, es compatible con los diseños de servidor existentes.