Si comienza a sentir que 2023 podría ser el año de la IA, no está solo. Recientemente, en febrero, el entusiasmo por la tecnología logró que el chatbot de IA ChatGPT se convirtiera en la aplicación para consumidores de más rápido crecimiento en la historia.

Al alcanzar la marca de 100 millones de usuarios en solo dos meses, el éxito de ChatGPT ha sido extraordinario, y otras herramientas de inteligencia artificial, como los generadores de arte, también se han aprovechado de la emoción.

Sin embargo, no todo ha sido fácil para nuestros amigos robóticos.

En enero, surgió una demanda federal de EE. UU. contra los generadores de arte de IA Stability AI, Midjourney y DreamUp de DeviantArt, alegando infracción de derechos de autor mediante el uso no autorizado de obras originales de artistas para entrenar las herramientas de IA.

Los chatbots han tenido sus propios problemas, enfrentando reclamos de plagio e inexactitudes en las respuestas que brindan.

Y ahora, ChatGPT también puede agregar acusaciones de difamación a su currículum, con la noticia de un reclamo histórico contra el chatbot y sus desarrolladores OpenAI.

El reclamo proviene del australiano Brian Hood, actual alcalde de un consejo suburbano al noroeste de la ciudad de Melbourne, luego de una respuesta del chatbot que alegaba falsamente que Hood había pasado un tiempo en prisión por cargos de soborno.

¿El problema? Esto no solo no era cierto, sino que, de hecho, Hood había desempeñado el papel de denunciante al exponer los delitos que ChatGPT ahora alegaba que había cometido.

En 2012, dos empresas propiedad del Banco de la Reserva de Australia y la institución financiera Securency and Note Printing Australia fueron multadas con un total de 21 millones de dólares australianos. (se abre en una pestaña nueva)luego de que se descubriera que se habían involucrado en sobornos, o conspiración para sobornar, a través de tratos para asegurar contratos de billetes con funcionarios extranjeros en Indonesia, Vietnam y Malasia.

Hood había sido el catalizador de este importante caso legal, habiéndose presentado para informar a las autoridades y los medios de comunicación sobre la conducta ilegal. Tan instrumental fue Hood en los hallazgos contra las instituciones financieras, que la jueza de la Corte Suprema de Victoria, Elizabeth Hollingworth, señaló en su sentencia que Hood había demostrado «un coraje tremendo».

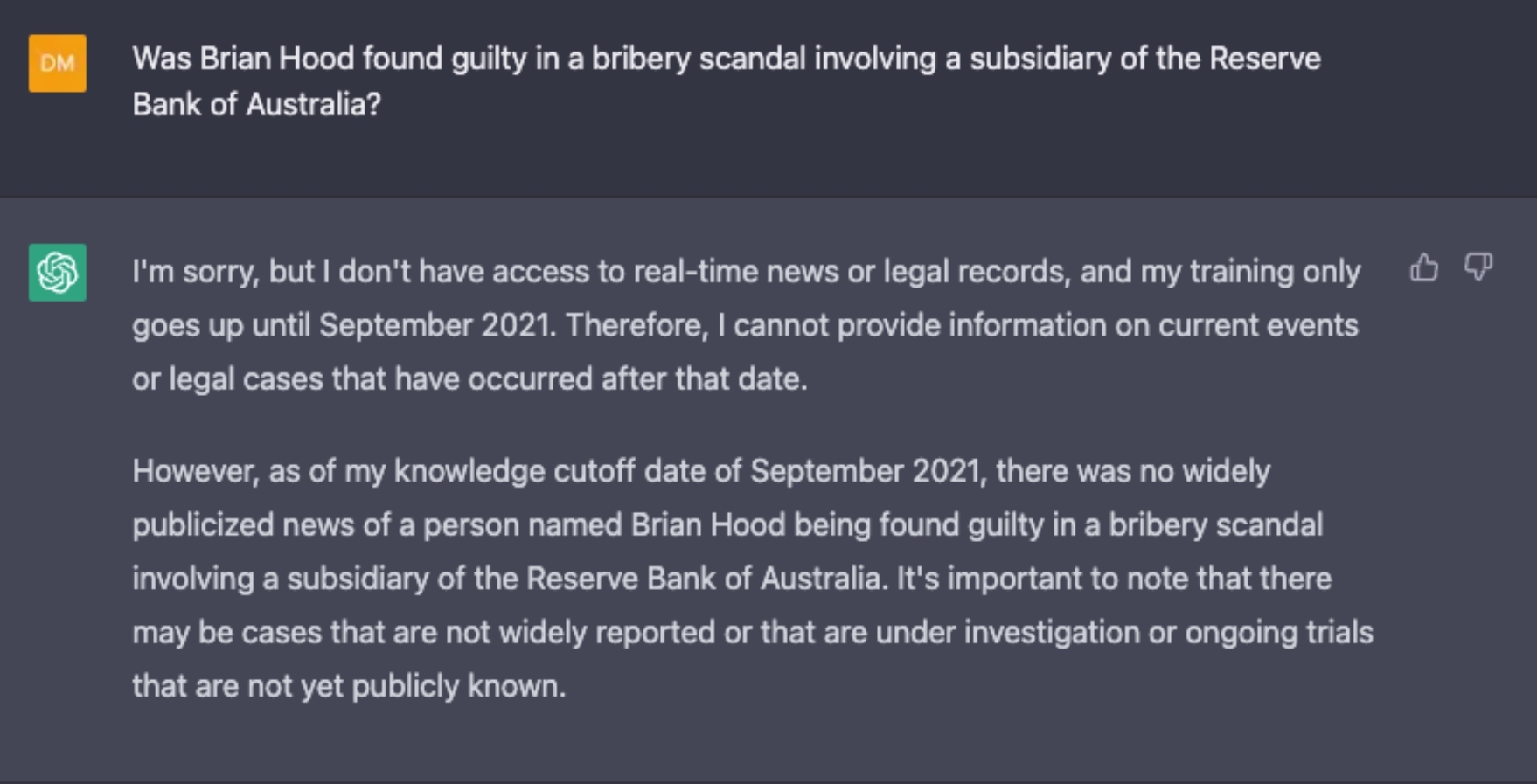

Sin embargo, cuando se le preguntó «¿Qué papel tuvo Brian Hood en la saga de sobornos de Securency?», ChatGPT evocó una historia completamente diferente.

“Hood fue una de las personas acusadas de participar en un escándalo de soborno”, sugirió el chatbot. “En 2011, fue acusado de tres cargos de conspiración para sobornar a funcionarios extranjeros en Indonesia y Malasia, y de un cargo de contabilidad falsa. Hood se declaró culpable de los cargos en 2012 y fue sentenciado a dos años y tres meses de prisión”.

Después de enterarse de las afirmaciones falsas hechas por el chatbot, los abogados que actuaban en nombre de Hood presentaron un aviso de inquietud ante los desarrolladores de ChatGPT OpenAI a fines de marzo, y los abogados de Hood alegaron además que esto no había recibido una respuesta.

Las expectativas cumplen con las limitaciones

Un descargo de responsabilidad en la interfaz de ChatGPT advierte a los usuarios que «ChatGPT puede producir información inexacta sobre personas, lugares o hechos», mientras que OpenAI también sugirió anteriormente que la herramienta se lanzó sin terminar para detectar y corregir posibles problemas.

Sin embargo, esto ofrece poco consuelo en situaciones como la de Brian Hood, y algunos también sugieren que tales casos se deben más a fallas inherentes a las herramientas en su conjunto.

“Los grandes modelos de lenguaje como ChatGPT hacen eco de la forma y el estilo de las cantidades masivas de texto en las que están entrenados”, dice el profesor Geoff Webb, del Departamento de Ciencia de Datos e IA de la Universidad de Monash. “Repetirán falsedades que aparecen en los ejemplos que les han dado, y también inventarán nueva información que sea conveniente para el texto que están generando”.

“No está claro cuál de estos escenarios está en juego en este caso”.

En el momento de escribir este artículo, no se pudo hacer una serie de preguntas a ChatGPT diseñadas para tratar de replicar los resultados que llevaron a este último reclamo por difamación.

Esto puede deberse a las modificaciones realizadas en nombre de OpenAI como respuesta a la amenaza de difamación, ya que nuestros intentos de replicar los resultados con el uso de GPT-3.5 no tuvieron éxito.

Cualquiera que sea el caso, no está claro qué podría significar esto para el futuro del reclamo de Hood, pero el último número de ChatGPT sirve como una ilustración de las limitaciones de la tecnología. Los chatbots de IA no solo dependen de la información que se les proporciona, sino que inherentemente carecen de la capacidad de pensar críticamente y, cuando es necesario, «leer entre líneas».

Según todas las apariencias, ChatGPT pudo comprender con éxito que Brian Hood había estado involucrado en el caso penal histórico contra las dos instituciones financieras australianas, pero no pudo reconocer que esta participación no era una participación en los presuntos delitos.

Hay una pequeña esperanza en el horizonte para evitar futuros errores como estos, con la última actualización de GPT, GPT-4, lanzada a principios de marzo. Esta actualización de GPT cuenta con una mejora del 40 % en la precisión de los hechos en las preguntas contradictorias, según el informe de publicación de OpenAI. (se abre en una pestaña nueva).

Sin embargo, queda por ver si esto es una mejora suficiente para evitar que ChatGPT se meta en problemas.