TAIPEI: el discurso de apertura de Computex de Nvidia, que abrió el día «previo al juego» del lunes para la feria comercial de TI más grande de Asia (su primera edición importante en persona desde 2019), fue un tour de force de las innovaciones del centro de datos y la IA. Y, si cree en la palabra del CEO de Nvidia, Jensen Huang, estos movimientos afectarán a todos los negocios y todas las industrias en los próximos años. (Wall Street parecería estar de acuerdo). Eso se debe a que la IA generativa está lista para infiltrarse en empresas y disciplinas que hasta este momento no han sido tocadas por iniciativas de IA. La nueva tecnología está lista para transformar el desarrollo de software tal como lo conocemos también.

El hardware de Nvidia y otras iniciativas son los pilares fundamentales de los cambios que se están produciendo en el espacio de la IA en la actualidad. La computación acelerada es un tema al que Huang volvió una y otra vez en el discurso de apertura. Nvidia define la computación acelerada como «el uso de hardware especializado para acelerar drásticamente el trabajo, a menudo con procesamiento paralelo que agrupa tareas que ocurren con frecuencia». Se utiliza en campos exigentes como el aprendizaje automático, el análisis de datos y las simulaciones, y las GPU son un acelerador común y robusto que coloca a Nvidia justo en el corazón del mercado.

(Crédito: John Burek)

Huang señaló que esta presentación fue su primera presentación en vivo en persona desde el inicio de la pandemia de COVID-19 («¡Deséenme suerte!»). infinidad reprimido hasta el presente: el discurso de apertura duró 2 horas completas y requeriría más desembalaje que el tráiler de un equipo de fútbol completo lleno de equipo. Lo reducimos a ocho puntos destacados.

1. ‘La informática acelerada es informática sostenible’

Huang brindó cierta perspectiva sobre el aumento y la potencia de la computación GPU en relación con los modelos de IA y las capacidades que ahora están en el mercado. Dada la insaciable demanda de poder de cómputo para entrenar modelos de IA, usó $10 millones como punto de referencia. Mientras que no hace mucho tiempo, ese dinero le permitiría comprar 960 servidores basados en CPU, quemando 11 gigavatios hora de energía para entrenar un modelo de lenguaje grande (LLM) de IA, el mismo dinero le permitiría comprar 48 servidores basados en GPU que utilizan alrededor de un tercio de la energía… y con la capacidad de entrenar a un enorme 44 LLM.

(Crédito: Computex)

A la inversa, para «simplemente hacer el trabajo», como él lo expresó, dos servidores GPU con la capacidad de entrenar un LLM ahora le costarían alrededor de $ 400,000 en lugar de los $ 10 millones originales. Esa es la escala de cambio que hemos visto, dice, en términos de poder de cómputo para procesar IA en el back-end.

2. ‘Cualquier cosa que tenga estructura, podemos aprender ese lenguaje’

Hablando en términos generales sobre la IA y el giro repentino que puede parecer, para los observadores externos, haber venido del cielo como un relámpago en términos de su impacto, Huang postula que la industria ha alcanzado un punto de inflexión que se alcanzó en la confluencia. de aprendizaje profundo y computación distribuida.

«Cualquier cosa que tenga estructura, podemos aprender ese lenguaje», señala Huang. «Ahora podemos aplicar la informática a tantos campos que antes eran imposibles». tipos de información.

Los grandes avances que han lanzado la IA a la conciencia del público pueden ser bots de chat fáciles de asimilar como ChatGPT, pero las aplicaciones de IA de «tipo de contenido cruzado» sugieren un impacto aún más radical: transformar texto en video, video en texto, o texto a la música. El CEO de Nvidia dio algunos ejemplos viscerales. En uno, colocó un bloque de texto que una IA transformó instantáneamente en una mujer aparentemente del mundo real que decía sus palabras en video. En otra demostración, generó un flujo de música tradicional atmosférica con temática taiwanesa simplemente a partir de una breve descripción del tipo de música que quería escuchar. Más allá de eso, usó un mensaje para crear la letra de una canción tipo jingle, que la IA luego puso música, y entonces habilitó una versión generada de manera diferente para que la audiencia la use en un canto.

(Crédito: Computex)

Lo cual es todo para decir: algunas de las barreras clave que se han derribado en esta última ola de IA son los límites entre los tipos de información y la capacidad de usar uno para manipular el otro. Las implicaciones son profundas cuando piensas en algunos de los otros cruces posibles: texto, código, incluso ADN.

3. Personajes realistas en el juego ACE-ing

Huang detalló el Nvidia Avatar Cloud Engine, o Nvidia ACE, para desarrolladores de juegos. Esta tecnología está diseñada para que los desarrolladores la utilicen para generar y personalizar personajes de IA en el juego. Los modelos de personajes están preentrenados y estarán listos para generar diálogos basados en historias de fondo que la IA puede utilizar para generar una sensación de consistencia y realismo. (Las pautas dentro del marco ACE mantendrán las conversaciones en el punto y relevantes para el juego). La idea aquí es que, en última instancia, en los límites de un juego de PC determinado, los personajes que no son jugadores pueden ser manejados por interacciones generadas por IA como estas , en lugar de progresiones con guión.

El dueño de esta tienda, en el ejemplo de Nvidia, brinda una conversación de fondo generada por IA relevante para la trama del juego:

Claro, puede sonar un poco forzado, pero es pronto, muy pronto. Además, ACE incorpora tecnologías que incluyen Omniverse Audio2Face de la compañía para animar las expresiones de los NPC.

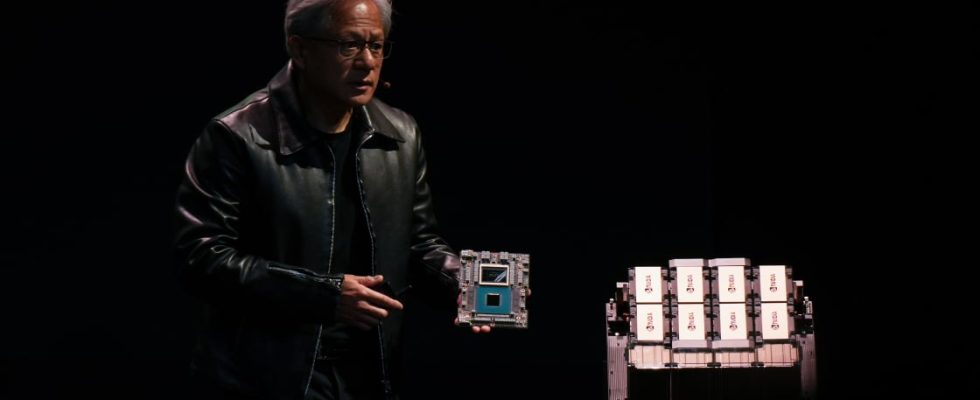

4. ‘Grace Hopper’ ha entrado en el chat

El «superchip» GH200 de Nvidia, también conocido como «Grace Hopper», está en producción, anunció Huang. (Grace Hopper reúne la CPU Nvidia «Grace» basada en Arm y la GPU basada en núcleo tensor «Hopper» H100 de Nvidia a través de interconexiones de alta velocidad en un solo paquete). CPU, 96 GB de memoria HBM3 y 576 GB de memoria gráfica.

(Crédito: Computex)

Huang promocionó más de 200 mil millones de transistores en el GH200 y también mencionó que los centros de datos japoneses de Softbank incorporarían Grace Hopper en sus operaciones.

5. Una supercomputadora con ‘gracia’

Siguiendo los desarrollos de Grace Hopper, Huang detalló la Nvidia DGX GH200. Es una solución de supercomputadora de escala masiva basada en el GH200 para capacitación generativa de IA y LLM, que se espera para fin de año. En última instancia, 256 GH200 Grace Hoppers están conectados en un DGX GH200. Los grupos de ocho están vinculados entre sí a través de NVLink. Luego, a su vez, 32 de estos grupos, conectados a través de una capa de conmutadores, crean en esencia una gran GPU a escala de supercomputadora, como se refirió a ella Huang. Un DGX GH200 tendrá 150 millas de cable de fibra óptica, tendrá más de 2000 ventiladores y, según Huang, pesará «cuatro elefantes» (40 000 libras).

Recomendado por Nuestros Editores

(Crédito: Computex)

Esta supercomputadora promete ser un monstruo para las aplicaciones de IA generativa, con 144 TB de memoria de GPU compartida e incluso capaz de ejecutar una pila de comunicaciones 5G virtual completamente en software. Debería ser capaz de alcanzar un rendimiento a escala de exaflop y se utilizará en los modelos de lenguaje más complejos, así como en entornos como motores de «recomendación» algorítmica de alta demanda y redes neuronales. Nvidia está trabajando con Google, Meta y Microsoft para permitirles a estos gigantes acceder a DGX GH200 para avanzar en la vanguardia de la investigación de IA.

6. Spectrum-X: Conexiones de IA

Con todos estos avances en computación acelerada, ¿podrían no quedarse atrás los avances en interconectividad paralela? La plataforma Spectrum-X, una evolución de Ethernet, está diseñada para las demandas extremas de ancho de banda de la computación acelerada y la IA. Es una tecnología sin pérdida de paquetes (lossless) que la compañía ha denominado «la primera Ethernet de alto rendimiento del mundo para IA».

(Crédito: Computex)

Huang mostró los primeros frutos de la iniciativa Spectrum-X en la forma del conmutador Spectrum-4, con 51 Tbits por segundo de ancho de banda. El Spectrum-4 emplea un troquel masivo que mide 90 mm cuadrados y consume 500 vatios; Huang levantó uno para mostrar la gran escala. «Por primera vez, estamos trayendo las capacidades de la informática de alto rendimiento al mercado de Ethernet», señaló. Funciona con los chips Bluefield de Nvidia para la priorización del tráfico de red.

7. Una iniciativa de estandarización de servidores

En lo profundo de la segunda hora, está la especificación del servidor MGX. Nvidia anunció este conjunto de pautas, que son una arquitectura de referencia para construir servidores adecuados para el entrenamiento de IA y otras necesidades de alto rendimiento. Una gran cantidad de jugadores importantes en el espacio de los servidores (entre ellos ASRock, Asus, Gigabyte, Pegatron, QCT y Supermicro) están listos para unirse a MGX. Los servidores basados en MGX describirán las arquitecturas informáticas básicas y luego ofrecerán variantes predefinidas para cargas de trabajo específicas en el entrenamiento de modelos, el trabajo de diseño y las aplicaciones informáticas de borde. Los diseños de servidores basados en MGX deberían comenzar a aparecer a finales de este verano de servidores incondicionales como QCT y Supermicro.

8. Oh, ¿alguien quiere comprar una GPU?

¿Puede algo ser una «idea de último momento» si es una de las primeras cosas que mencionaste en tu discurso de apertura gigante? Ubicada debajo de las GeForce insignia en computadoras de escritorio, GeForce RTX 4090 y RTX 4080, está la GeForce RTX 4060 Ti que debutó hace unas semanas. Huang levantó una muestra brevemente (la típica tarjeta Nvidia RTX Founders Edition de última generación) y mencionó que ahora está en producción de socios en Taiwán en un volumen muy grande.

(Crédito: Computex)

También levantó una computadora portátil RTX de muestra, un modelo liviano de 14 pulgadas del tipo que ahora está en el mercado, basado en una GPU «Ada Lovelace», que ejecuta juegos con trazado de rayos a 60 fps, y la promociona como más poderosa que las PlayStation de gama alta.

¡Obtenga nuestras mejores historias!

Matricularse en ¿Qué hay de nuevo ahora? para recibir nuestras mejores historias en su bandeja de entrada todas las mañanas.

Este boletín puede contener publicidad, ofertas o enlaces de afiliados. Suscribirse a un boletín informativo indica su consentimiento a nuestros Términos de uso y Política de privacidad. Puede darse de baja de los boletines en cualquier momento.