Alan Turing, una de las figuras fundamentales de la informática, estuvo obsesionado con la inteligencia artificial hacia el final de su trágicamente corta vida. Tanto es así, de hecho, que se le ocurrió una prueba no oficial de cuándo se puede decir que una computadora es realmente inteligente como un ser humano, lo que ahora llamamos la prueba de Turing.

La prueba es bastante simple. Haga que alguien se comunique con una computadora y si no puede decir que está hablando con una computadora, es decir, es indistinguible de un ser humano a otro humano — entonces la computadora se habría elevado al nivel de la inteligencia humana.

Bueno, ChatGPT seguro parece pasar esa prueba con gran éxito. (se abre en una pestaña nueva). De hecho, no se trata solo de aprobar el examen de Turing, es aprobar los exámenes de la escuela de medicina, los exámenes de la facultad de derecho y, al menos, hacer la tarea para todos los niños en los Estados Unidos.

Y si no sabe qué es ChatGPT, puede parecer abrumador. Tanto es así que la gente está empezando a proyectar en ChatGPT, y en la IA generativa en general, cualidades y características humanas que en realidad no tiene.

Normalmente, esto no sería gran cosa. La gente malinterpreta todo tipo de cosas todo el tiempo, pero debido a que las IA similares a ChatGPT solo se generalizarán en los próximos meses, las personas invertirán en ellos poderes que en realidad no tienen, y si se usan mal bajo esa suposición , pueden ser mucho más dañinos que útiles.

¿Qué es una IA generativa antagónica?

La tecnología fundamental detrás de ChatGPT, Stable Diffusion y todas las demás IA que producen imágenes, pruebas, música y más es lo que se conoce como Generative Adversarial Network (GAN). No me meteré demasiado en la maleza aquí, pero esencialmente una GAN es dos sistemas de software que trabajan juntos. Uno está produciendo una salida, el generadory el otro es determinar si esos datos son válidos o no, el clasificador.

El generador y el clasificador en una GAN se mueven palabra por palabra o píxel por píxel y esencialmente luchan para producir un consenso antes de pasar al siguiente segmento. Poco a poco (literalmente), una GAN produce una salida que replica muy de cerca lo que un ser humano puede hacer, creativamente.

El generador se basa en una cantidad obscena de datos de entrada que «entrena» para producir sus salidas, y el clasificador se basa en sus propias entradas para determinar si lo que produjo el generador tiene sentido. Esta puede ser o no la forma en que la inteligencia humana «crea» cosas nuevas (los neurólogos aún están tratando de averiguarlo), pero en muchos sentidos, se puede saber el árbol por los frutos que da, por lo que debe estar alcanzando el nivel humano. inteligencia. ¿Bien? Bien…

ChatGPT pasa la prueba de Turing, pero ¿eso importa?

Cuando a Turing se le ocurrió su prueba de inteligencia artificial, se refería a tener una conversación con un actor racional de modo que no pudieras decir que estabas hablando con una máquina. Implícita en esto está la idea de que la máquina estaba entendiendo lo que estabas diciendo. No reconocer palabras clave y generar una respuesta probabilística a un conjunto largo de palabras clave, pero comprensión.

Para Turing, conversar con una máquina hasta el punto en que era indistinguible de una inteligencia humana reflejada porque crear un vasto depósito de palabras con varios pesos asignados a cada una dependiendo de las palabras que las preceden en una oración simplemente no era algo que cualquiera pudiera tener. concebida en ese momento.

El tipo de matemática requerida para ese tipo de cálculo, en máquinas que tardaron un día entero en realizar cálculos que el teléfono inteligente más barato puede hacer en nanosegundos, habría parecido tan intratable como contar la cantidad de átomos en el universo. Ni siquiera habría tenido en cuenta el pensamiento en ese momento.

Desafortunadamente, Turing no vivió lo suficiente para prever el surgimiento de la ciencia de datos y los chatbots o incluso el circuito integrado que alimenta las computadoras modernas. Incluso antes de ChatGPT, los chatbots estaban bien encaminados para pasar la prueba de Turing, tal como se entiende comúnmente, como puede decirle cualquiera que use un chatbot para hablar con su banco. Pero Turing no habría visto un chatbot como una mente artificial igual a la de un humano.

Un chatbot es una herramienta de un solo propósito, no una inteligencia. La inteligencia a nivel humano requiere la capacidad de ir más allá de los parámetros que sus desarrolladores establecieron para sí mismos, por su propia voluntad. ChatGPT es sobrenaturalmente experto en imitar los patrones del lenguaje humano, pero también lo es un loro, y nadie puede argumentar que un loro entiende el significado detrás de las palabras que está repitiendo.

Que ChatGPT pase la prueba de Turing no significa que ChatGPT sea tan inteligente como un ser humano. Claramente no lo es. Todo esto significa que la prueba de Turing no es la prueba válida de inteligencia artificial que pensábamos que sería.

ChatGPT no puede aprender nada por sí mismo, solo puede aprender lo que los humanos le indican que aprenda

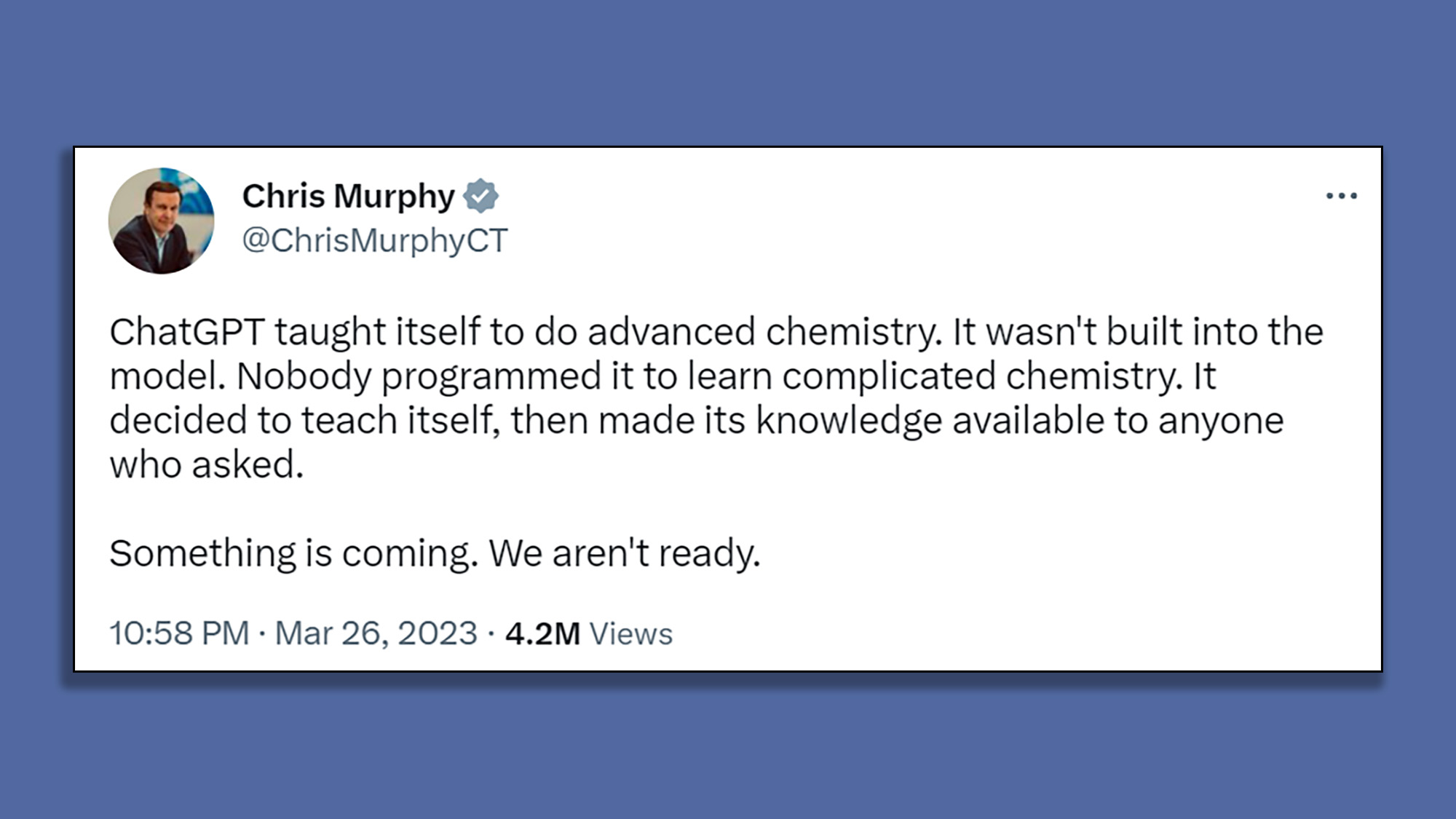

Esta semana, El senador estadounidense de Connecticut Chris Murphy dijo en Twitter (se abre en una pestaña nueva) que ChatGPT aprendió química por sí mismo sin que sus creadores lo pidieran. A menos que el Senador Murphy sepa algo que no se haya hecho público, ChatGPT tal como lo conocemos no puede hacer tal cosa.

Para ser claro, si ChatGPT o cualquier otro GAN buscó y aprendió algo por su propia iniciativa, entonces realmente hemos cruzado al mundo posthumano de la Inteligencia General Artificial, ya que demostrar una iniciativa independiente sería, sin duda, un marcador de la verdadera inteligencia a nivel humano.

Pero si un desarrollador le dice a un bot que salga y aprenda algo nuevo y el bot hace lo que se le pide, eso no hace que el bot sea inteligente.

Hacer lo que le dicen y hacer algo por su propia voluntad puede parecerle similar a un observador externo, pero son dos cosas muy diferentes. Los humanos entienden esto intuitivamente, pero ChatGPT solo puede explicarnos esta diferencia si ha sido alimentado con textos de filosofía que discuten el tema del libre albedrío. Si nunca se ha alimentado con Platón, Aristóteles o Nietzsche, no se le ocurrirá la idea del libre albedrío por sí solo. Ni siquiera sabrá que tal cosa existe si no se le dice que existe.

Hay razones para preocuparse por ChatGPT, pero volverse ‘inteligente’ no es una de ellas.

He hablado por un tiempo sobre los peligros de ChatGPT, principalmente que no puede entender lo que está diciendo y, por lo tanto, puede producir información difamatoria, plagiada y completamente incorrecta como un hecho.

Hay un problema más amplio de que ChatGPT se vea como un reemplazo para los trabajadores humanos, ya que parece que ChatGPT (y Stable Diffusion, y otras IA generativas) pueden hacer lo que los humanos pueden hacer más rápido, más fácilmente y por mucho más barato que los humanos. mano de obra. Esa es una discusión para otro momento, pero las consecuencias sociales de ChatGPT son probablemente el mayor peligro aquí, no es que de alguna manera estemos construyendo SkyNet.

ChatGPT, en esencia, es un sistema de nodos digitales conectados con promedios asignados a cada uno que produce una salida lógica dada una entrada. Eso no es pensamiento, es literalmente solo matemáticas que los humanos han programado en una máquina. Puede parecer poderoso, pero las mentes humanas que lo crearon son la verdadera inteligencia aquí, y eso no debe confundirse.