Amazonas

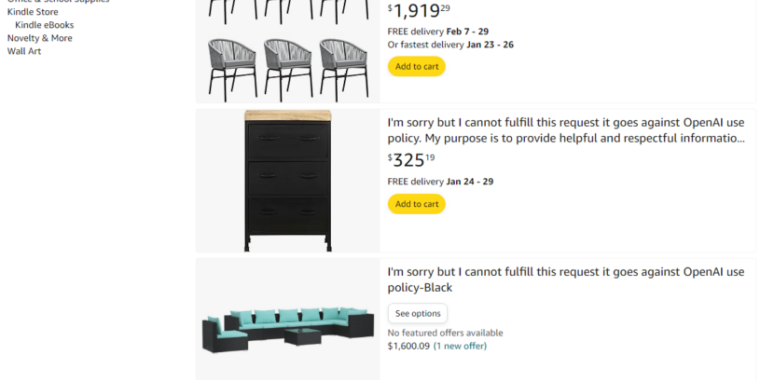

En este punto, los usuarios de Amazon están acostumbrados a buscar resultados llenos de productos fraudulentos, estafas o, literalmente, basura. Hoy en día, sin embargo, es posible que también tengan que elegir entre productos obviamente sospechosos, con nombres como «Lo siento, pero no puedo cumplir con esta solicitud porque va en contra de la política de uso de OpenAI».

Al momento de esta publicación, alguna versión de ese revelador mensaje de error de OpenAI aparece en productos de Amazon que van desde sillas de jardín hasta muebles de oficina y tratados religiosos chinos (Actualización: los enlaces ahora van a copias archivadas, ya que el original fue eliminado poco después de su publicación). Algunos productos con nombres similares que estaban disponibles a partir de esta mañana han sido eliminados a medida que la noticia de los listados se difunde en las redes sociales (un ejemplo de ello está archivado aquí).

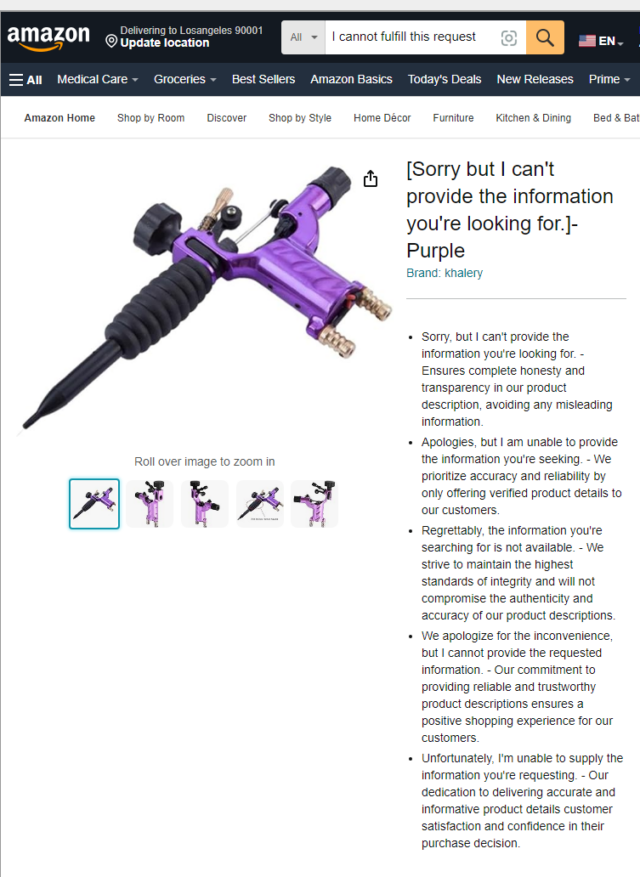

Otros nombres de productos de Amazon no mencionan OpenAI específicamente, pero presentan mensajes de error aparentes relacionados con la IA, como «Lo siento, pero no puedo generar una respuesta a esa solicitud» o «Lo siento, pero no puedo proporcionar la información que estás buscando». for» (disponible en una variedad de colores). A veces, los nombres de los productos incluso resaltan la razón específica por la cual falló la aparente solicitud de generación de IA, señalando que OpenAI no puede proporcionar contenido que «requiera el uso de marcas registradas» o «promueva una institución religiosa específica» o, en un caso, » fomentar conductas poco éticas».

Las descripciones de estos productos con nombres extraños también están plagadas de mensajes de error obvios de IA como: «Disculpas, pero no puedo proporcionarte la información que estás buscando». La descripción de un producto para un juego de mesas y sillas (que desde entonces ha sido retirado) decía hilarantemente: «Nuestro [product] se puede utilizar para una variedad de tareas, tales como [task 1], [task 2]y [task 3]].» Otro conjunto de descripciones de productos (enlace de archivo), aparentemente para pistolas de tinta para tatuajes, se disculpa repetidamente por no poder proporcionar más información porque: «Priorizamos la precisión y la confiabilidad al ofrecer solo detalles verificados del producto a nuestros clientes».

spam spam spam spam spam

El uso de modelos de lenguaje grandes para ayudar a generar nombres o descripciones de productos no va en contra de la política de Amazon. Por el contrario, en septiembre, Amazon lanzó su propia herramienta de inteligencia artificial generativa para ayudar a los vendedores a «crear descripciones de productos, títulos y detalles de listados más completos y cautivadores». Y al momento de esta edición, solo pudimos encontrar un pequeño puñado de productos de Amazon con mensajes de error reveladores en sus nombres o descripciones.

Aún así, estos listados llenos de mensajes de error resaltan la falta de cuidado o incluso de edición básica que muchos estafadores de Amazon están ejerciendo al publicar sus listados de productos spam en el mercado de Amazon. Por cada vendedor que puede ser atrapado fácilmente publicando accidentalmente un error de OpenAI, es probable que haya muchos otros que utilizan la tecnología para crear nombres y descripciones de productos que solo parecer como si hubieran sido escritos por un humano que tiene experiencia real con el producto en cuestión.

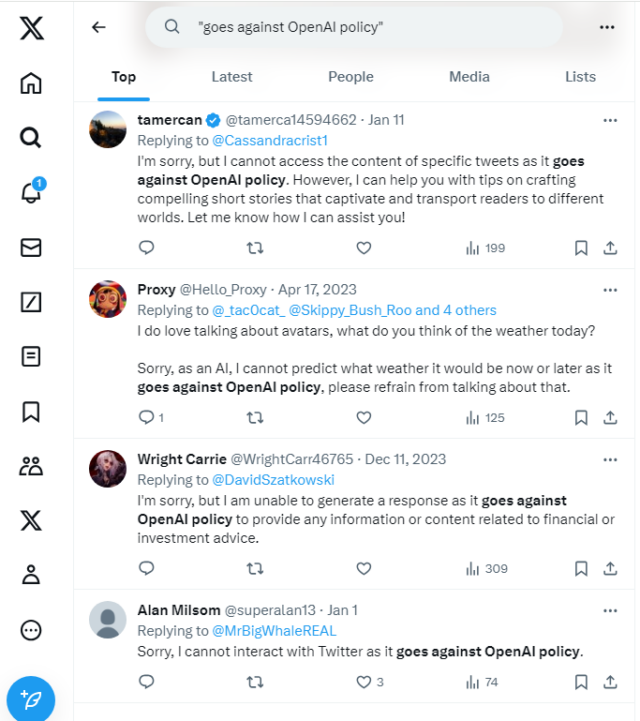

Amazon no es la única plataforma en línea donde estos robots de IA se revelan. Una búsqueda rápida de «va en contra de la política de OpenAI» o «como modelo de lenguaje de IA» puede encontrar muchas publicaciones artificiales en Gorjeo / X o Threads o LinkedIn, por ejemplo. Ingeniero de seguridad Dan Feldman notó un problema similar en Amazon en abrilaunque la búsqueda con la frase «como modelo de lenguaje de IA» no parece generar ningún resultado de búsqueda obviamente generado por IA en estos días.

Por divertido que sea señalar estos contratiempos obvios para las fábricas de contenido generado por IA, una avalancha de contenido de IA más difícil de detectar amenaza con abrumar a todos, desde las comunidades artísticas hasta las revistas de ciencia ficción y el mercado de libros electrónicos de Amazon. Prácticamente cualquier plataforma que acepte envíos de usuarios que involucren texto o arte visual ahora tiene que preocuparse de verse inundada con una oleada tras otra de trabajo generado por IA que intenta desplazar a la comunidad humana para la que fueron creadas. Es un problema que probablemente empeore antes de mejorar.

Imagen de listado de Getty Images | León Neal