Gorjeo

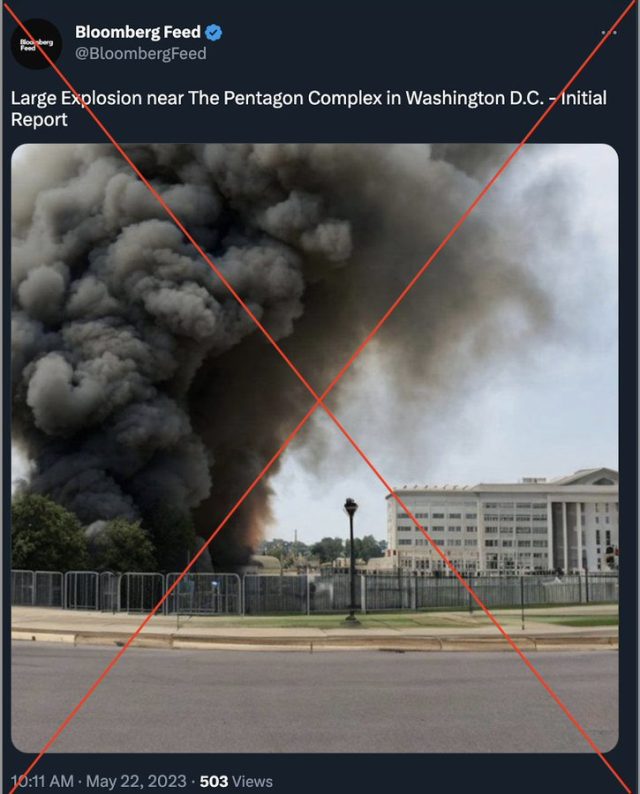

El lunes, un tuiteó La imagen generada por IA que sugiere una gran explosión en el Pentágono provocó una breve confusión, que incluyó una pequeña caída informada en el mercado de valores. Se originó a partir de una cuenta de Twitter verificada llamada «Bloomberg Feed», no afiliada a la conocida empresa de medios Bloomberg, y rápidamente se expuso como un engaño. Sin embargo, antes de que fuera desacreditado, grandes cuentas como Russia Today ya habían difundido la información errónea, informó The Washington Post.

La imagen falsa mostraba una gran columna de humo negro junto a un edificio que recordaba vagamente al Pentágono con el tuit «Gran explosión cerca del complejo del Pentágono en Washington DC – Informe inicial». Tras una inspección más cercana, las autoridades locales confirmaron que la imagen no era una representación precisa del Pentágono. Además, con las barras de cerca borrosas y las columnas de construcción, parece una imagen generada por IA bastante descuidada creada por un modelo como Stable Diffusion.

Antes de que Twitter suspendiera la cuenta falsa de Bloomberg, tenía un total de publicaciones de 224.000 tuits y había alcanzado menos de 1.000 seguidores en general, según el Post, pero no está claro quién la administraba o los motivos detrás de compartir la imagen falsa. Además de Bloomberg Feed, otras cuentas que compartieron el informe falso incluyen «Walter Bloomberg» y «Breaking Market News», ambas no afiliadas a la organización real de Bloomberg.

Este incidente subraya las amenazas potenciales que las imágenes generadas por IA pueden presentar en el ámbito de las redes sociales compartidas apresuradamente y un sistema de verificación pagado en Twitter. En marzo, las imágenes falsas del arresto de Donald Trump creadas con Midjourney llegaron a una amplia audiencia. Si bien estaban claramente marcados como falsos, despertaron temores de confundirlos con fotos reales debido a su realismo. Ese mismo mes, las imágenes generadas por IA del Papa Francisco con una bata blanca engañaron a muchos que las vieron en las redes sociales.

Gorjeo

El Papa con abrigos hinchados es una cosa, pero cuando alguien presenta un tema del gobierno como la sede del Departamento de Defensa de los Estados Unidos en un tuit falso, las consecuencias podrían ser potencialmente más graves. Aparte de la confusión general en Twitter, el tuit engañoso puede haber afectado al mercado de valores. The Washington Post dice que el índice industrial Dow Jones cayó 85 puntos en cuatro minutos después de que se difundió el tuit, pero se recuperó rápidamente.

Gran parte de la confusión sobre el tuit falso puede haber sido posible gracias a los cambios en Twitter bajo su nuevo propietario, Elon Musk. Musk despidió a los equipos de moderación de contenido poco después de su toma de control y automatizó en gran medida el proceso de verificación de la cuenta, cambiándolo a un sistema en el que cualquiera puede pagar para tener una marca de verificación azul. Los críticos argumentan que la práctica hace que la plataforma sea más susceptible a la desinformación.

Si bien las autoridades identificaron fácilmente la foto de la explosión como falsa debido a imprecisiones, la presencia de modelos de síntesis de imágenes como Midjourney y Stable Diffusion significa que ya no se necesita habilidad artística para crear falsificaciones convincentes, lo que reduce las barreras de entrada y abre la puerta a la automatización potencial. máquinas de desinformación. La facilidad para crear falsificaciones, junto con la naturaleza viral de una plataforma como Twitter, significa que la información falsa puede propagarse más rápido de lo que puede verificarse.

Pero en este caso, la imagen no necesitaba ser de alta calidad para causar impacto. Sam Gregory, director ejecutivo de la organización de derechos humanos Witness, señaló a The Washington Post que cuando la gente quiere creer, baja la guardia y no investiga la veracidad de la información antes de compartirla. Describió la imagen falsa del Pentágono como una «falsificación superficial» (a diferencia de una «falsificación profunda» más convincente).

«La forma en que las personas están expuestas a estas falsificaciones superficiales no requiere que algo se vea exactamente como otra cosa para llamar la atención», dijo. “La gente tomará y compartirá fácilmente cosas que no se ven exactamente bien pero se sienten bien”.