Para Computex 2023, Intel anunció nuevos detalles sobre su nuevo silicio VPU centrado en IA que debutará en los nuevos chips Meteor Lake de la compañía. La compañía también describió sus esfuerzos para habilitar el ecosistema de IA para sus próximos chips Meteor Lake. Intel planea lanzar los procesadores Meteor Lake, es el primero en usar un diseño combinado basado en chiplet que aprovecha la tecnología Intel y TSMC en un solo paquete, para fin de año. Los chips aterrizarán primero en las computadoras portátiles, centrándose en la eficiencia energética y el rendimiento en las cargas de trabajo locales de IA, pero también llegarán diferentes versiones del diseño a las PC de escritorio.

Tanto Apple como AMD ya han avanzado con potentes motores de aceleración de IA integrados directamente en su silicio, y Microsoft también ha estado ocupado instalando Windows con nuevas capacidades para aprovechar los motores de aceleración de IA personalizados. Tras los anuncios de Intel, AMD y Microsoft la semana pasada sobre la llegada de la IA a las PC, Intel profundizó en cómo abordará la clase emergente de cargas de trabajo de IA con sus propios bloques de aceleración personalizados en sus chips de PC de consumo.

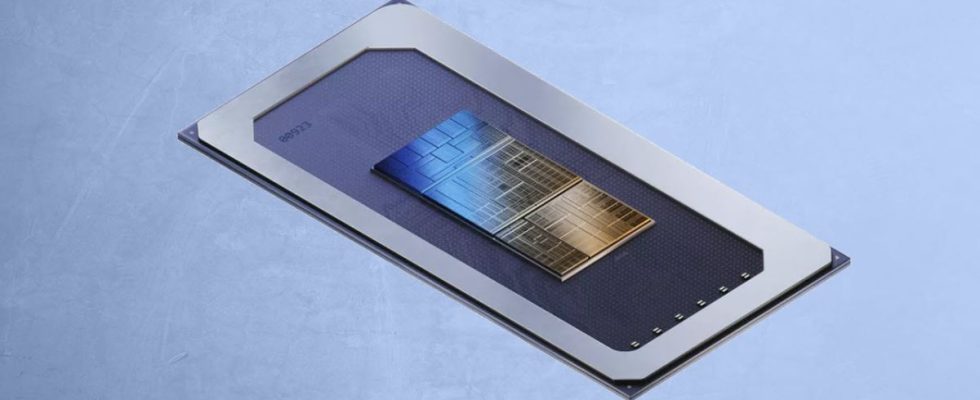

Intel compartió algunos renders nuevos de los chips Meteor Lake, y ya cubrimos el diseño general del hardware durante Hot Chips 2022. Estos chips serán los primeros en aprovechar el nodo de proceso Intel 4 y una gran cantidad de chipsets fabricados por TSMC en el N5 y Procesos N6 para otras funciones, como GPU y mosaicos SoC. Aquí podemos ver que el chip se divide en cuatro unidades, con una CPU, GPU, SoC/VPU y mosaico de E/S apilados verticalmente sobre un intercalador utilizando la técnica de empaquetado 3D Foveros de Intel. También hemos incluido otra plataforma de diapositivas al final del artículo con detalles arquitectónicos más granulares de la conferencia Hot Chips.

El enfoque aquí es la unidad VPU, pero no deje que la primera imagen, que es la ilustración simplificada de Intel que compartió para el anuncio de hoy, lo engañe: el mosaico completo no está dedicado a la VPU. En cambio, es un mosaico SoC con varias otras funciones, como E/S, VPU, núcleos GNA, controladores de memoria y otras funciones. Este mosaico está fabricado en el proceso N6 de TSMC, pero tiene la arquitectura Intel SoC y los núcleos de VPU. La unidad VPU no consume toda esta área de matriz, lo cual es bueno; eso significaría que Intel estaba empleando casi el 30 % de su área de matriz en lo que será una unidad de uso poco frecuente, al menos al principio. Sin embargo, como veremos a continuación, pasará algún tiempo antes de que los desarrolladores habiliten el ecosistema de aplicaciones necesario para hacer un uso completo de los núcleos de VPU.

En el álbum anterior, incluí una imagen de la presentación Hot Chips de Intel que brinda la representación gráfica oficial de la compañía de las funciones en el troquel de E/S. También incluí una diapositiva etiquetada como ‘fig. 8.’ Este diagrama de bloques proviene de una patente de Intel que, según se cree, describe el diseño de Meteor Lake y, en general, coincide con lo que ya hemos aprendido sobre el chip.

Intel seguirá incluyendo el bloque de aceleración de IA de bajo consumo Gaussian Neural Acceleration que ya existe en sus chips, marcado como ‘GNA 3.5’ en el mosaico SoC en el diagrama (más sobre esto a continuación). También puede ver el bloque ‘VPU 2.7’ que comprende el nuevo bloque VPU basado en Movidius.

Al igual que el renderizado estilizado de Intel, la imagen de la patente también es solo una representación gráfica sin una correlación real con el tamaño físico real de los troqueles. Es fácil ver que con tantas interfaces externas, como los controladores de memoria, PCIe, USB y SATA, sin mencionar los motores de visualización y medios y la administración de energía, los núcleos de la VPU simplemente no pueden consumir gran parte del área del troquel en el mosaico SoC. Por ahora, se desconoce la cantidad de área de troquel que Intel ha dedicado a este motor.

| Placa/Chiplet Intel Meteor Lake | Fabricante / Nodo |

| Mosaico de CPU | Intel / ‘Intel 4’ |

| Troquel base Foveros modelo 3d | Intel/22FFL (Intel 16) |

| Mosaico GPU (tGPU) | TSMC/N5 (5nm) |

| Mosaico SoC | TSMC/N6 (6nm) |

| Azulejo de la OIE | TSMC/N6 (6nm) |

La VPU está diseñada para cargas de trabajo de IA sostenidas, pero Meteor Lake también incluye un motor de CPU, GPU y GNA que puede ejecutar varias cargas de trabajo de IA. Intel de Intel dice que la VPU es principalmente para tareas en segundo plano, mientras que la GPU interviene para trabajos en paralelo más pesados. Mientras tanto, la CPU aborda el trabajo de inferencia ligero de baja latencia. Algunas cargas de trabajo de IA también pueden ejecutarse tanto en la VPU como en la GPU simultáneamente, e Intel ha habilitado mecanismos que permiten a los desarrolladores enfocarse en las diferentes capas de cómputo en función de las necesidades de la aplicación en cuestión. En última instancia, esto dará como resultado un mayor rendimiento con menor potencia, un objetivo clave del uso de la VPU de aceleración de IA.

Los chips de Intel utilizan actualmente el bloque GNA para la inferencia de IA de baja potencia para las funciones de procesamiento de audio y video, y la unidad GNA permanecerá en Meteor Lake. Sin embargo, Intel dice que ya está ejecutando parte del código centrado en GNA en la VPU y logrando mejores resultados, con una fuerte implicación de que Intel hará la transición a la VPU por completo con chips futuros y eliminará el motor GNA.

Intel también reveló que Meteor Lake tiene una estructura coherente que permite un subsistema de memoria unificado, lo que significa que puede compartir datos fácilmente entre los elementos informáticos. Esta es una funcionalidad clave que es similar en concepto a otros competidores en el espacio de la IA de la CPU, como Apple con su serie M y los chips Ryzen 7040 de AMD.

Aquí podemos ver el slideware de Intel que cubre sus esfuerzos para habilitar el vasto ecosistema de software y sistema operativo que ayudará a impulsar las aplicaciones aceleradas por IA en la PC. El argumento de Intel es que tiene la presencia en el mercado y la escala para llevar la IA a la corriente principal y apunta a sus esfuerzos de colaboración que brindaron soporte para sus procesadores híbridos x86 Alder y Raptor Lake para Windows, Linux y el ecosistema ISV más amplio.

La industria enfrentará desafíos similares para llevar la aceleración de la IA a los sistemas operativos y aplicaciones modernos. Sin embargo, tener la capacidad de ejecutar cargas de trabajo de IA localmente no vale mucho si los desarrolladores no admiten las funciones debido a las difíciles implementaciones propietarias. La clave para facilitar el soporte de las cargas de trabajo locales de IA son las bibliotecas de aceleración DirectML DirectX 12 para el aprendizaje automático, un enfoque defendido por Microsoft y AMD. La VPU de Intel es compatible con DIrectML, pero también con ONNX y OpenVINO, que, según Intel, ofrece un mejor rendimiento en su silicio. Sin embargo, ONNX y OpenVINO requerirán un trabajo de desarrollo más específico por parte de los desarrolladores de software para extraer el máximo rendimiento.

Muchas de las cargas de trabajo de IA más intensas de la actualidad, como los grandes modelos de lenguaje como ChatGPT y similares, requieren una potencia computacional intensa que continuará ejecutándose en los centros de datos. Sin embargo, Intel sostiene que presenta problemas de latencia y privacidad, sin mencionar que agrega costos a la ecuación. Algunas aplicaciones de IA, como el procesamiento de audio, video e imágenes, podrán abordarse localmente en la PC, lo que, según Intel, mejorará la latencia, la privacidad y el costo.

Intel apunta a una variedad de cargas de trabajo diferentes que pueden beneficiarse de la aceleración de IA local, incluido el procesamiento de video y audio en tiempo real y la captura de movimiento en tiempo real para Unreal Engine. Intel también demostró que Stable Diffusion se ejecuta en la GPU y la VPU de Meteor Lake simultáneamente y la superresolución se ejecuta solo en la VPU. Sin embargo, la demostración no nos brinda un marco de referencia desde la perspectiva del rendimiento, por lo que no podemos dar fe del rendimiento relativo en comparación con otras soluciones. Además, no todos los modelos Stable Diffusion pueden ejecutarse localmente en el procesador; necesitarán una aceleración de GPU discreta.

Actualmente, una serie de aplicaciones comunes admiten alguna forma de aceleración de IA local, pero la selección sigue siendo bastante limitada. Sin embargo, el trabajo de desarrollo continuo de Intel y la industria en general permitirá que la aceleración de la IA se vuelva más común con el tiempo.

Aquí hay algunas diapositivas con más detalles arquitectónicos de la presentación de Hot Chips. Intel dice que Meteor Lake está en camino para su lanzamiento este año, pero llegará primero a las computadoras portátiles.

Actualmente, todas las señales apuntan a que los chips de PC de escritorio Meteor Lake se limitan a los modelos Core i3 y Core i5 comparativamente más bajos clasificados para sobres de potencia conservadores de 35W y 65W, pero Intel aún no ha hecho un anuncio formal. Esperamos obtener más información a medida que nos acerquemos al lanzamiento a finales de este año.