Meta

El miércoles, Meta anunció un modelo de IA llamado Segment Anything Model (SAM) que puede identificar objetos individuales en imágenes y videos, incluso aquellos que no se encuentran durante el entrenamiento, informa Reuters.

Según una publicación de blog de Meta, SAM es un modelo de segmentación de imágenes que puede responder a indicaciones de texto o clics del usuario para aislar objetos específicos dentro de una imagen. La segmentación de imágenes es un proceso de visión artificial que consiste en dividir una imagen en varios segmentos o regiones, cada uno de los cuales representa un objeto o área de interés específicos.

El propósito de la segmentación de imágenes es hacer que una imagen sea más fácil de analizar o procesar. Meta también considera que la tecnología es útil para comprender el contenido de la página web, las aplicaciones de realidad aumentada, la edición de imágenes y ayudar al estudio científico mediante la localización automática de animales u objetos para rastrearlos en video.

Por lo general, dice Meta, la creación de un modelo de segmentación preciso «requiere un trabajo altamente especializado por parte de expertos técnicos con acceso a la infraestructura de capacitación de IA y grandes volúmenes de datos en el dominio cuidadosamente anotados». Al crear SAM, Meta espera «democratizar» este proceso al reducir la necesidad de capacitación y experiencia especializadas, lo que espera fomente una mayor investigación sobre la visión por computadora.

Además de SAM, Meta ha reunido un conjunto de datos que llama «SA-1B» que incluye 11 millones de imágenes con licencia de «una gran empresa de fotografía» y 1100 millones de máscaras de segmentación producidas por su modelo de segmentación. Meta hará que SAM y su conjunto de datos estén disponibles para fines de investigación bajo una licencia Apache 2.0.

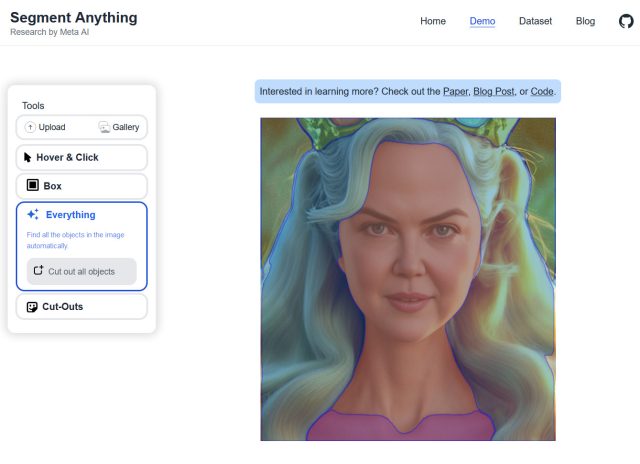

Actualmente, el código (sin los pesos) está disponible en GitHub y Meta ha creado una demostración interactiva gratuita de su tecnología de segmentación. En la demostración, los visitantes pueden cargar una foto y usar «Hover & Click» (seleccionar objetos con el mouse), «Box» (seleccionar objetos dentro de un cuadro de selección) o «Everything» (que intenta identificar automáticamente cada objeto en el imagen).

Benj Edwards / Meta

Si bien la tecnología de segmentación de imágenes no es nueva, SAM se destaca por su capacidad para identificar objetos que no están presentes en su conjunto de datos de entrenamiento y su enfoque parcialmente abierto. Además, el lanzamiento del modelo SA-1B podría desencadenar una nueva generación de aplicaciones de visión por computadora, similar a cómo el modelo de lenguaje LLaMA de Meta ya está inspirando proyectos derivados.

Según Reuters, el CEO de Meta, Mark Zuckerberg, ha enfatizado la importancia de incorporar la IA generativa en las aplicaciones de la compañía este año. Aunque Meta aún no ha lanzado un producto comercial que use este tipo de IA, anteriormente utilizó tecnología similar a SAM internamente con Facebook para etiquetar fotos, moderar contenido y determinar publicaciones recomendadas en Facebook e Instagram.

El anuncio de Meta se produce en medio de una feroz competencia entre las grandes empresas tecnológicas para dominar el espacio de la IA. El modelo de lenguaje ChatGPT de OpenAI respaldado por Microsoft atrajo la atención generalizada en el otoño de 2022, lo que provocó una ola de inversiones que puede definir la próxima gran tendencia comercial en tecnología más allá de las redes sociales y los teléfonos inteligentes.