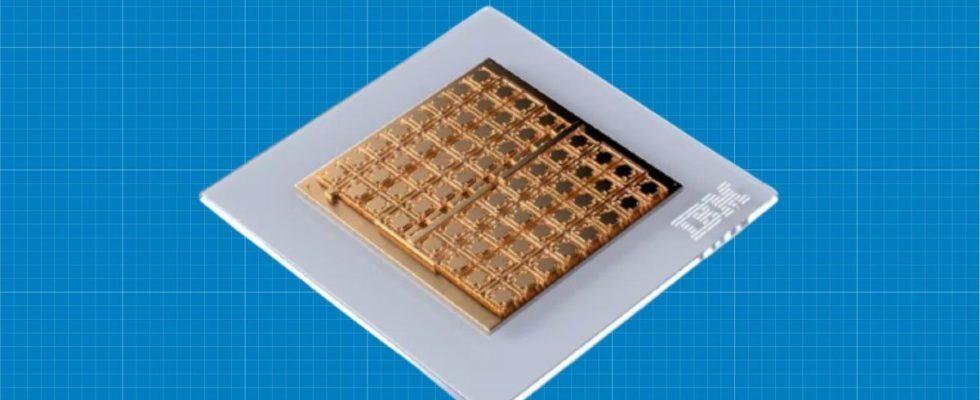

IBM afirma haber creado un nuevo chip analógico parcial de señal mixta utilizando una combinación de memoria de cambio de fase y circuitos digitales que, según afirma, igualará el rendimiento de la GPU en lo que respecta a la inferencia de IA, pero lo hará con una eficiencia mucho mayor.

No, tampoco lo entendemos del todo. Pero las implicaciones son bastante fáciles de entender. Si este chip despega, podría poner un límite a la creciente demanda de GPU utilizadas en el procesamiento de IA y guardarlas para, ya sabes, los juegos.

Según El Reg, este no es el primer chip de este tipo que produce IBM. Pero es a una escala mucho mayor y se afirma que demuestra muchos de los componentes básicos que se necesitarán para ofrecer un chip acelerador de inferencia de IA analógico de baja potencia viable.

Uno de los principales cuellos de botella existentes para la inferencia de IA implica la derivación de datos entre la memoria y las unidades de procesamiento, lo que ralentiza el procesamiento y consume energía. Como explica IBM en un artículo reciente, su chip lo hace de manera diferente, utilizando celdas de memoria de cambio de fase (PCM) para almacenar pesos de inferencia como un valor analógico y también realizar cálculos.

Es un enfoque conocido como computación análoga en memoria y básicamente significa que usted realiza la computación y el almacenamiento de memoria en el mismo lugar y así, listo, no más desvío de datos, menos consumo de energía y más rendimiento.

Las cosas se vuelven más complejas cuando comienza a describir la escala y el alcance de las matrices de ponderación que el chip puede admitir de forma nativa. Por lo tanto, no iremos allí por temor a tropezar instantáneamente con los límites extremadamente compactos de nuestra competencia en tales asuntos.

Pero una cosa es segura. El consumo de energía de procesamiento de IA se está saliendo de control. Según se informa, un rack de inferencia de IA absorbe aproximadamente 10 veces la potencia de un rack de servidor «normal». Por lo tanto, una solución más eficiente seguramente ganaría una rápida tracción en el mercado.

Además, para nosotros, los jugadores, las implicaciones inmediatas son claras. Si esta alondra informática en memoria despega para la inferencia de IA, Microsoft, Google y otros comprarán menos GPU de Nvidia y este último podría redescubrir su interés en los juegos y los jugadores.

La otra gran pregunta es cuánto tiempo llevará convertir todo esto en un producto comercial que los aficionados a la IA puedan comenzar a comprar en lugar de GPU. Sobre ese tema, IBM proporciona poca orientación. Por lo tanto, es poco probable que esté a la vuelta de la esquina.

Pero este chisme de la IA probablemente no vaya a ninguna parte. Por lo tanto, incluso si toma algunos años para funcionar, una alternativa a las GPU sería muy bienvenida para los jugadores que han sufrido durante mucho tiempo y que colectivamente han saltado de la sartén GPU de criptominería solo para encontrarse en llamas en un infierno de inferencia de IA.