El campo de la generación de imágenes se mueve rápidamente. Aunque los modelos de difusión utilizados por herramientas populares como Midjourney y Stable Diffusion pueden parecer los mejores que tenemos, lo siguiente siempre está llegando, y OpenAI podría haberlo encontrado con «modelos de consistencia», que ya pueden realizar tareas simples y orden de magnitud más rápido que los gustos de DALL-E.

El documento se puso en línea como preimpresión el mes pasado y no estuvo acompañado por la fanfarria discreta que OpenAI reserva para sus principales lanzamientos. Eso no es una sorpresa: este es definitivamente solo un trabajo de investigación, y es muy técnico. Pero los resultados de esta técnica temprana y experimental son lo suficientemente interesantes como para notarlos.

Los modelos de consistencia no son particularmente fáciles de explicar, pero tienen más sentido en contraste con los modelos de difusión.

En difusión, un modelo aprende a restar gradualmente el ruido de una imagen inicial hecha completamente de ruido, acercándola paso a paso al indicador de destino. Este enfoque ha permitido las imágenes de IA más impresionantes de la actualidad, pero fundamentalmente se basa en realizar entre 10 y miles de pasos para obtener buenos resultados. Eso significa que es costoso de operar y también lo suficientemente lento como para que las aplicaciones en tiempo real no sean prácticas.

El objetivo de los modelos de consistencia era crear algo que obtuviera resultados decentes en un solo paso de cálculo, o como máximo en dos. Para hacer esto, el modelo se entrena, como un modelo de difusión, para observar el proceso de destrucción de la imagen, pero aprende a tomar una imagen en cualquier nivel de oscurecimiento (es decir, con poca información faltante o mucha) y genera una imagen de origen completa en solo un paso

Pero me apresuro a agregar que esta es solo la descripción más complicada de lo que está sucediendo. Es este tipo de papel:

Un extracto representativo del documento de consistencia. Créditos de imagen: IA abierta

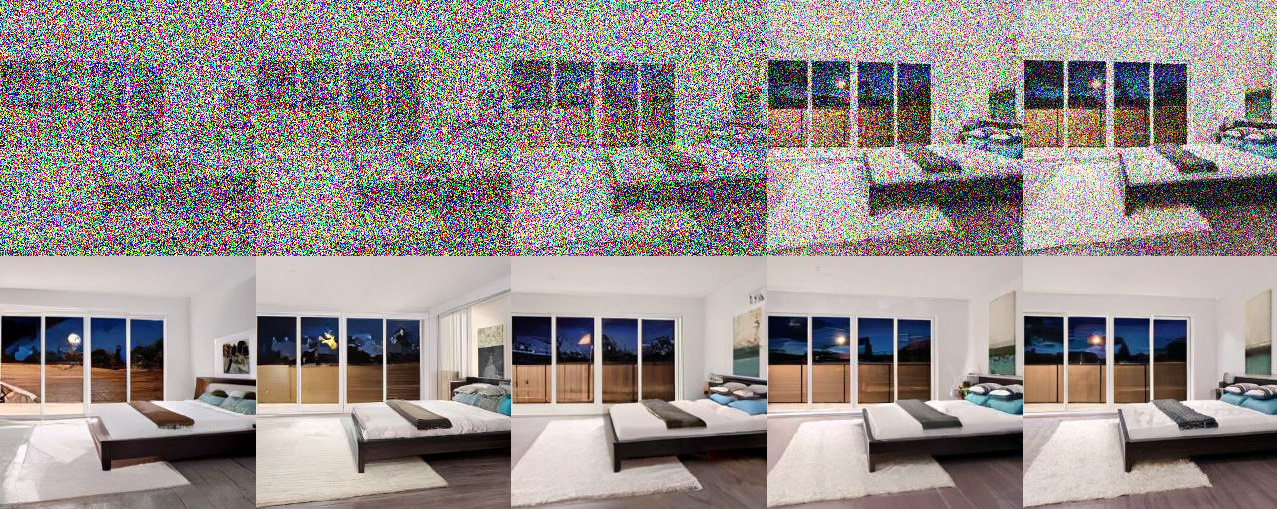

Las imágenes resultantes no son alucinantes: muchas de las imágenes apenas pueden llamarse buenas. Pero lo que importa es que se generaron en un solo paso en lugar de cien o mil. Además, el modelo de consistencia se generaliza a diversas tareas como colorear, escalar, interpretar bocetos, rellenar, etc., también con un solo paso (aunque con frecuencia mejorado por un segundo).

Ya sea que la imagen sea principalmente ruido o principalmente datos, los modelos de consistencia van directamente a un resultado final. Créditos de imagen: IA abierta

Esto es importante, primero, porque el patrón en la investigación de aprendizaje automático es generalmente que alguien establece una técnica, alguien más encuentra una manera de hacer que funcione mejor, luego otros la ajustan con el tiempo mientras agregan cómputo para producir resultados drásticamente mejores que los iniciales. Más o menos así es como terminamos con los modelos de difusión modernos y ChatGPT. Este es un proceso autolimitado porque prácticamente solo puede dedicar una cantidad determinada de cómputo a una tarea determinada.

Sin embargo, lo que sucede a continuación es una técnica nueva y más eficiente que puede hacer lo que hizo el modelo anterior, mucho peor al principio pero también mucho más eficiente. Los modelos de consistencia demuestran esto, aunque todavía es lo suficientemente temprano como para que no puedan compararse directamente con los de difusión.

Pero es importante en otro nivel porque indica cómo OpenAI, fácilmente el equipo de investigación de IA más influyente del mundo en este momento, está mirando activamente más allá de la difusión en los casos de uso de la próxima generación.

Sí, si desea realizar 1500 iteraciones en uno o dos minutos con un grupo de GPU, puede obtener resultados sorprendentes con los modelos de difusión. Pero, ¿qué sucede si desea ejecutar un generador de imágenes en el teléfono de alguien sin agotar su batería o proporcionar resultados ultrarrápidos, por ejemplo, en una interfaz de chat en vivo? La difusión es simplemente la herramienta incorrecta para el trabajo, y los investigadores de OpenAI están buscando activamente la correcta, incluido Ilya Sutskever, un nombre muy conocido en el campo, sin restar importancia a las contribuciones de los otros autores, Yang Song, Prafulla Dhariwal y Mark. Chen.

Si los modelos de consistencia son el próximo gran paso para OpenAI o simplemente otra flecha en su carcaj (el futuro es casi seguro tanto multimodal como multimodelo) dependerá de cómo se desarrolle la investigación. He pedido más detalles y actualizaré esta publicación si recibo noticias de los investigadores.