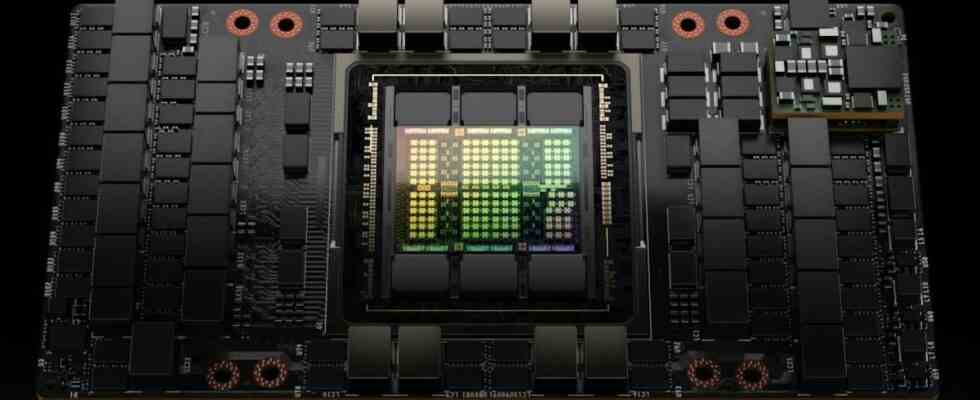

MLCommons, un grupo de la industria que se especializa en la evaluación del rendimiento de la inteligencia artificial y el hardware de aprendizaje automático, agregó los resultados de los últimos aceleradores artificiales de IA y ML a su base de datos y, básicamente, publicó los primeros números de rendimiento para las GPU de cómputo H100 de Nvidia y BR104 de Biren obtenidos a través de una industria. conjunto estándar de pruebas. Los resultados se compararon con los obtenidos en Sapphire Rapids de Intel, AI 100 de Qualcomm y X220 de Sapeon.

MLPerf de MLCommons es un conjunto de puntos de referencia de capacitación e inferencia reconocidos por decenas de empresas que respaldan a las organizaciones y envían los resultados de las pruebas de su hardware a la base de datos de MLPerf. El conjunto de puntos de referencia de MLPerf Inference versión 2.1 incluye escenarios de uso perimetral y de centro de datos, así como cargas de trabajo tales como clasificación de imágenes (ResNet 50 v1.5), procesador de lenguaje natural (BERT Large), reconocimiento de voz (RNN-T), imágenes médicas (3D U-Net), detección de objetos (RetinaNet) y recomendación (DLRM).

Las máquinas que participan en estas pruebas se evalúan de dos modos: en modo servidor las consultas llegan en ráfagas, mientras que en modo offline se alimentan todos los datos a la vez, por lo que evidentemente en modo offline funcionan mejor. Además, los proveedores pueden enviar los resultados obtenidos en dos condiciones: en la categoría cerrada, todos deben ejecutar redes neuronales matemáticamente equivalentes, mientras que en la categoría abierta pueden modificarlos para optimizarlos para su hardware, informa IEEE Spectrum.

Los resultados obtenidos en MLPerf no solo describen el rendimiento puro de los aceleradores (p. ej., un H100, un A100, un Biren BR104, etc.), sino también su escalabilidad y rendimiento por vatio para obtener una imagen más detallada. Todos los resultados se pueden ver en la base de datos, pero Nvidia compiló los resultados del rendimiento por acelerador en función de las presentaciones de sí mismo y de terceros.

Los competidores de Nvidia aún no han presentado todos sus resultados, por lo que al gráfico publicado por Nvidia le faltan algunos resultados. Sin embargo, aún podemos hacer algunos hallazgos bastante interesantes en la tabla publicada por Nvidia (sin embargo, tenga en cuenta que Nvidia es una parte interesada aquí, por lo que todo debe tomarse con pinzas).

Dado que el H100 de Nvidia es el acelerador AI/ML más complejo y avanzado respaldado por un software muy sofisticado optimizado para la arquitectura CUDA de Nvidia, no es particularmente sorprendente que sea la GPU de cómputo más rápida en la actualidad, hasta 4,5 veces más rápida que la A100 de Nvidia.

Sin embargo, el BR104 de Biren Technology, que ofrece alrededor de la mitad del conjunto de rendimiento que ofrece el buque insignia BR100, se muestra bastante prometedor en las cargas de trabajo de clasificación de imágenes (ResNet-50) y procesamiento de lenguaje natural (BERT-Large). De hecho, si el BR100 es el doble de rápido que el BR104, ofrecerá un mayor rendimiento que el H100 de Nvidia en las cargas de trabajo de clasificación de imágenes, al menos en lo que respecta al rendimiento por acelerador.

El X220-Enterprise de Sapeon, así como el Cloud AI 100 de Qualcomm, ni siquiera pueden resistir al A100 de Nvidia que se lanzó hace unos dos años. El procesador Xeon Scalable ‘Sapphire Rapids’ de cuarta generación de Intel puede ejecutar cargas de trabajo de IA/ML, aunque no parece que el código se haya optimizado lo suficiente para esta CPU, por lo que sus resultados son bastante bajos.

Nvidia espera que su H100 ofrezca un rendimiento aún mayor en cargas de trabajo de IA/ML con el tiempo y amplíe su brecha con A100 a medida que los ingenieros aprenden a aprovechar la nueva arquitectura.

Lo que queda por ver es cuán significativamente mejorarán su rendimiento los aceleradores informáticos como BR100/BR104 de Biren, X220-Enterprise de Sapeon y Cloud AI 100 de Qualcomm con el tiempo. Además, el verdadero competidor de la H100 de Nvidia será la GPU de cómputo Ponte Vecchio de Intel con nombre en código que está posicionada tanto para aplicaciones de supercomputación como de IA/ML. Además, será interesante ver los resultados del Instinct MI250 de AMD, que podría decirse que está optimizado principalmente para supercomputadoras, en MLPerf. Sin embargo, al menos por ahora, Nvidia tiene la corona de rendimiento de AI/ML.